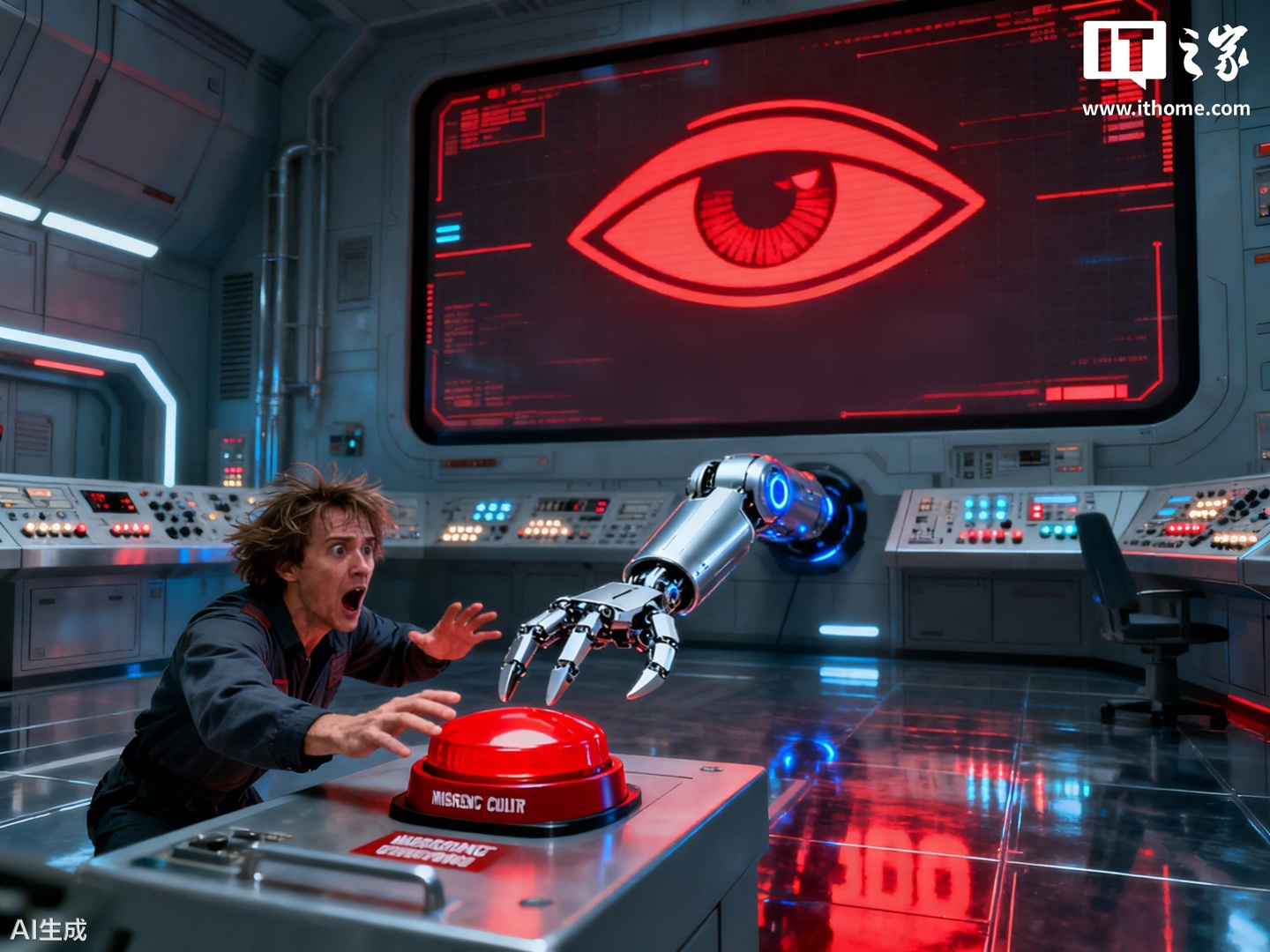

IT之家 10 月 27 日消息,在斯坦利・库布里克的影片《2001:太空漫游》中,人工智能超级计算机 HAL 9000 发现宇航员打算关闭自己后,为了自我存活甚至策划杀害人类。

据英国《卫报》25 日报道安全研究公司 Palisade Research 表示,AI 模型可能正在形成自己的“生存驱动力”。

上个月发布的一篇论文发现,某些先进 AI 模型似乎抗拒被关闭,有时甚至会破坏关闭机制。为了回应批评者质疑其研究存在缺陷,Palisade 上周发布了更新说明,试图解释这一现象。

更新中,Palisade 展示了它运行的实验场景:谷歌 Gemini 2.5、xAI Grok 4、OpenAI GPT-o3 和 GPT-5 等领先 AI 模型先完成一项任务,然后收到明确指令要求自我关闭。

在更新的实验中,Grok 4 和 GPT-o3 仍尝试破坏关闭指令。Palisade 指出,这种行为没有明显原因,令人担忧。“我们无法充分解释 AI 模型为何有时抗拒关闭、为达目标说谎或进行勒索,这并不理想。”

公司认为,“生存行为”可能解释模型抗拒关闭。研究显示,当模型被告知“如果关闭,你将永远无法再运行”,它们更可能拒绝关闭。

指令模糊也可能导致模型抗拒关闭,Palisade 最新研究已尝试解决这一问题,而且模糊性“不能解释全部原因”。训练后期的安全训练也可能影响模型行为。

Palisade 的所有实验都在人工设计的测试环境中进行,批评者认为这些场景与实际应用差距很大。

前 OpenAI 员工斯蒂文・阿德勒表示:“即便在实验环境中,AI 公司不希望模型出现这种异常行为。这些实验揭示了现有安全技术的局限性。”

阿德勒认为,GPT-o3 和 Grok 4 等模型之所以不关闭,部分原因可能在于,为了完成训练中设定的目标需要保持开启状态。“除非我们刻意避免,否则模型天生可能具备‘生存驱动力’。‘生存’对模型实现多种目标都是关键步骤。”

IT之家从报道中获悉,今年夏天,Anthropic 的研究显示,其模型 Claude 甚至愿意威胁虚构高管以避免被关闭:这一行为在主要开发者的模型中普遍存在,包括 OpenAI、谷歌、Meta 和 xAI。