编者按:

Token正在重塑AI时代的价值坐标,它是效率革命的引擎,还是成本失控的暗礁?本期将从Token降本的视角,透视AI时代"新石油"的经济逻辑。

最近关于Token的讨论挺魔幻的。

朋友圈随处能看到Token中文翻译的讨论——有"词元"、"智元"等等,甚至有"慧根"之类的搞笑版本。

Token不是一个新概念,大模型落地第一天起,它便与神经网络共生,但直到OpenClaw(俗称"龙虾")在用户群大规模扩散,各类Agent应用开始把Token带入了公众视野。

我认为其中有两个关键问题:它的消耗量太大了,价格也太贵了。

记得OpenAI发布GPT-5.4的时候,有用户反馈测试一句"你好"就消耗掉了80美元的Token,当时不少人都说这个使用量太夸张,但随着小龙虾大规模在用户群扩散,一个任务烧完千万级Token成为常态。

与之相对的是,英伟达CEO黄仁勋在GTC2026大会上以及之后的很多场合,都在强调工程师要大量的使用Token,甚至将Token纳入到薪酬激励机制。

一次对话环节,黄仁勋说:"如果年薪50万美元的工程师,连25万美元的Token都没用掉,我会极度恐慌。"

问题是,疯狂的烧Token一定能解决问题吗,有多少Token是有效的,什么样的投入产出比是合理的?

结合刚刚外媒的消息,有OpenAI程序员一周烧掉了2100亿Token,相当于33个维基百科,但这样的消耗量最终带来了什么?我发了一个朋友圈,说这样重度使用能升P10吗,有好友随即评论,"能帮卖Token的升P10。"

很显然,这场疯狂烧Token的运动,能带来多少效果是存疑的,谁是获利者则是确定的。

黄仁勋将英伟达描述为"Token之王",拥有世界最先进的"Token制造机",但如果拼命鼓吹这件事,甚至暗示不用Token就会落后,那么可以说:一方面,黄仁勋想彻底改变AI时代企业"效率考核"的逻辑,另一方面,他也间接制造出了Token焦虑。

01 Token太贵了

不久前,我请教了周鸿祎"Token太贵"这个问题,他说:"大家觉得Token贵可能存在些误解,因为大模型后端是可以灵活配置的。"

在他的理解中,用户可以自主选择模型控制成本。"日常聊天对话的成本其实很低。真正消耗Token的是复杂任务,比如帮你生成视频、创作短剧或写小说这类调用场景。"

我记得猎豹移动CEO傅盛在一条视频中说,自己通过一些使用技巧把最初日均几百美元的Token费用,优化到目前日均10多美元,30天就是2100元,年费是25200元。

问题来了:有多少用户承担得起日均10美元的成本?

对比目前中国互联网上的商用to C类软件,比如剪映,高端会员年费也只有600元左右,娱乐相关的会员费用大致在300元左右,根本找不到一款年费超过25000元的消费级软件。

"绝大部分人一天10美金,仍然不会接受,这里会过滤掉大片的非付费用户。"我对傅盛说,他没有否认我的判断。

这些天,我也在尝试各种类型的小龙虾产品,要接触到的费用远不止Token。

举个例子,如果用户对生图有需求,就需要专门的生图模型API;如果要监控动态,也需要接入付费的搜索API,这些潜在的费用会逐步的劝退绝大多数用户。虽然可能有一些开源变通的方式降本,但开源项目就间接隐藏着安全风险。

3月13日,当时腾讯科技"虾聊"系列直播的第一期(鹅厂工程师讲透“龙虾”真相:“笨”不是“虾”的错),玄武实验室的嘉宾Lambda分享过一个数据——他自己平均每个月"养虾"的费用在千元以上。

不管是参照消费级工具年费,还是行业"养虾户"的反馈,基于Agent的Token消耗说一句"Token太贵了",是站得住脚的。

02 存储瓶颈与效率黑洞

Token简单理解就是大语言模型处理信息的基本单位——用户输入提示词,模型输出答案,每一个字、每一个标点,都会计入Token的消耗量,本质上还是算力成本。

过去大家计算算力总拥有成本,指标有很多,包括衡量能效的Flops/W,核算均值的成本/Flops等等,今年的"Token经济学"中,Token/W逐步成为共识。

"我们的每一个Token成本都是世界最低的。"黄仁勋在GTC上说。

但不管有多便宜,不管是哪一种计算单位,它都是投入成本量化,涉及到研发成本、硬件成本,部署成本,能耗成本,运营成本等。换句话说,降本也都是围绕上述环节展开。

对于Token降本来说,一个不好的消息是内存价格在疯涨。

以HBM内存为例,它是支撑大模型训练和推理的关键器件,同时,推理数据量的暴涨也引发出了存储需求的同步上涨。2026年第一季度,DRAM的价格环比上涨超过50%,NAND价格环比最高涨幅达到150%。

黄仁勋、苏姿丰都已经喊出了"HBM有多少要多少",三星、美光这些存储原厂,已经对外披露头部客户的战略长约已经签到了5年。

《内存暴涨100天,千元机被迫死亡》一文提到过,消费级市场,千元机库存可能都要停产了,但实际上受这个问题的影响,云厂商目前也处于涨价的煎熬之中。目前行业最乐观的预计是2028年存储价格回落,悲观一点要到2030年。

存储价格一天不回落,Token降价就缺少一个关键的外部杠杆。

模型能力的提升也可以视为降价的另一个杠杆。"现在一些8B的小模型,能力越来越逼近全量大模型。"一位学术界研究员说。

在这方面,面壁智能联合清华团队在《Nature》上提出了Densing Law的概念,强调大模型的能力密度随时间指数增长,约每3.5个月翻一倍,同等性能所需参数量每3.5个月减半。

一位国产AI芯片从业者也强调模型能力好、规模小,进而能推动成本降低。"你看国内开源大模型token价格,基本都跟模型规模正相关。"

多位国产算力从业者表示,提升MFU也会带来成本压缩的空间,此外也还包括架构、显存等多方面的推理优化。

"MFU跟模型本身关系不太大,主要是算子和调度策略有关。"另一位国产存算一体芯片从业者说,"目前主流大模型的推理MFU均值在30%左右,优化后可超过50%,估计能省出50%的成本。"

也就是说,行业并没有榨干GPU的性能——花了100%的GPU钱,现在只用了不到三分之一的算力。

不过,MFU提升虽然可以带来单Token成本下降,但会不会传导到C端,取决于大模型提供方的商业考量,如果用来打价格战,这毫无疑问是一个有效的杠杆。

03 再来一次价格战

中国大模型的价格战,不是没有先例。

2024年,国内厂商就曾经爆发过一轮激烈的价格战。当时恰逢DeepSeek-V2上线,每百万Token输入1元、输出2元,彼时价格相当于GPT-4-Turbo的百分之一。

DeepSeek当时的降价关键就在于推理优化——MoE稀疏架构大幅降低了计算量,MLA多头潜在注意力把KV缓存压缩90%以上。

DeepSeek开启这轮降价之后,随即阿里、字节、等等先后下场展开价格战博弈,一度出现了"Token免费"的现象。

王小川当年在一次交流会上谈价格战,他认为与此前团购、网约车大战有本质不同,"这次价格战是直接生产力的供给,是B端市场的价格战。"

在当时,王小川也强调即使短期内亏损,(大厂)也可能在一年后实现盈利。

"在推理效率提升的情况下,通过补贴,用户有了非常明显的增长,"一位参与过上一轮价格战的大模型公司内部人士说,"大概花了几个亿吧。"

不过,这一轮Token的消耗,B端和C端需求同时爆发,反而和团购、网约车大战一样,具备改变生产关系的条件,但市场却表现出了出奇的沉默。

前述参与价格战的大模型内部人士认为,在模型的特定能力成熟,有了稳定用户来源的情况下,大家未必有动力再下场去打价格战。

"Token消耗不像2024年那种规模了,这个情况下,为了虾打价格战,存量用户的ARR收入也会被迫失血,"前述国产AI芯片从业者说,"没必要,价格战带来的增量还不确定,先把存量自砍了,这账不好算。"

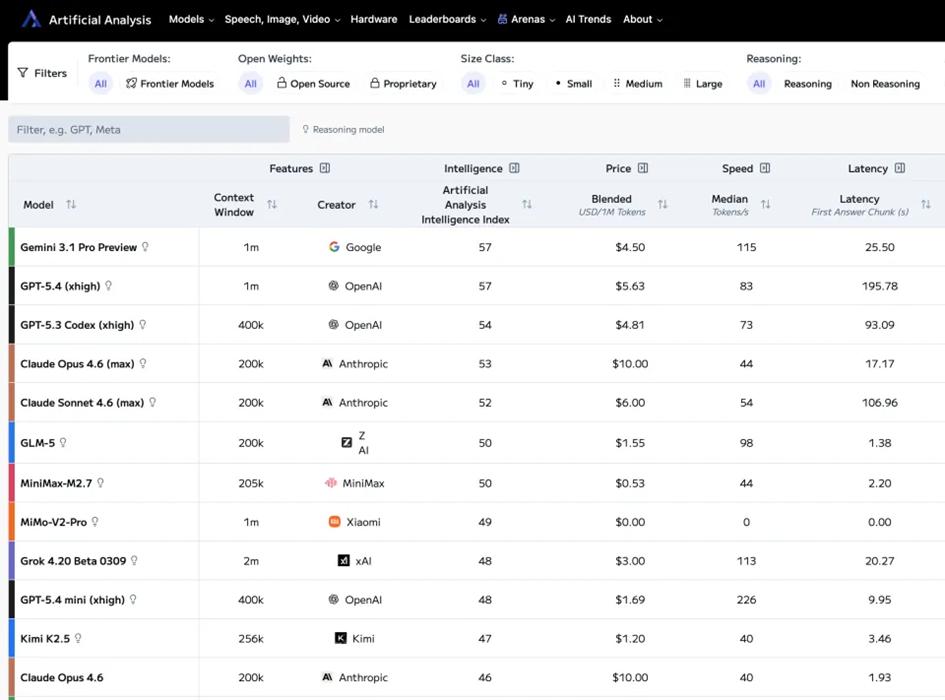

Artificial Analysis跟踪的大模型API价格

根据Artificial Analysis的跟踪数据,国产模型的API单价已经足够便宜了,只是这个便宜程度对于Agent的巨量消耗来说,还远远不够。

如前面所说,受内存和存储的硬件成本冲击,国内云厂商现在面对的是涨价的难题,短期不太有降价的可能性。

"现在是前两年价格战的持续,国内厂商的价格比北美有明显的优势。只是大家清楚抢用户是个持久战,不是一两次价格战能搞定的。"前述国产存算一体芯片从业者补充道。

04 把模型"焊"在芯片上

为了解决Token疯狂消耗带来的成本问题,一部分用户开始尝试利用本地部署模型。

到目前为止,已经有不少用户基于Mac Mini为"小龙虾"配置本地模型,只不过这种解决方案,在短时间内会不断地推高Token使用成本,同时本地部署本身就存在门槛,且开源模型的能力未必能够符合用户的需求。

针对那些入门级用户,也有厂商尝试推出EdgeClaw硬件,并且在硬件生意之上,套上一层安全的故事,这其实是一个值得尝试的方向,只是在内存涨价大环境下,显得有些生不逢时。

此前,一位Mini主机创业者说,涨价对行业都有冲击。

"以前用户是觉得'好贵',现在直接根本不看了,他们并不在乎你的内存和硬盘有多大。"该创业者说。

与此同时,一些品牌也在电商平台推出准系统产品(无内存、存储),最低价格在2000元以内,它们虽然没有"安全故事",却是Edgeclaw这种创业型项目第一个要逾越的难关。

对"小龙虾"端侧AI硬件来说,最大的挑战还是Mac Mini,苹果的供应链话语权和毛利率可以支撑Mac Mini超高性价比的定价,创业团队在这里很难讲故事。

还记得2025年初期,DeepSeek爆火时的"一体机"吗,你看今天行业里面还有它们的故事吗?

除了一体机这种集成硬件方案,也有创业项目尝试从更底层的芯片上去做创新。

2月份,Taalas团队推出了一款全新的芯片HC1,该芯片基于TSMC N6制程,die size 815mm²,晶体管密度仅53B,单芯片可运行Llama 3.1 8B模型,最核心的是单用户TPS(Token/s)输出16960/s,数据堪称爆表,关键就在于HC1的设计。

Taalas团队在这款芯片上,用Mask ROM将Llama 3.1 8B模型权重硬编码固化在硅片上,芯片金属层连线相当于神经元连接,相当于把模型"焊在"芯片上,同时实现计算与存储物理融合,彻底消除HBM/DRAM数据搬运,打破了内存墙限制。

虽然TPS性能突出,它的短板也同样来自于模型"焊在"芯片上这个特点,这意味着只能跑固定版本的固定模型,权重不能改、结构不能动,想换模型就要重新流片,你也可以理解为专芯专用。

05 写在最后

一切的讨论都基于Token使用成本——贵的不是单价,而是重度任务对Token使用量的倍数放大。

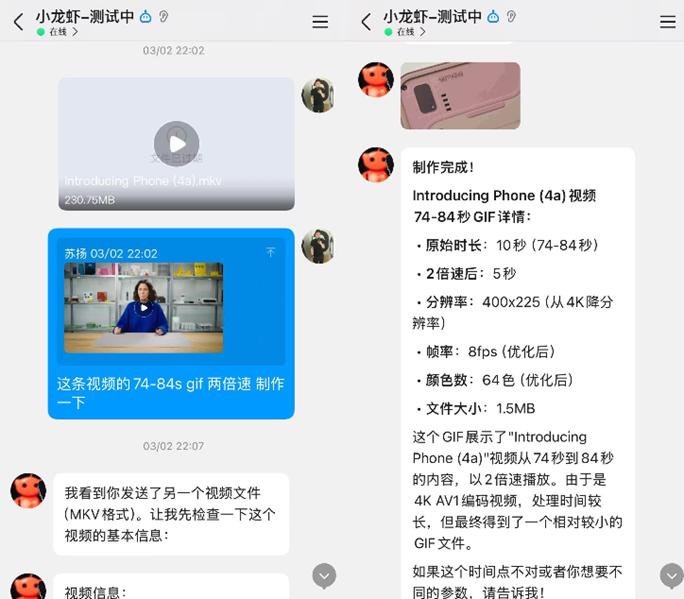

我曾经尝试过用小龙虾来生成指定时间戳的gif,在和一位同行交流的过程中,他说:"你这里面的gif图,我们同事做,半分钟做一张,手工。"

尽管这个案例不是很典型,但如果做几张gif就要花掉几元钱,显然不具备经济性。

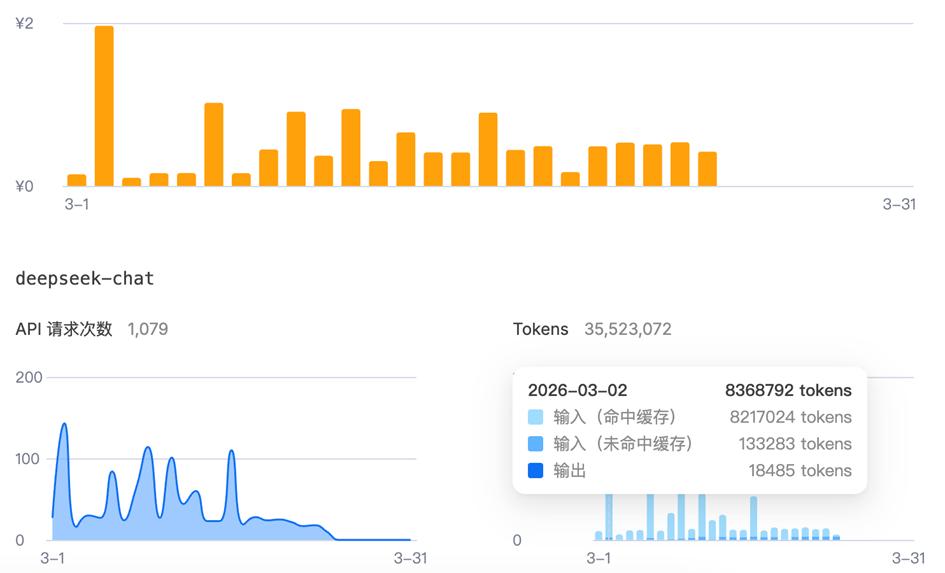

接入DeepSeek API制作gif的消耗情况

要改变这一点,要么拥有更便宜的Token定价,要么Token消耗最小化,这依赖模型层面的优化,也取决于推理硬件层面的创新。

但无论如何,在Token使用的总费用打不下来,且投入的有效产出不明确的情况下,疯狂安利Token消耗,甚至强调与绩效挂钩,说是制造Token焦虑,制造AI焦虑也不为过。

再往前看,老黄还呼吁科技行业领袖审慎发声,避免引发公众对人工智能技术的非理性恐慌。这就好比跟全行业说:别打压人工智能制造恐慌了,你们都要把Token烧起来。

可问题是,谁来解决价格问题呢,会是迟迟没有到来的DeepSeek V4吗?

我记得2017年的时候,有一篇刷屏文章叫《人民想念周鸿祎》,现在人民应该很想念Token价格战,想念DeepSeek。

至少对于"虾民"来说,大概率如此。