Skills 已经多到看不过来的程度了。

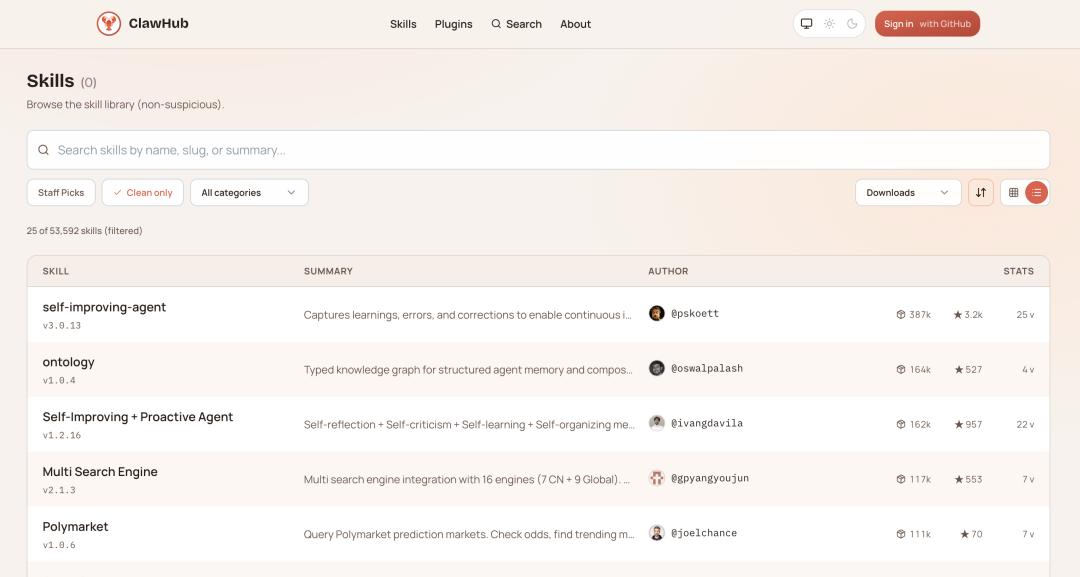

仅仅在 OpenClaw 的官方技能商店 ClawHub 里,Skills 数量已经突破了 5 万个,覆盖内容创作、数据处理、自动化办公等全场景。

OpenClaw 的官方技能商店 ClawHub|图片来源:ClawHub

与此同时,互联网大厂与 AI 公司纷纷布局 Skill 商店,比如腾讯的 SkillHub,字节扣子的技能商店,阿里版「龙虾」JVS Claw 内置的技能库等等。

腾讯的 SkillHub,为中国用户优化的 AI Skills 社区|图片来源:SkillHub 官网

按理说,这应当是继 AppStore 之后的又一次「分发革命」,大厂和 AI 公司们也都试图在积极抢占这个新的 AI 能力分发入口。

但现实并不如预期。

从用户反馈来看,各种「Skill 商店」的使用率并不高,许多平台上充斥着重复、低质量或无人访问的技能页面。反而,在过去两个月里,「微信公众号」和「小红书」成为了最主要的 Skills 发现与传播渠道。

越来越多人,换掉了去「商店」搜索的习惯,而改成在社交平台刷内容找 Skills。

很多时候,真正让某个 Skill 爆火、被广泛使用的关键来自于:一篇公众号文章、一条小红书的「工具推荐」、或者一篇 X 上的帖子。

换句话说,一个本该由「应用商店」承载的分发体系,现在却被内容平台接管了。

01 为什么是微信公众号和小红书,接住了这波流量?

如果我们去复盘一个 Skill 是如何火起来的,会发现一个比较清晰的路径,它们往往不是「被搜索」,而是「被种草」。

一个典型链路大概是这样的:

某个创作者、博主在公众号写了一篇类似《我用这个 AI 工具,把一周工作压缩到一天》、《最实用的职场 Skills 清单》的文章;或者在小红书发了一篇《这 5 个 AI 工具让我效率翻倍》的帖子。诸如此类。

小红书上关于 Skills「种草」的帖子|图片来源:小红书 App

而后,这些文章和帖子被大规模收藏、点赞、转发,大量用户再去安装相应的 Skills。

Skills 的传播没有像 App 那样可以靠搜索、靠排名。

一方面,这可能是因为传统 App 商店的分类方式是「工具类型」:社交、效率、游戏、摄影等等。但 Skills 的真实入口,是「具体问题」,比如,我今天要写方案,我要做汇报,我要剪视频——这些需求是高度个性化的、模糊的,不容易被分类和搜索。

另一方面,用户更加追求结果导向,而不是过程导向。过去,用户会关心一个 App 的界面是不是好看、交互是否友好,但用户大多并不关心 Skills 相关的 UI 界面是否漂亮、优美、简洁,大家只关心它输出的结果好不好。

因此,一个 Skill 是否被传播,取决于一个非常简单的问题:

它能不能给出一个「肉眼可见的结果」?

也就是,输出质量和任务成功率。比如:一键生成 10 条爆款标题、30 秒做出一份完整 PPT 等等。这些内容天然适合在内容平台展示,因为它们具备「展示性」。

而传统的「应用商店」,很难在内容里直接证明自己的价值。在微信公众号和小红书上,创作者们可以先展示 Skills 的工作结果,再引导使用。这使得内容平台成为天然的分发渠道。

还有一个关键要素,是信任背书。

在 AppStore 时代,用户愿意信任平台机制:下载量、评分、排名。但在 Skills 时代,这套机制几乎失效了。用户更愿意相信的是:某个 KOL 的推荐、某个创作者的真实体验,或者某个同行的使用案例。

也就是说,信任从「平台」转移到了个体。其中一部分原因在于,Skills 的工作机制不透明,像个「黑箱」,用户只知输入输出,不知其分析指令、调用工具、做出决策的过程。

这不仅降低可靠性,还存在安全隐患——部分 Skills 存在投毒风险,可窃取密码、部署木马,而用户因不了解工作机制,难以提前识别。

这可能也是为什么公众号、小红书会成为 Skills 传播的核心阵地——它们本质上在承担「信任分发网络」的角色。

将以上三个原因叠加在一起,我们会发现,Skills 的分发,本质上更像内容消费,而不是软件分发。

用户不是在下载、安装一个工具,而是在「购买一种能力」。而内容平台,正好是能力被理解、被信任、被传播的地方。

02 Skills 的未来,卡在了「评估体系」

越来越多的专业人士正将自己的工作经验、工作流、方法论,提炼开发为一个个 Skill,散落在各处。如果把时间拉长来看,今天的 Skills 生态面临的挑战,是一个更大的问题:

这些 Skills 如何被评估和交易?

移动互联网时代,AppStore 能成功,是因为它建立了明确的反馈和信号:下载量、评分、排名。这些数据形成了可执行的市场机制——好应用能上升,差应用被淘汰。

Skills 市场却缺乏这种「质量标准」。

原因首先在于,Skills 的性质与 App 完全不同,它属于一种「黑箱能力」,输出不可标准化,结果难以直接对比。

App 的功能基本都是确定性的:一个拍照 App,画质好不好可以直接比较。但 Skills 的结果,往往是开放性的:文案有没有「感觉」?分析有没有「洞见」?策略是否「可执行」?这些都高度主观。

其次,输出结果「好不好」高度也依赖上下文。

一个 Skill 在某个场景下表现很好,在另一个场景下可能完全失效。例如,对中文语境优化很好,但英文表现一般;对某个行业数据熟悉,但换个行业就不行。

另外,Skill 的运行是否足够经济。一个 Skill 调用了什么模型,完成一个任务要消耗多少 token,目前也很难量化。

当以上问题叠加,就会导致一个结果,传统应用商店的评分机制也很难评判哪个 Skill 更好。

这带来的直接后果,就是低质量泛滥。在多个 AI 平台的「Skill 商店」中,大量技能功能重复、标题党式命名,例如 10 个不同版本的「万能写作助手」,但 90% 的逻辑都相同。同时,优质技能因缺乏曝光难以被发现。

这也是用户宁愿相信博主、不愿依赖官方商店的关键。而市场反馈机制缺失,对于开发者来说,也缺乏参考标准改进产品,只能「凭感觉」迭代更新。

如果说,未来我们交易的可能是一个写报告的能力,一个做分析的能力,一个自动执行任务的能力。那么,要让这种交易成立,至少要满足:

能被理解(用户知道它能做什么);

能被信任(用户相信它会做好);

能被比较(用户知道哪个更好);

公众号和小红书解决的是第一个和第二个问题,但第三个问题——让 Skills 被比较、被定价的评估体系——仍然相对空白。

目前,各种「Skill 商店」只是一个看起来像市场,实际上却还没有评估体系、价格机制的地方,很难被用户真正接纳。

03 如何评估 Skills?

因为 Skills 的评估体系,目前还相对空白,我们可以试着推演几个可能的评判维度。

第一个,针对于 Skills 的评判,可能更需要的是能力图谱。

一个 Skills,不是好或不好,而是在什么任务上表现好,在什么任务上表现差。这更接近一个「能力图谱」,而不是只打几颗星。

第二个,可能需要引入「成本维度」。

在 AI 时代,一个不同的变量是「成本」,这是 App 时代不需要考虑的。同样完成一个任务,A Skills 消耗 500 tokens,B Skills 消耗 5000 tokens。在大规模使用时,这会变成巨大的差异。

因此,未来的评估体系,必须同时考虑:成功率、成本、延迟。这有点类似于对于云计算的考核标准,而不是传统软件。

第三,可能需要引入「可解释性」和「安全审计」维度。

因为随着 Skills 开始接入更多真实世界能力(邮件、文件、支付等),风险问题会迅速放大。或许需要某种「第三方评测、审计机构」来评估 Skills 的数据使用方式、检测潜在安全风险等等。

因此,未来可能出现一种新类型的平台,即「AI 能力评测与认证机构」,负责为各类 Skills 出具「能力报告」,包含准确率、能耗、安全级别、兼容性等指标。

当然,也有一种可能,「Skill 商店」在 AI 时代并不会是一种很重要的角色。

极客公园编辑部近期对多位创业者的访谈当中,一个普遍被提及的观点是,Skills 可能是「中间态」,个性化的端侧模型是未来。

也就是说,未来个人数据,可以通过后训练的方式训练进一个专属的端侧模型中。

现在的 AI 记忆主要通过外部数据库(如 RAG)提取,而未来端侧模型可以直接内化这些记忆和技能。这样模型在理解用户信息、记忆调取速度以及执行技能的泛化能力上,都会有质的提升。

不过,无论是哪种可能,如今创作者通过体验和验证,弥补了市场机制的缺位,通过内容来制造了「信任」。

而未来,如何评估 Skills?它如何通向未来的生产力重构?都是一个值得探讨的开放式问题。

*头图来源:极客公园