最近,几件颇具象征意味的事件接连发生。

一边是娱乐公司开始正式把AI推向台前,哇唧唧哇发布九周年家族曲《āi ái ǎi ài》AIMV,乐华娱乐发布了首支AI驱动女团HeyDream,华纳音乐推出AI偶像吴爱花,AI不再只是幕后工具,而是深入参与形象设定、内容生成和运营表达。另一边,以大头针为代表的AI歌手在短视频备受欢迎,AI歌曲也开始霸榜国内音乐平台,有人用AI换脸模仿K-pop歌手演唱逼真到让人难辨真假,这些都放大了技术对内容真实性边界的冲击。

从AI歌曲频繁进入流量中心,到AI歌手、AI演员陆续走向台前,一个更清晰的现实正在浮现:AI正在重塑大众对于真实表演、真人创作乃至艺人存在感的基本认知。过去音乐产业赖以成立的那套价值判断——谁在唱、谁在创作、谁在被看见——都开始被重新定义。

当技术演进的速度,已经远远快过行业和用户更新认知的节奏,一个更值得追问的问题也随之出现:在AI持续改写内容生产逻辑之后,音乐产业真正稀缺的价值,究竟还剩下什么?

AI音乐简史

今天谈论AI音乐,大家常带着骤然爆发的印象,仿佛它是在大模型时代才凭空出现的产物。

事实上,如果从最早的计算机作曲实验算起,AI音乐这条线索几乎已经延伸了近七十年。前半程缓慢、笨拙、时断时续,后半程在算力、数据与模型的共振中骤然加速,最终在极短时间内完成了从边缘实验到产业现实的跨越。

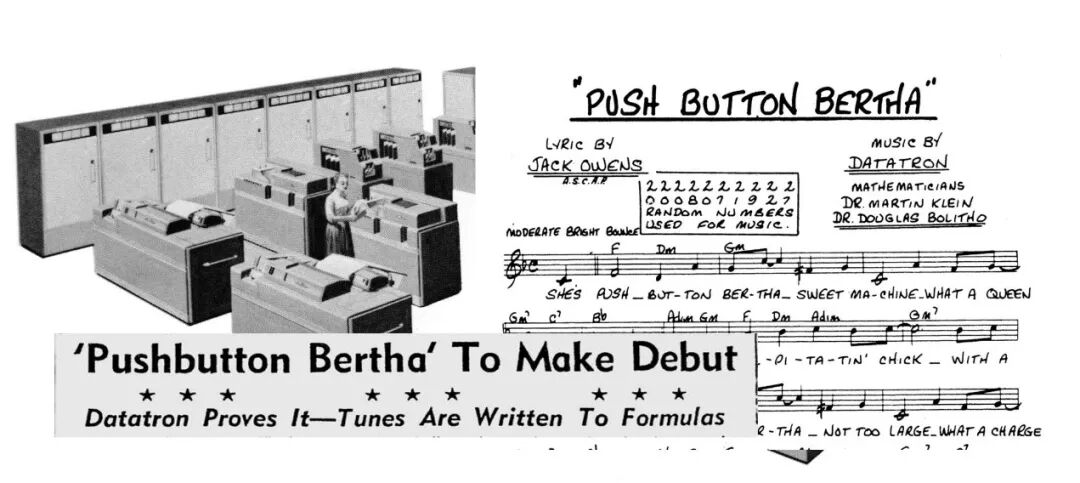

上世纪50年代,计算机还远未进入大众生活,音乐与算法之间的联结却已经悄然开始。1956年,洛杉矶KCOP电视台的一档名为《Adventure Tomorrow》(明日冒险)的科学纪录片节目中,一位歌手对着镜头唱起了一首情歌,歌颂对象不是某位姑娘,而是一台名为Datatron 205的计算机。

这首歌的真正“作曲家”,是两位工程师Martin L. Klein和Douglas Bolitho。他们的动机非常有意思,曾说:“我们想证明,如果人类能以每小时一首歌的速度创作低质量的‘流行音乐’,那么我们用一台计算机,也能写出同样烂的歌,而且更快。”

这句冷幽默,放到今天看,竟有一种预言般的意味,触及了AI音乐最早也最本质的一层问题:机器进入音乐,并没有从“理解美”开始,而是从拆解规则开始的。

同年,化学博士Lejaren Hiller突然意识到,作曲和化学研究,本质上都是在严格的规则体系下进行创造性的选择。于是,他联合数学家Leonard Isaacson将作曲规则编写成程序,让ILLIAC I计算机按照指令,创作出一首弦乐四重奏《Illiac Suite》。

如今从历史的角度听《Illiac Suite》,会发现这个组曲集合了许多具有共同调性、但彼此封闭的器乐作品,恰恰暴露了早期计算机作曲的本质——只能忠实地执行预设的指令,将不同规则下的产物机械地并置。

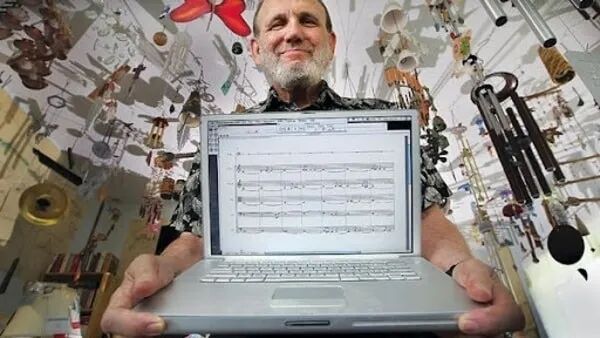

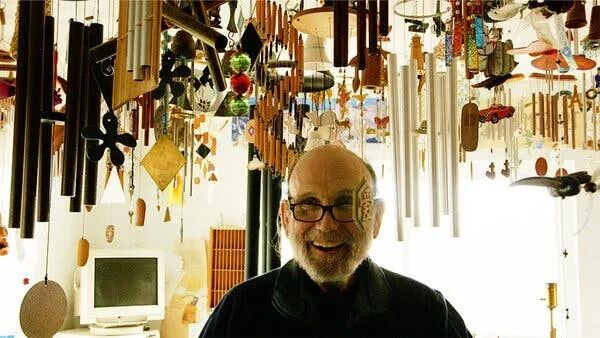

几十年后,类似的尝试开始逐渐走出实验室。1997年前后,美国作曲家David Cope开发的EMI(Experiments in Musical Intelligence)系统能够自动模仿“类似巴赫或莫扎特风格”的音乐。甚至在一场盲听测试里,EMI作品足以让专业听众判定为巴赫真作,反倒把巴赫本人的作品打成了“拙劣伪造”。

当时围绕EMI的争论,如今听来有一种惊人的熟悉感。有人认为,这根本算不上创作,属于作弊;有人担心,它会摧毁作曲家的地位,使创作劳动失去稀缺性;也有人坚持,机器不可能拥有灵魂,只是空洞的模仿。

三种声音,完整预演了今天围绕生成式AI展开的公共辩论。时代换了,模型换了,措辞换了,但问题本身并没有变。

后来的结局也很有意思,因为当时争议太大,David Cope直接删除了EMI的音乐数据库。他认为,如果音乐可以无限复制,它就会被贬值。

但历史的吊诡之处,就在这里。

Cope试图阻止的,恰恰成为后来三十年AI音乐公司不断重复的技术逻辑,学习既有音乐、训练生成系统,再以新的形式产出音乐。作为最早的AI音乐模型,它在1990年代引发的问题没有消失,只是被更大的数据、更强的模型和更成熟的商业体系放大了。

到了2010年代,AI才真正开始触碰现代音乐产业的应用领域。

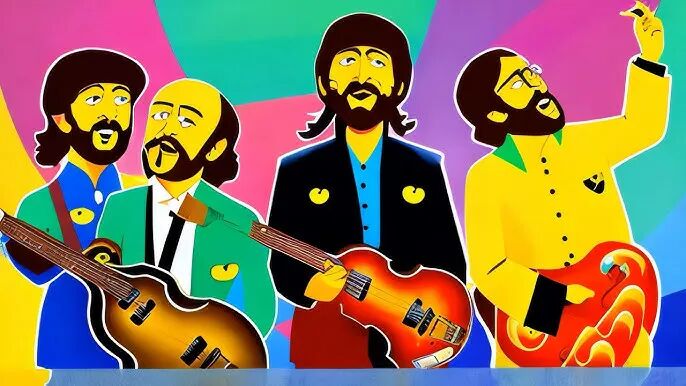

2016年,索尼计算机科学实验室通过学习13000份乐谱,试图模仿披头士的创作方式,创作了歌曲《Daddy’s Car》;2017年,美国网红歌手Taryn Southern在YouTube上传了她和AI共创的单曲《Break Free》,谷歌Magenta项目也证实启动。虽然这一阶段的AI音乐仍然带着明显的实验属性,但技术路径已经清晰,共同拉开了一个人机共创音乐新时代的序幕。

在过去近七十年的时间里,AI音乐的进步大多以十年、几十年为单位,缓慢推进。真正意义上的变化,发生在最近这半年。

从2025年9月至今,随着以Suno V5为代表的AI音乐模型的能力持续进化,短短数月之间,AI音乐几乎完成了一次全链路层面的跃迁,即从以演示为主的demo形态,迅速走向可商业使用、可规模化部署,并逐步被产业接纳的完整能力体系。

这也是为什么今天AI音乐带给行业的震感,和过去几十年的任何一次技术进展都不完全相同。很多时候,人类习惯先建立判断,再面对变化,但在AI时代,变化的速度似乎让顺序被颠倒了,变化先发生,判断只能不断被迫修正。

AI狂飙,什么正在升值?

过去很长时间里,音乐行业建立在技术稀缺、资源主导的结构之上,一个完整作品的诞生,需要多个专业角色的协作。

我们曾在《音乐圈的第一批AI受害者出现了》里提到,近两年,那些曾撑起音乐工业化生产的高精密专业工具,正接连上演着令人唏嘘的退场与转向。

数据显示,2025年,使用生成式AI音乐的用户已经占到全体音乐创作者的10%,付费使用AI创作的人数更是直接翻了一倍;与之形成对照的,是2024到2025年,传统音乐软件的购买人数连续两年下滑,对应的从业者收入也同步缩水。

当AI能一键完成编曲、录音棚模拟、修音、混音乃至母带处理的全流程,这些曾需要从业者熬上数年才能磨透的稀缺技能,正在飞速褪去它的稀缺光环,从入行必备的核心竞争力变成了行业通用的基础设施。

同步在快速贬值的,还有另一类曾在行业里被奉为硬通货的资金与人脉。

就像是几百年前,一手好字是文人墨客的立身之本,而在电脑普及的今天,打字成了人人具备的基本能力,内容的灵魂终究回归到了创意和才华本身。

AI可以生成无数正确答案,但真正决定选择哪一个的,是长期积累的音乐审美、清晰的创作语境、稳定的现场能力,以及围绕音乐建立起来的听众关系。这些,都会获得越来越高的溢价。

基于以上,我们或许可以这么理解AI,它只是给音乐产业换了一套更高效的生产工具,淘汰了一批本就平庸的人和公司。

不可避免的是,从创作到分发、消费,从角色定义到IP打造、商业逻辑,每一个环节的边界都在被彻底重塑。一味拍板淘汰论,多少有点显得像冷眼旁观的陈述了。

我们正在目睹的是,音乐产业不再沿着旧地图运行,但AI不是从业者的对立面。

就像早年黑胶存储决定了一首歌的时长,短视频开始让歌曲的时间越来越短,当进入AI时代,必然会衍生出全新的内容形式和消费场景。而作品与场景之间的边界会越来越松,音乐开始像水一样,顺着每个内容容器的形状流动,从而让分发场景的边界被无限拓宽。

与此同时,很多角色概念都会被重新定义。首先变化最大的是词曲作者,AI作为辅助,谁更知道自己要什么,谁就更可能从工具里得到更好的结果。创作会成为决定内容差异、用户心智与商业转化的源头变量,利润天花板、护城河也由此建立。

歌手这一概念也在松动。过去,稀缺嗓音、身体条件、训练体系和舞台人格构成核心资产,未来,这些依然重要,但不再是唯一通道。

无论是华纳音乐推出的AI虚拟偶像“吴爱花”,还是在下沉市场爆火的AI歌手“大头针”,都说明当音色、人设与内容节奏可以被稳定生产,至少从听觉层面,听众对歌手的认知,正从“一个人”滑向“一个可持续被消费的声音人格”。

从作品层面看,音质、抓耳、传唱度会成为最基本的起跑线,更多决定一首歌上限的,在于创作者能否基于自身的审美判断与经验积累,通过AI把明确的艺术想法高效、精准地转化为成熟作品。

这是AI也最容易被低估的一点。一旦意图可以被低成本兑现,创作世界的竞争就不再是有没有灵感,行业会更像一个由无数审美代理人构成的市场,技术负责完成,人的价值回到选择。

或许,AI会终结我们过去理解音乐产业的很多前提。

创作、发现、消费、感动,这是音乐运作的四条底层线索,无论技术如何更迭,它们都是常数。其他一切,渠道、格式、工具、分发机制、平台规则,只是在这些不变之上不断重组。

音乐行业的钱,会流向哪里?

过去很长一段时间里,无论影视还是音乐行业,都大致遵循着一种相似的分配逻辑:资本掌握流量入口,入口影响收益分配,而分配进一步决定了谁更容易被看见。

当生成工具开始大规模降低制作门槛,这个秩序反而更陡峭了。

这也是AI时代最清醒也最不浪漫的一面。

以往内容工业的壁垒是资金、团队和周期,未来这个市场的壁垒会更像一种审美上的统治力,门槛没有消失,它只是从物理层迁移到了心智层。这是钱会流向哪里的第一个变量。

不过,相比影视,音乐行业的利润逻辑并不完全建立在单一超级IP的爆发上,而会更接近一种更绵长、更隐秘的收益结构。影视行业的集中观看时刻确实会驱动影剧综游漫等多形态IP的开发,但本质大多仍是叙事和角色完成价值封顶,音乐则更依赖版权、声线、人格与场景渗透,形成复利。

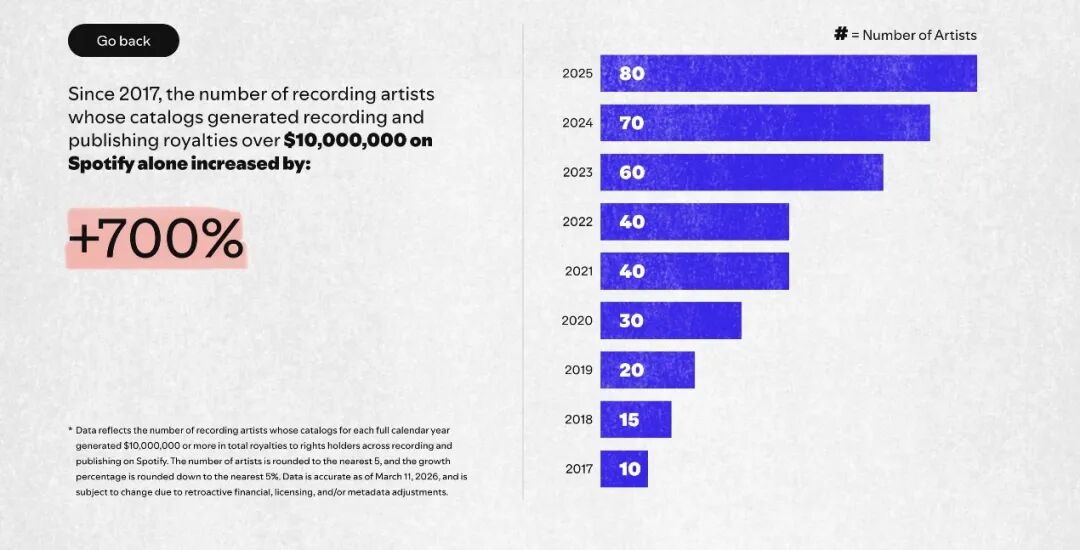

这种差异,本质上也意味着音乐产业的盈利正在发生变化,Spotify《Loud & Clear》显示,2017—2025年,仅在Spotify上产生超过1000万美元录音和词曲版税的艺术家数量增加了700%;1000美元至100万美元各收入档的艺人数量增幅在220%到250%之间,流媒体平台上音乐从业者的“中产阶层”在持续、稳定地扩容。

有些意外的是,Spotify音乐业务全球营销与政策负责人Sam Duboff表示,2025年,在Spotify年收入超100万美元的艺人中,超过80%从未有歌曲进入过平台全球日榜Top50,他们没有爆款神曲,靠的是长期积累的稳定粉丝群。

围绕这一基础,音乐产业正在分化出两条并行的变现路径:一条是以版权分账为核心的分发体系,依赖平台与内容供给的规模化运转;另一条则是以UGC与超级粉丝为驱动的生态体系,通过二创扩散、人声授权与社群互动,放大传播效率,并形成更高频、更持续的价值回流。AI同时放大了它们,让分发更集中、扩散更迅速,结构也因此变得更加极端。

因此,未来行业真正决定钱流向何处的,会流向场景渗透、资产掌控、心智占领、稀缺体验四种能力,未来真正值得下注的,也是围绕这四种核心能力展开的赛道。

第一类,是类似于影视行业中的3-5人的超级工作室(Super Studio)或创作小队,在音乐行业则是更适合的超级音乐厂牌。理想状态下,一个人具备审美判断能力,懂词曲创作、曲风把控,并洞察市场,同时构建IP叙事;一个懂编曲制作、AI音乐模型微调与音频算法;一个人则掌握全球的内容平台分发规则、多语言社媒运营与粉丝社区的生命周期管理。未必规模最大,但一定拥有最稳定的内容方法论。

第二类,可能是最稳定的赛道,AI版权与数据市场。围绕传统版权和AI生成内容的版权授权,采用以及声音、风格、数字分身所对应的新型权利,全球讨论已迅速升温。

美国版权局近两年的系列报告,已明确将“可版权性”、“训练使用”与“数字复制体”拆分为独立议题;田纳西州签署的《ELVIS Act》则进一步把“声音”纳入法律保护范围。AI音乐相关的版权已经开始长出制度轮廓,未来内容产业的一部分利润,会从台前明星项目,转移到后台的权利基础设施。

今年3月,AI 音频创业公司 ElevenLabs通过用户分享他们声音的 AI 生成副本,设定其使用方式,并在付费订阅者使用时获得收益,已向创作者支付超过1100万美元,现在正将该模式扩展到音乐领域。

第三类,是AI音乐IP。一个成熟的AI音乐IP,通常需要同时具备四个核心要素:清晰的人设定位、持续一致的声音与视觉体系、可延展的世界观内容结构,以及可反复沉淀的听众关系。

商业价值开发上,AI音乐IP和真人音乐IP在本质上并没有脱离同一套逻辑,但在内容生产、形象延展、跨平台运营和商业授权上,反而可能具备更高的可控性和可复制性。

最后一类,也是音乐产业最本质、最难替代的一类,就是线下演出与现场体验。

未来的线下演出,将不再只是作品的现场演绎,而是IP叙事的线下延伸、粉丝与IP的深度交互场域,尽管扩张速度慢、运营效率远低于数字内容,却能凭借不可复制的在场感,获得更高的长期商业溢价与抗周期价值。毕竟,越是合成AI、虚拟泛滥,越是真实在场变贵。

说到底,AI影响的更多是产量,在音乐几百年的发展历史里,记谱、十二平均律对音乐产业的影响,远比今天的AI更深刻。

今天,我们再去讨论AI音乐有没有灵魂,不重要,人类如何对抗AI,也不重要,AI音乐的发展不只是技术史,它同时也是一部观念史。

它正在倒逼整个行业重新回答,音乐里究竟什么才是最重要的。

*本文图源网络,如侵权联系删改