AI对数据中心的影响不再停留在理论层面。随着模型复杂度和处理量持续攀升,部署模式正在转变,服务提供商亟需在规模、效率和运营复杂性之间实现微妙平衡,以保持竞争力并维持盈利能力。高通技术公司始终聚焦于以明确目标应对这一变革时刻,将经过验证的系统级优势应用于不断演进的AI推理基础设施需求。

过去一年里,高通持续整合面向数据中心的关键构建模块:

高性能、高能效的AI加速;

机架级系统设计;

大规模部署和管理这些环境所需的软件。

这一系统级解决方案旨在实现持续运营、可靠性和规模化,同样构成了高通在工业和基础设施计算领域更广泛地演进的基础。在MWC 2026,高通将通过展台的展览展示分享这些领域的切实进展。

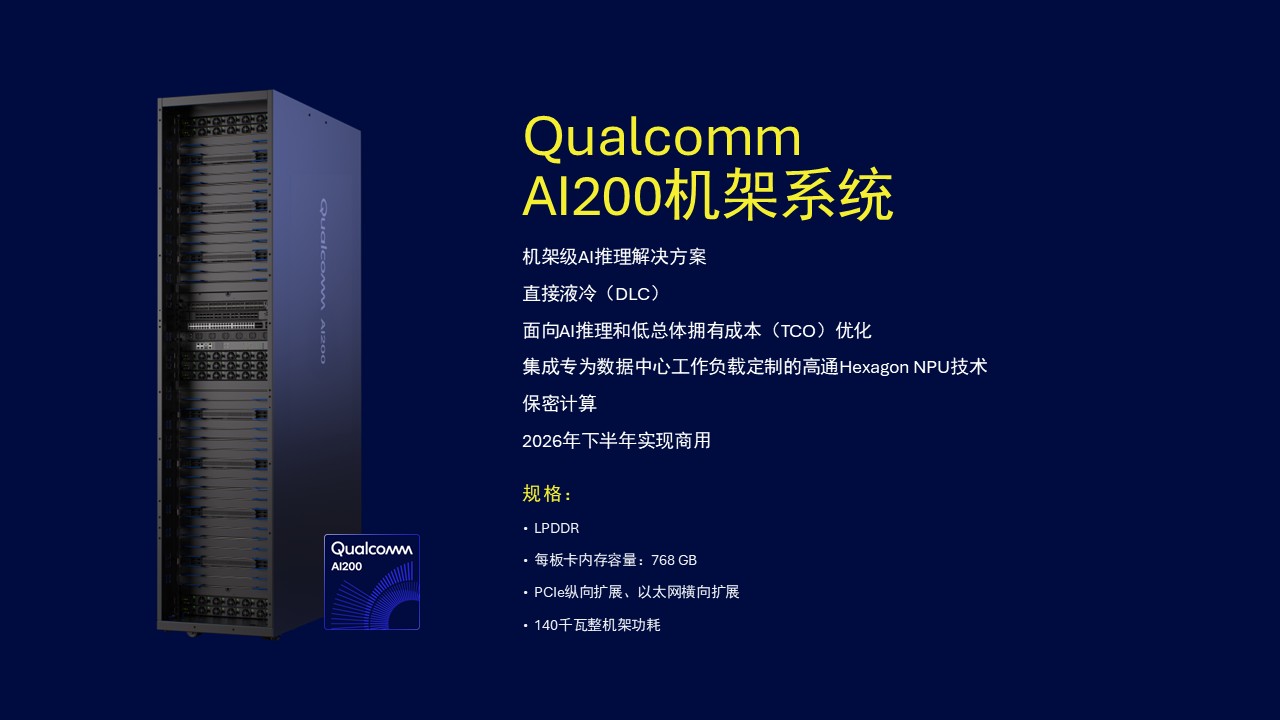

深入剖析Qualcomm AI200机架系统

一个最核心的部分将是Qualcomm AI200机架系统——将加速卡、内存架构、互连技术和管理软件整合至统一的、可部署的系统。这一机架级解决方案体现出客户对AI基础设施的评估方式正日益转变——不再将其视为孤立的组件,而是面向持续运行而设计的完整可维护系统。Qualcomm AI200机架系统提供了突破性的43 TB内存容量,使其成为运行最新、最大旗舰AI模型推理的理想选择。Qualcomm AI200机架系统将于今年开始部署,展示了高通技术公司如何解决计算和连接瓶颈——不仅在边缘侧,如今更是深入数据中心的核心层面。

高通还将演示在单个Qualcomm AI200加速卡上运行3500亿参数的生成式AI模型,展示目前可在单个板卡上实现的规模。Qualcomm AI200平台旨在支持扩展至1万亿参数的模型[ FP16模型],进一步凸显系统平衡的重要性——内存容量、数据传输和效率协同运作,以提供超大规模下真正可落地的生成式AI。

系统级连接和规划

同样重要的是连接和规划这些系统的能力。去年12月,在完成收购Alphawave Semi后,高通技术公司将一系列关键技术纳入其数据中心产品组合,包括但不限于高速有线连接、定制芯片和Chiplet技术。这些高性能、低功耗数据传输技术专长,与高通的AI和计算平台相得益彰,进一步增强高通从系统层面应对日益增长的AI工作负载需求的能力。

在MWC上,这样的整合将通过高通AI基础设施管理套件得以呈现,这一套件目前正由HUMAIN在数据中心部署。该套件为机架级部署提供配置、监控、规划和故障处理功能。硬件、连接和软件共同构成统一数据中心平台解决方案的基础,旨在随着客户AI工作负载的演进而扩展。

高通技术公司的数据中心解决方案经精心设计并立足于执行,将AI加速、连接和软件整合至专为实际部署设计的平台中。MWC是一个展示这些系统化进展的契机。期待提供更多信息,包括在接下来的活动中更新高通的路线图,届时高通将分享更多细节。