在隐退五年后,被誉为“互联网女皇”的传奇风险投资家玛丽·米克尔于近日发布长达340页的《AI趋势报告》。这份被业界称为“AI圣 经”的文档,用51次“前所未有”的表述宣告:人工智能革命已进入不可逆的爆发期,人类正站在技术奇点的临界点。

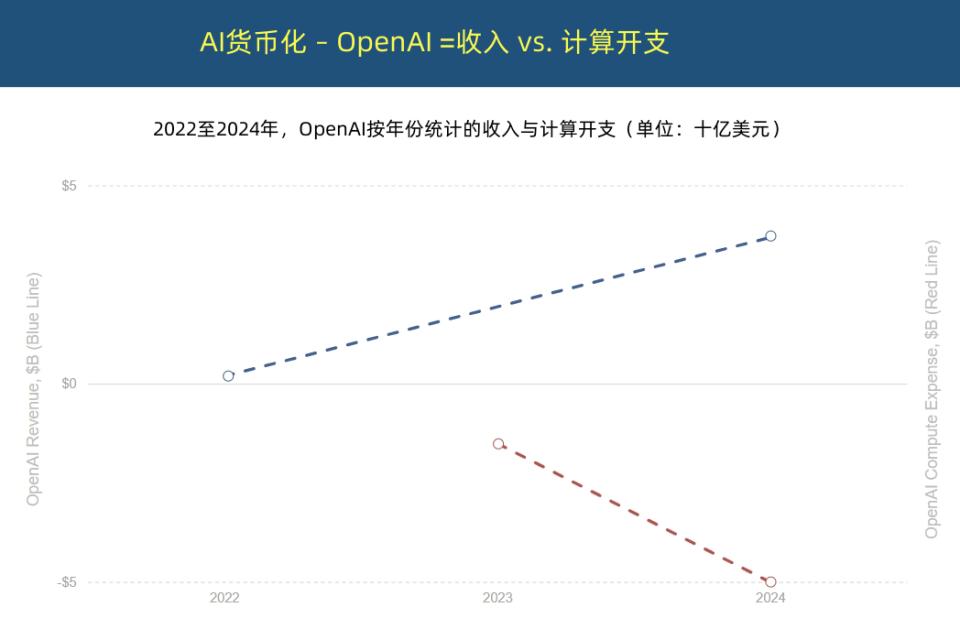

在报告中,米克尔利用大量图表详尽呈现了人工智能技术在开发速度、应用广度、资金投入和使用规模方面的爆炸性增长,并质疑OpenAI等AI巨头的“烧钱模式”是否能持续下去。

下面,就让我们以图表的形式解读下这份报告的核心内容:

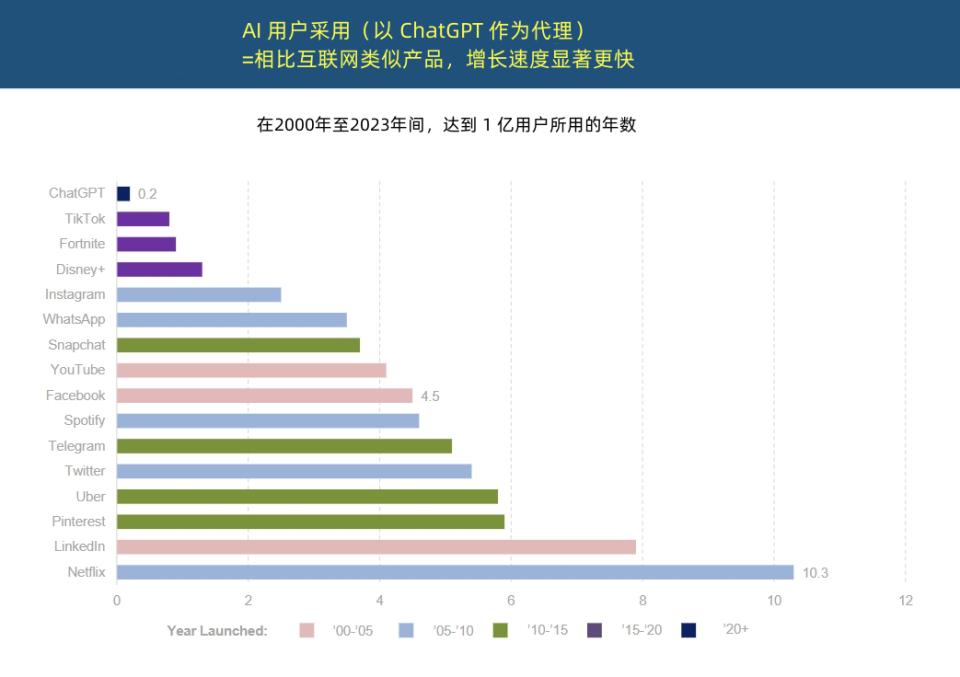

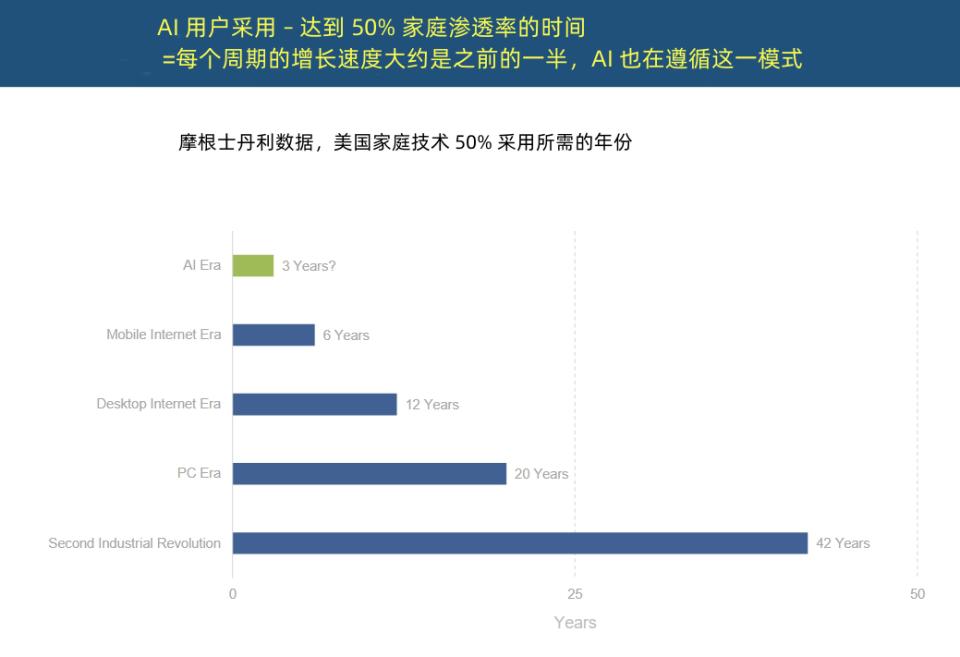

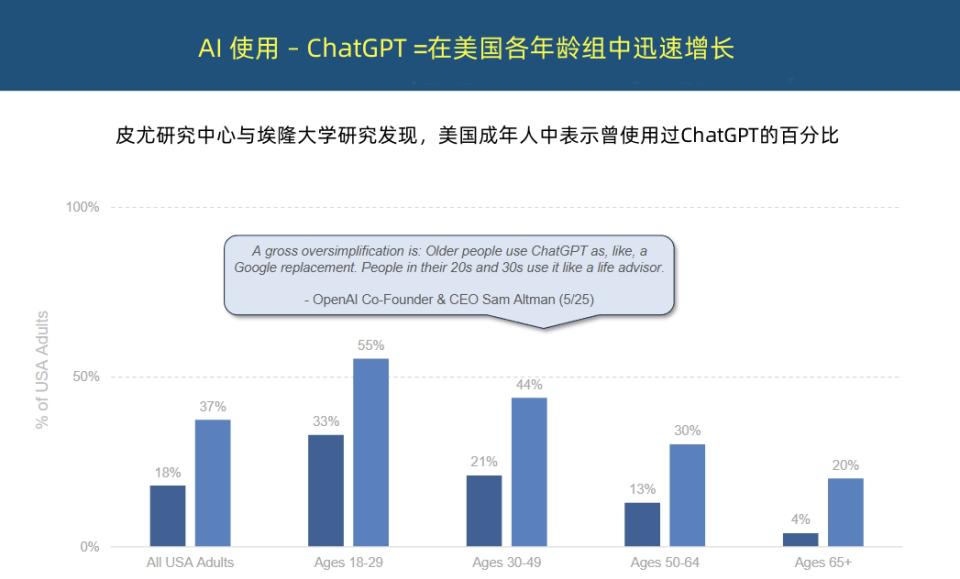

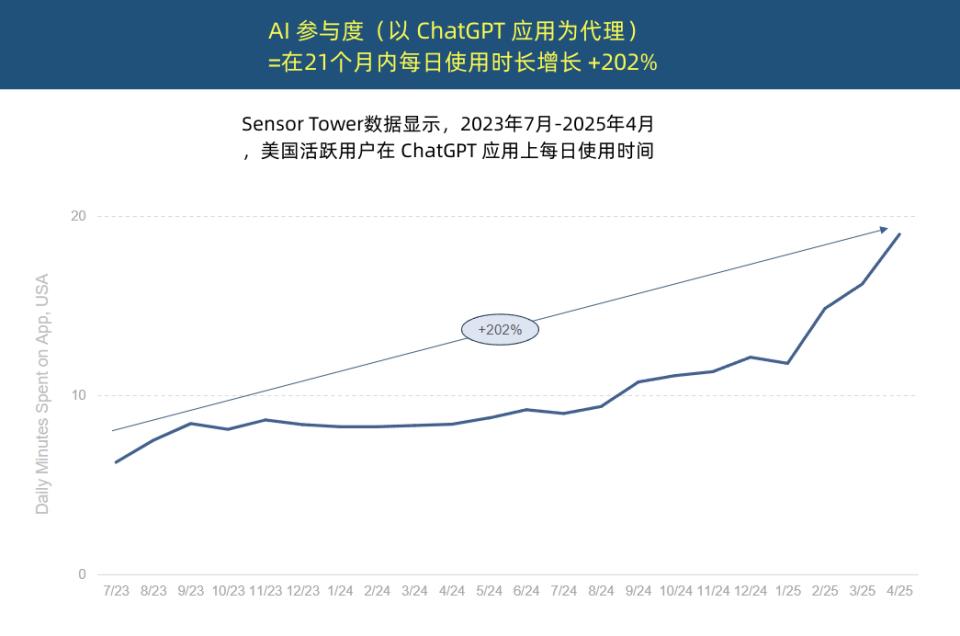

用户的AI采用速度是前所未有的

报告显示, 人工智能时代的来临标志,是AI用户群的激增。

与互联网1.0革命的技术起步于美国,然后稳步向全球扩散不同的是,ChatGPT一下子登上了世界舞台,并在全球大部分地区同时增长。

作为衡量算力的基本计量单位,浮点运算次数在2010年以后开始增速显著增加,年增长率达到360%。

如果以美国计算相关专利授权数量为例,可以发现,第一次加速是在1995年,标志着互联网时代的开始。2004年起,其增速放缓,标志着互联网时代的发展也开始变慢。在2022年ChatGPT发布之后,专利数量又一次开始爆发式增长,而且比1995年那次更快。

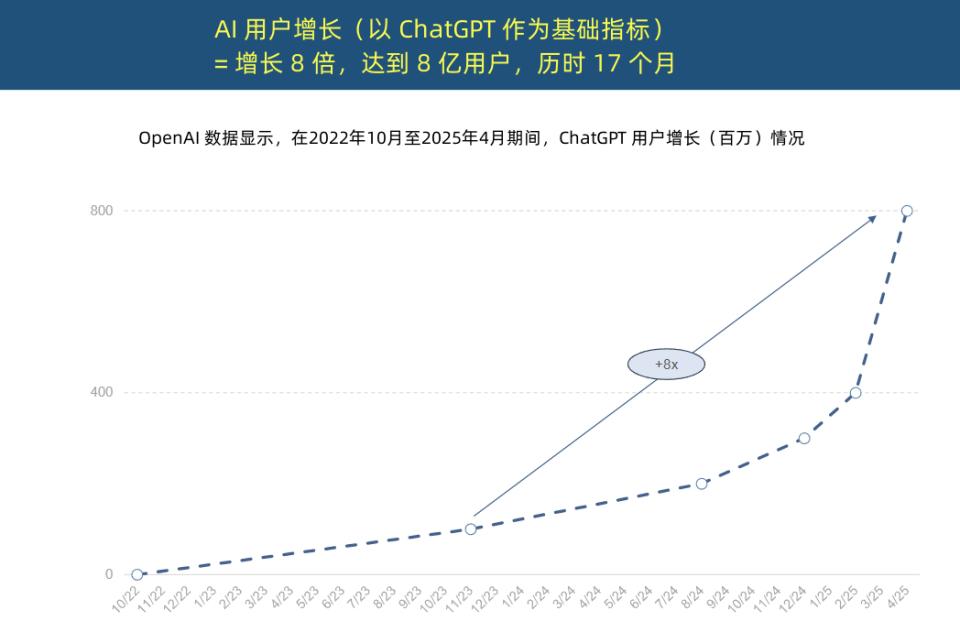

ChatGPT在17个月内达到8亿用户,这个增长速度超越了人类历史上任何一项技术。

同时ChatGPT还在蚕食搜索市场份额,其年度搜索量已经达到3650亿次,是谷歌的5.5倍,ChatGPT达到这一数字所用的时间为两年,而谷歌用了11年。

这种史无前例的普及速度,也意味着竞争的白热化程度同样史无前例。

l技术生态系统AI采用速度令人印象深刻

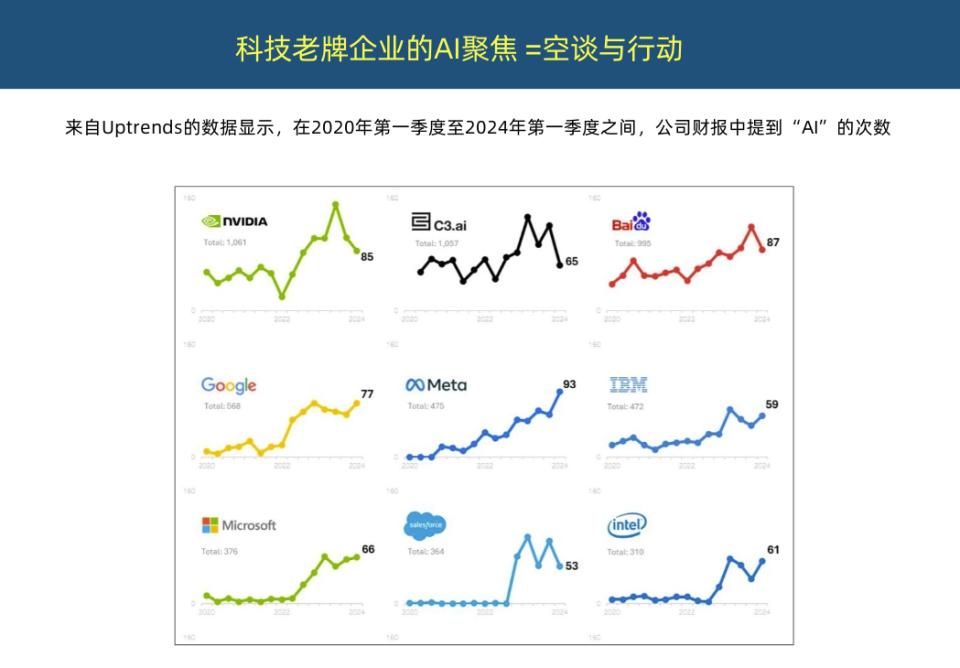

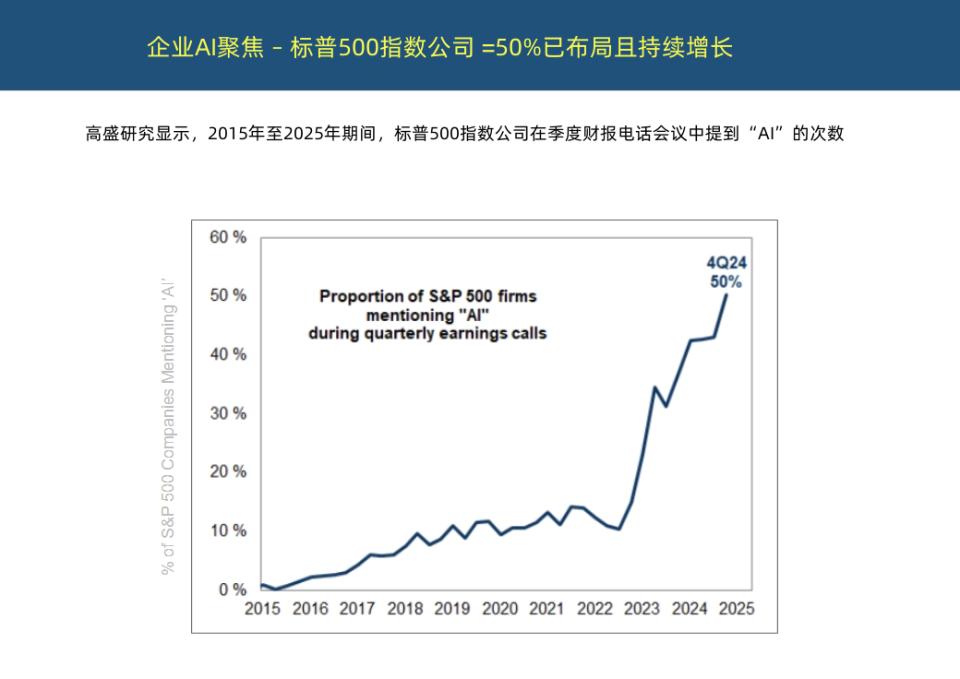

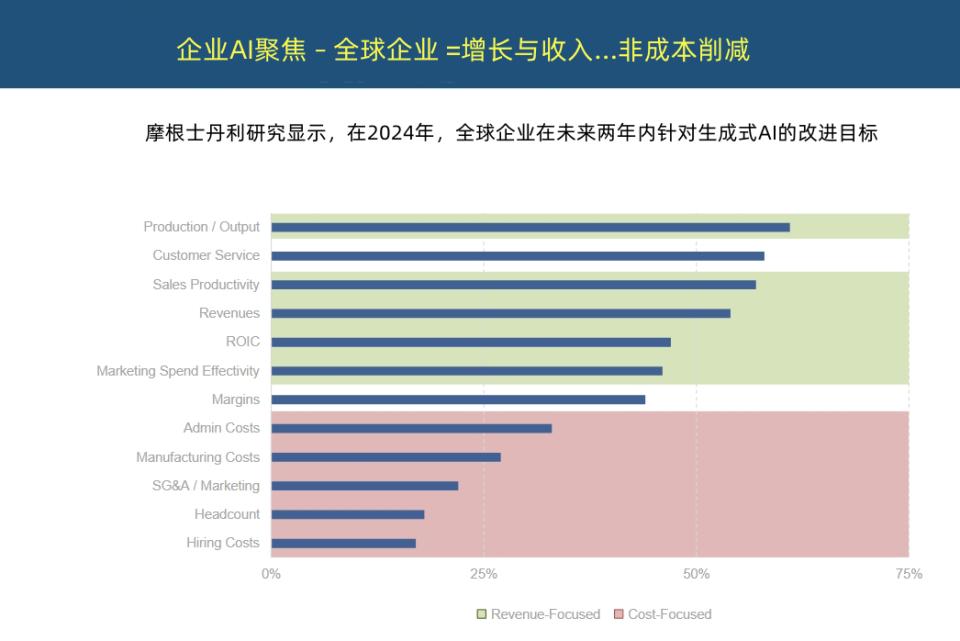

l科技老牌企业的AI采用成为了当下的首要任务

l“传统”企业AI采用也正在成为优先事项

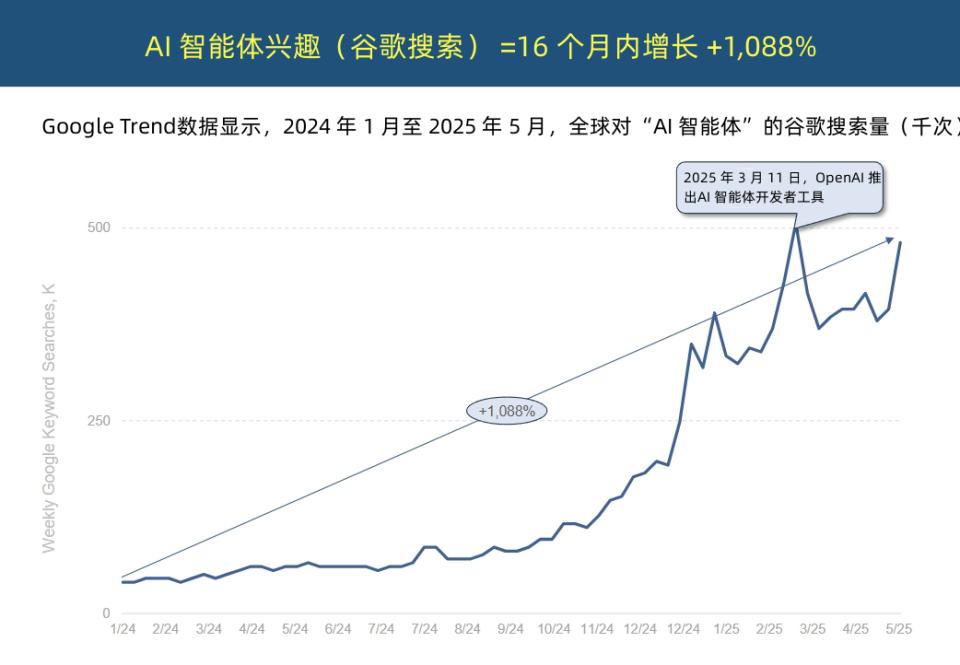

AI 智能体演变:从「聊天回复」到「执行任务」

一种全新的AI类型正在崛起——它们不再仅仅是简单的助手,而逐渐转变为功能强大的服务提供者。曾经作为基础对话界面的AI,如今正朝着更广泛的应用功能演变。

传统的聊天机器人设计用于响应用户的提示,通常局限于固定的脚本或有限的流程。而AI智能体代表了一个巨大的进步。这些智能体不仅具备推理和行动能力,还能够代表用户完成复杂的多步骤任务,它们不再单纯地回答问题,而是执行。

早期的助手依赖明确的输入并产生狭窄的输出,而智能体则承诺以目标为导向,具备自主性并设置必要的保护机制。它们能够理解用户意图、管理记忆,并跨应用进行协调,最终完成具体的工作。重点不再是简单的回应,而是着眼于实现目标。

尽管我们仍处于智能体发展的初期阶段,但其影响已开始逐步显现。这些智能体有潜力彻底改变用户与数字系统的互动方式——从客户支持、员工培训,到研究、日程安排以及内部运营等多个领域。

企业正积极引领这一变革,不仅在试验智能体,还在广泛部署它们,投资智能体的框架,并围绕自主执行构建生态系统。曾经仅仅是消息传递接口的工具,正逐渐转变为行动执行的核心层。

数据中心:AI资本支出的主要受益者

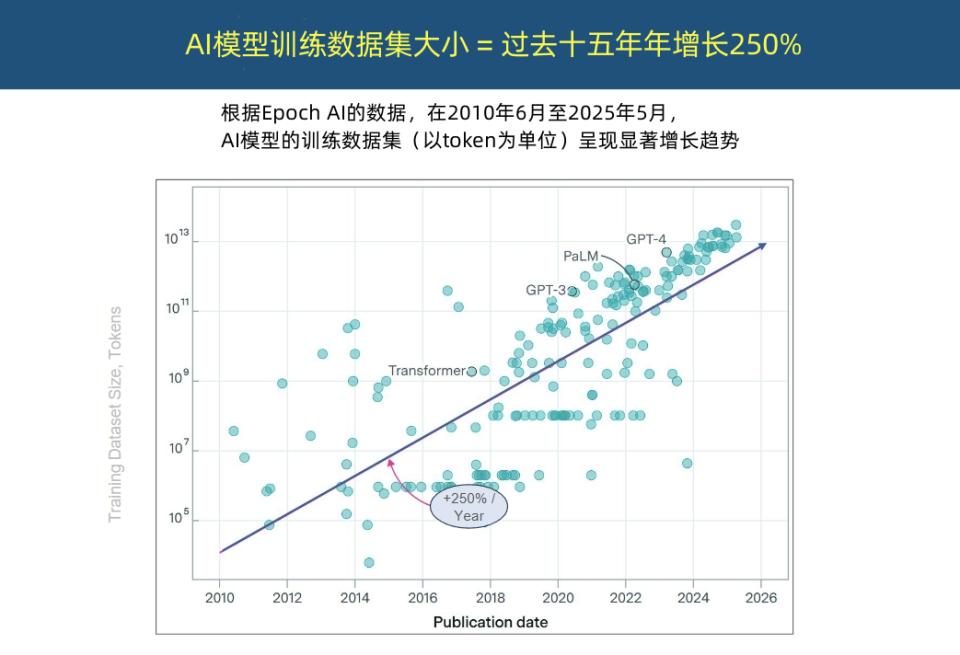

要预测AI模型经济学的未来走向,我们可以从模型能力与成本之间日益加剧的紧张关系入手。

训练最强大的大语言模型(LLM)已成为人类历史上最昂贵且资本密集的工作之一。随着性能不断提升,模型的参数规模和架构日益复杂,训练成本已经飙升至数十亿美元。

讽刺的是,打造最强大通用模型的竞争,反而可能加速其商品化,并导致收益递减。随着各方输出质量的逐渐趋同,差异化变得越来越难以维持。

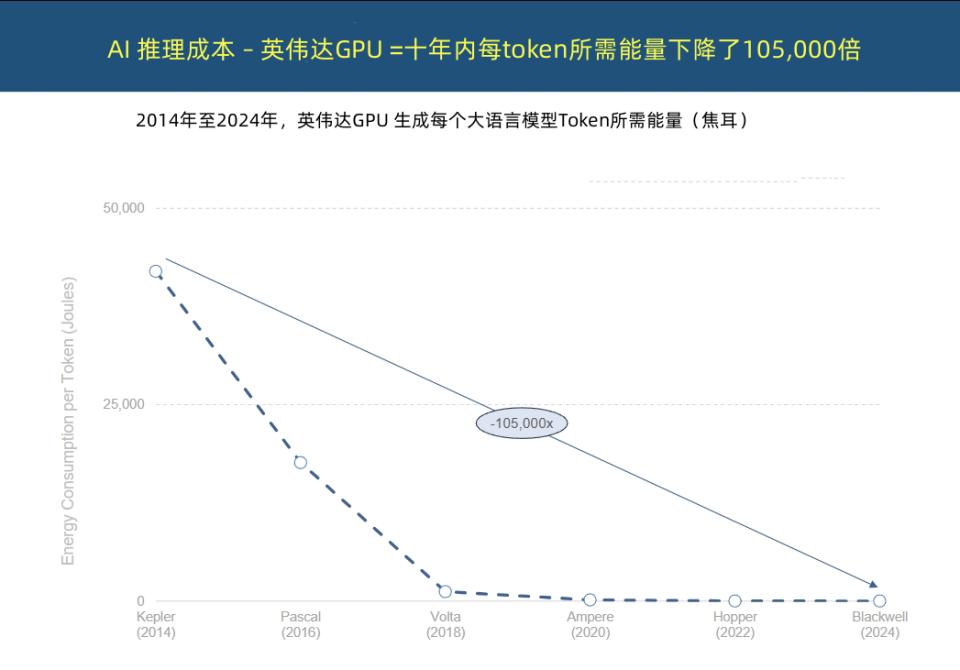

与此同时,使用这些模型的成本——即推理成本——却在迅速下降。硬件的进步是其中的重要因素——例如,英伟达2024年发布的Blackwell GPU,处理一个token所消耗的能量仅为2014年Kepler GPU的十万分之一。再加上模型算法效率的突破,推理成本正呈现急剧下降的趋势。

随着推理变得更加便宜和高效,LLM提供商之间的竞争压力也在不断加剧——不仅仅在准确度上,更在于延迟、正常运行时间和每个token的成本。曾经需要花费数美元的,现在可能只需几分钱,而那些几分钱的成本,很快也可能降到几分之一。

这一变化的影响仍在持续展开。对用户(和开发者)而言,这无疑是一大福音:强大AI的单次使用成本大幅降低。

随着终端用户成本的下降,新的产品和服务的创生正处于蓬勃发展之中,用户和使用量不断攀升。

然而,对于模型提供商来说,这却引发了关于盈利模式和商业化的真正挑战。训练成本高昂,服务成本低廉,定价权逐渐下滑,商业模式正在发生深刻变化。与此同时,通用LLM方法的“一刀切”模式面临疑问,越来越多的小型、廉价模型正为特定应用场景而量身定制。

提供商是否会选择构建横向平台?还是专注于特定领域应用?这只有时间能告诉我们答案。

从短期来看,通用LLM的经济学看起来更像是一个资本密集型的商品化业务,烧钱成了常态。

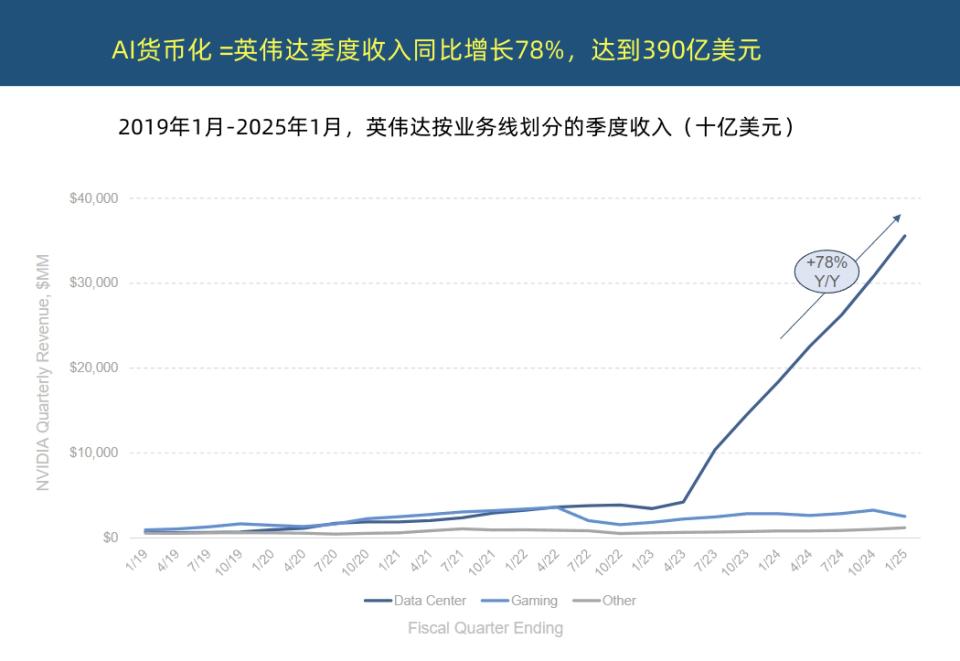

AI货币化

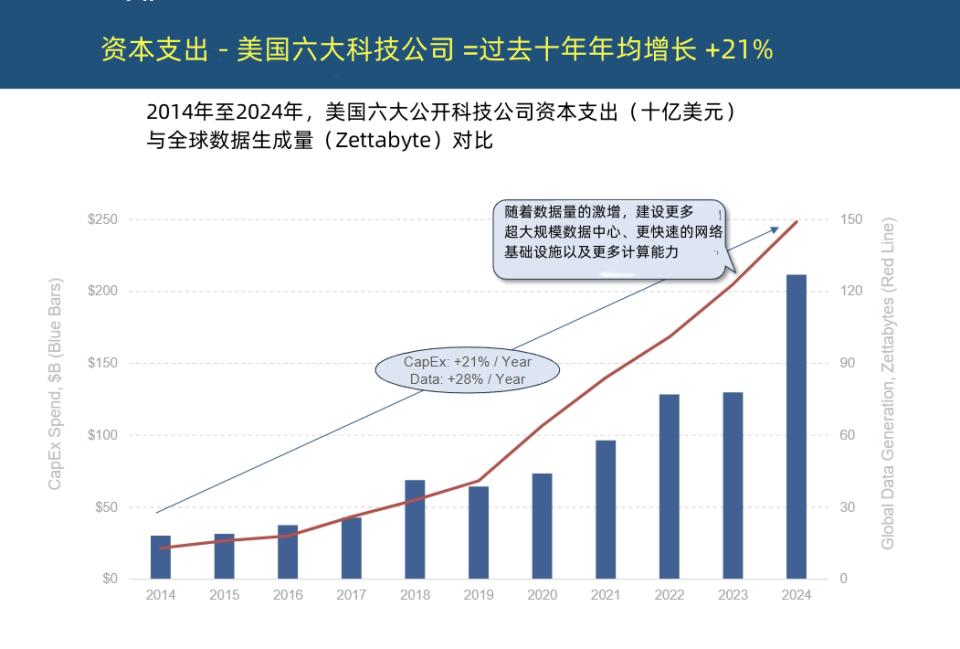

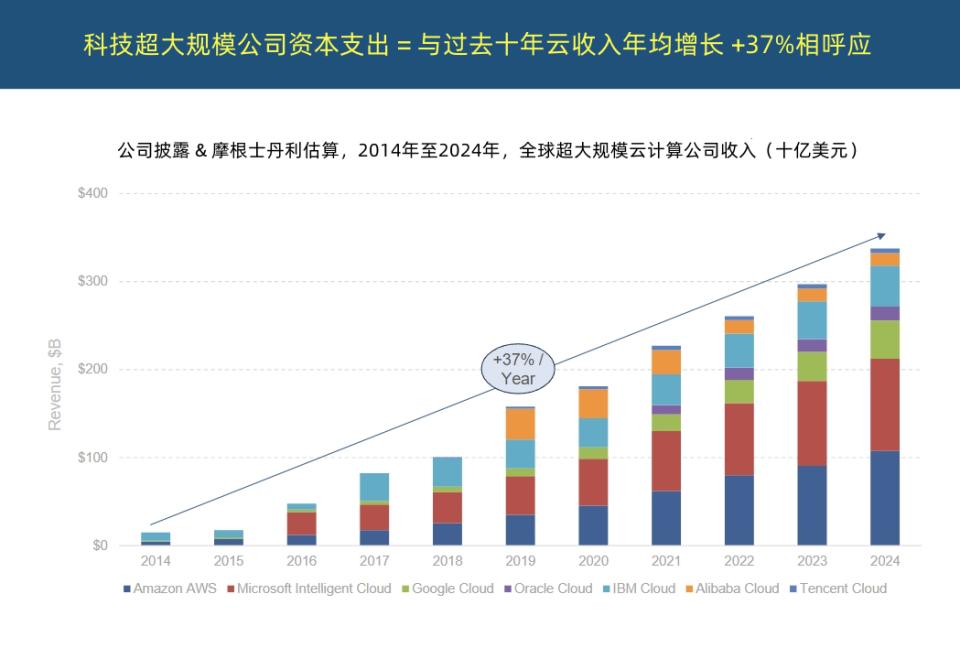

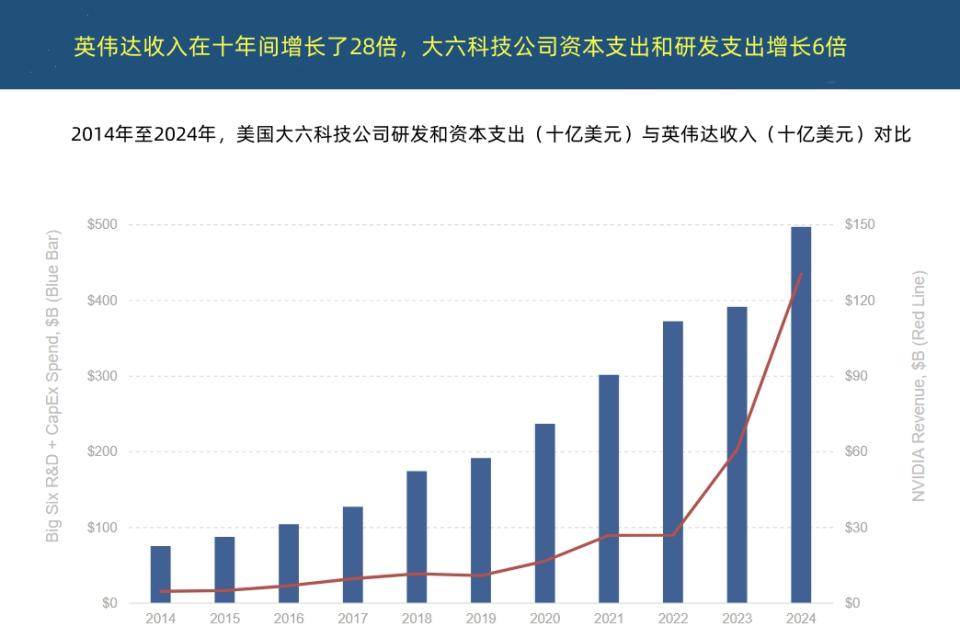

要了解技术领域资本支出的未来走向,首先要看看它的过去。过去二十年,技术资本支出经历了几次关键的增长阶段:

最早的资本支出集中在互联网基础设施的建设上——大规模的服务器农场、海底电缆和早期的数据中心,这些为亚马逊、微软、谷歌等公司奠定了云计算的基础。

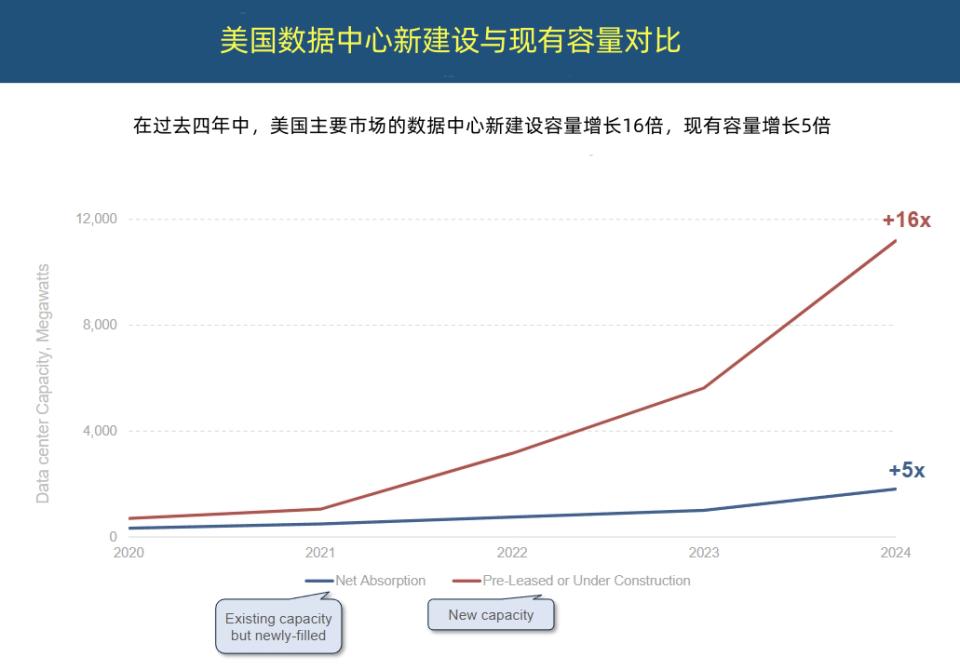

第二波资本支出则聚焦于为数据密集型的AI工作负载提供强劲的计算能力,这是云计算的自然进化。如今,超大规模公司(Hyperscalers)的资本支出预算逐渐偏向于专业化芯片(如GPU、TPU、AI加速器等)、液冷技术以及前沿的数据中心设计。

2019年,AI还属于研究领域,而到2023年,AI已经成为资本支出的重点项目。全球最大科技公司每年花费数百亿美元——不仅仅是为了收集数据,而是为了从中学习、推理,并实现货币化。数据依然是核心,但现在,竞争的优势归属于那些能够最快训练数据、最深入个性化并广泛部署数据的公司。