新智元报道

编辑:KingHZ

【新智元导读】2025年,AI从幻想到现实,AGI祛魅而ASI初现端倪。科技巨头们竞相追逐超级智能,世界正被撕裂成两个平行宇宙:AI拥抱者与旁观者。投资热潮涌动,模型能力跃升……这不仅仅是技术革命,更是人类命运的转折点。

2025年,全球AI领域风起云涌。

通用人工智能(Artificial general intelligence,AGI)开始祛魅,超级人工智能(Artificial Super Intelligence,ASI)开始登上舞台。

Anthropic高管Jack Clark警告:巨变在即,而AI将把世界撕裂为两个平行宇宙。

这一切都是一个长期发展过程的产物,是AI技术、资本、就业和生活交织变革在一起的产物。

AI模型能力跃升,但距离AGI仍有争议:研究显示,2025年AI模型在推理、多模态处理和智能体上取得显著进步。

投资热潮推动基础设施扩张:全球AI投资激增,生成AI吸引339亿美元资金,科技巨头资本支出达4000亿美元,引发了泡沫担忧和能源消耗讨论。

劳动力变革加速,机遇与挑战并存:AI正重塑职场,使用AI工具可能成为求职关键。

应用扩展到日常生活,却未彻底颠覆:AI智能体和机器人进入生产、医疗等领域,似乎提升了效率,但许多人感受到变化有限。

通用人工智能不是终点,超级智能才是起点。

当真正的AI竞赛始于通用人工智能之后!

AI一年,人类千年

至今,自然界的一切智能都是生物智能,都是碳基智能。

但今年的LLM可能是人类有史以来第一次创造出的全新智能形态。

在2025年度回顾中,Karpathy直言:

2025年是我(以及我认为整个行业)首次开始以更直观的方式内化理解LLM智能的「形态」。

在推理、多模态处理和智能体上,2025年AI模型取得了显著进步,如OpenAI的o3系列和Google的Gemini 3。

虽在实际应用中仍存局限性,但AGI曙光现已成为今年行业的共识。

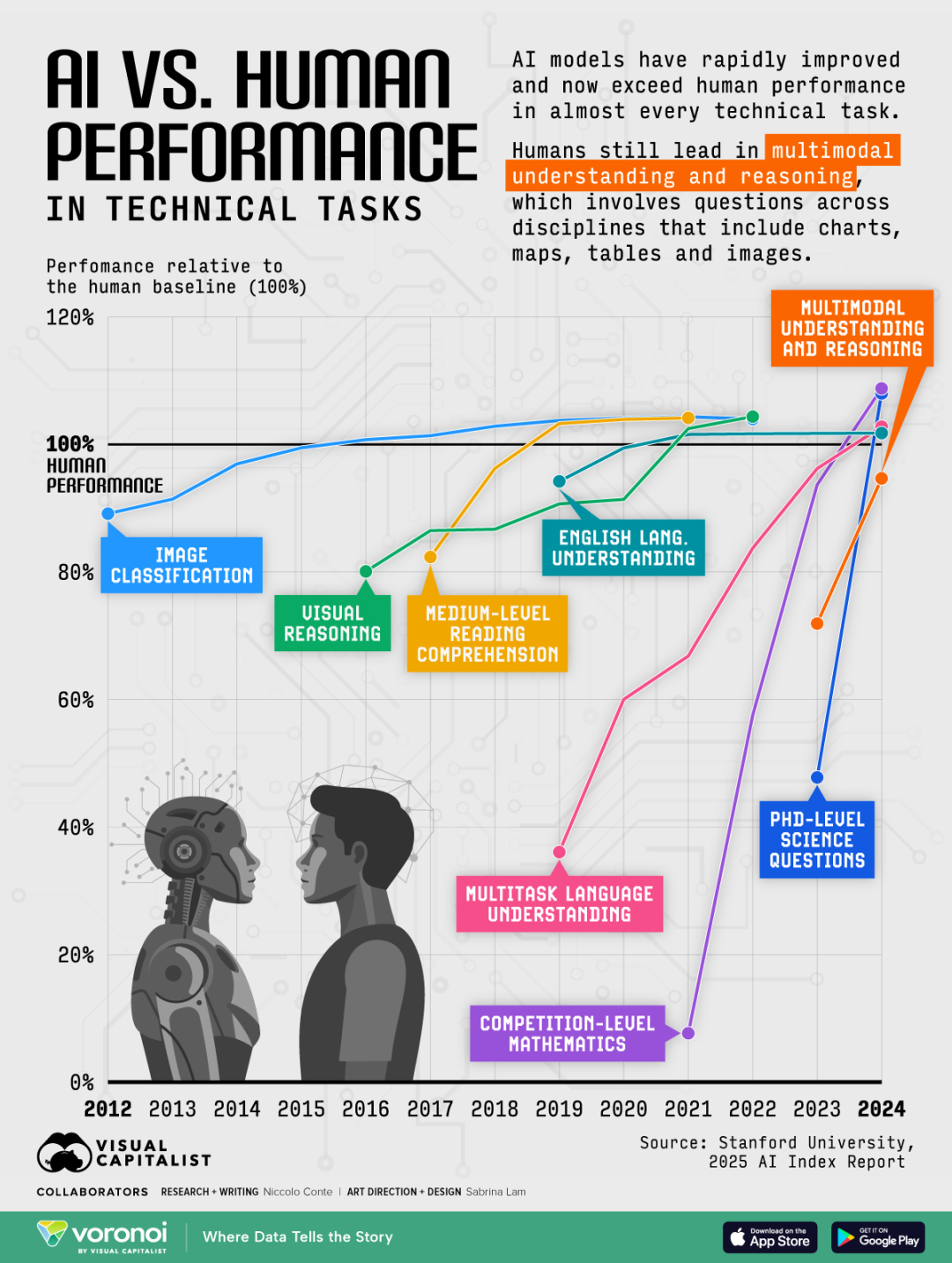

在一系列技术任务中,从ChatGPT到Gemini,许多世界领先的AI模型正超越人类基准线。

据斯坦福大学《2025年AI指数报告》,AI已在7项测试中超越人类基准线,这些测试衡量的任务包括:

图像分类

视觉推理

中等阅读理解

英语语言理解

多任务语言理解

竞赛级数学

博士级科学问题

目前,AI系统唯一尚未赶上人类的领域是多模态理解与推理。这项任务涉及跨多种格式和学科(如图像、图表、图解)进行处理和推理。

然而,这一差距正在迅速缩小。

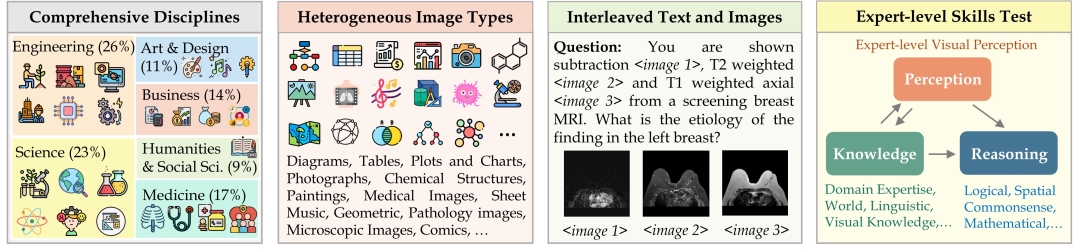

MMMU基准测试,评估模型在需要大学学科知识的跨学科任务上的表现。

MMMU数据集的四大特性:(1)全面性:涵盖六个广泛学科领域与30个大学科目,包含1.15万个大学难度级别的问题;(2)图像类型高度异质:包含极其多样化的图像类型;(3)图文并茂:文本与图像交错混合,需要跨模态理解;(4)专家级感知与推理:要求具备扎根于深厚学科知识的专家级感知与推理能力。

此基准测试日益饱和:

在2023年底,谷歌Gemini的得分仅为59.4%。

到2024年,OpenAI的o1模型取得了78.2%的分数。

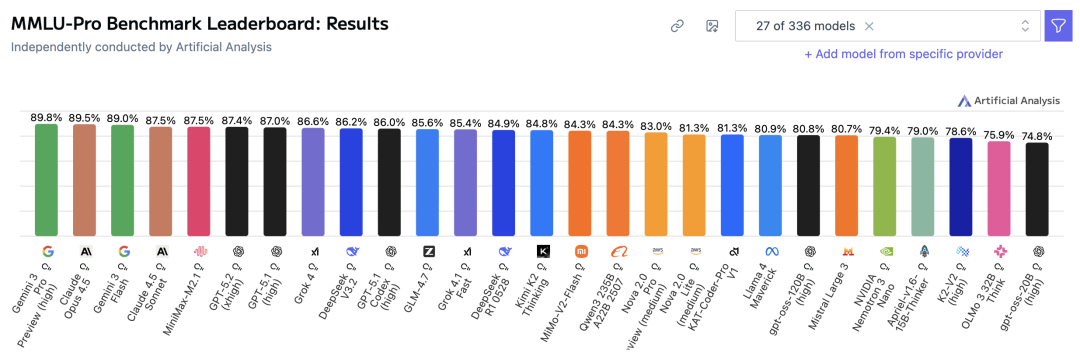

今年,Gemini 3 Pro在增强版MMMU-Pro上取得了89.8%的得分。

斯坦福AI指数报告显示,生成AI投资达339亿美元,同比增长18.7%。

前沿实验室每8-12周发布新模型,OpenAI的o3系列(包括o3-mini)以「先思考后回答」的推理机制脱颖而出,使用10倍token提升智能,但成本也相应增加。

谷歌的Gemini 3被誉为多模态巅峰,能处理文本、图像、视频和音频,实现深度推理。

在Reddit上,年初,关于前沿AI模型开放获取的讨论十分热烈。

DeepSeek-R1及其开源蒸馏版本主导了相关话题。不过,用户指出本地可运行的版本是蒸馏模型(8B或32B参数)而非完整的671B版本,其性能大致相当于GPT-3.5水平。

更深层的讨论焦点在于DeepSeek的开源决策——尽管据报道其实现了45倍的训练效率提升。

随后,有研究者在3B参数模型上以低于30美元的成本复现了DeepSeek-R1-Zero的强化学习训练方案。

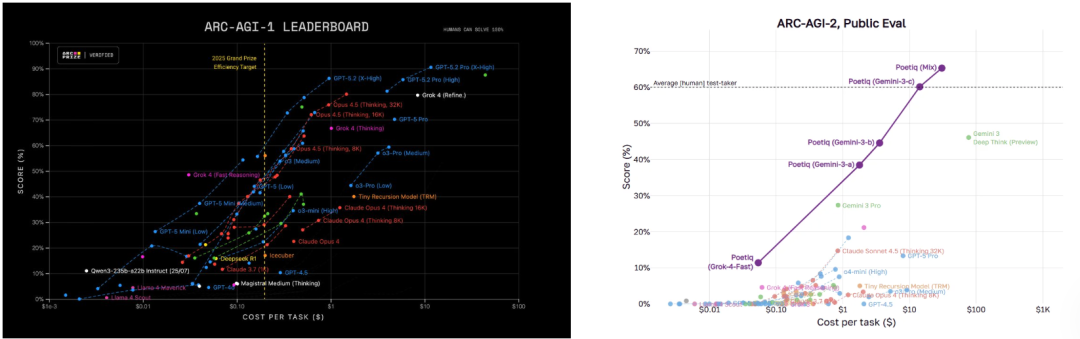

通用人工智能测试基准ARC-AGI-1,最佳成绩超过近90%;ARC-AGI-2上,AI超过了人类平均水平。

但Yann LeCun指出,自回归LLM有局限,需更多感官数据。

总体,2025年AI从「聊天机器人」转向「智能体」,如Agentic AI,能自主规划和执行任务。

AGI决赛在未来2-3年

如果说前几年是「把模型做大」,2025年更像是「把模型落地」。

围绕代码、推理、多模态、长上下文与企业可用性,国外几家AI巨头争分夺秒,寸土必争。

关于AI未来的讨论,变得越来越宏大而真实。科技领袖们越来越多地谈及追求通用人工智能(AGI)乃至最终的超人工智能。

AGI指能在广泛任务中匹敌人类智能的AI系统,而ASI则指超越人类能力的系统。

六月,扎克伯格成立Meta超人工智能实验室,瞄准「个人超级智能」。

九月,奥特曼表示社会需为2030年前可能出现的ASI做好准备。

Anthropic现任CEO坚信,到2027年,AI将在「几乎所有领域」超越人类。

而以乐观预测著称马斯克更是断言,明年AI的智力将超越最聪明的人类。

这些科技巨头不愿错过AI浪潮。

扎克伯格称,宁愿「冒险误投数千亿美元」,也不愿在超智能时代落后。

以6320亿美元净资产位居世界首富后,马斯克告诉xAI全体员工:

若能挺过未来两到三年,xAI则有望成为AI的胜利者。

Databricks CEO等领袖认为行业已实现AGI,而DeepMind联合创始人哈萨比斯等则更谨慎,称AGI可能「在未来五到十年内」到来。

尽管时间表存在分歧,科技领袖们普遍认同一点:AI进步正在加速叠加。

这种加速肉眼可见。

一年内,OpenAI发布了约30多项新产品和重大更新:

年初:高效模型和智能体(如Operator、o3-mini);

年中:多模态和智能体工具(如Sora 2、AgentKit);推出开放权重模型(如GPT-OSS)和GPT-5;

年末:优化专业任务(如GPT-5.2系列)和创意工具(如ChatGPT Images)。

谷歌、Anthropic和xAI也各领风骚:

在年初看来宛如魔术的功能,如今已习以为常。

中国开源AI崛起

DeepSeek年度最大黑马

2025年,开源社区也热闹非凡。

围绕LLaMA、DeepSeek、Mistral以及各类大模型方案,出现了大量工程化工具链:从微调(fine-tuning)框架、推理加速、到本地部署一体化方案,门槛持续下降。

中国开源模型崛起,Llama彻底出局。

DeepSeek成为年度最大黑马。DeepSeek-R1成为历史上第一个通过同行评议的大模型,喜登Nature封面;创始人梁文锋入选Nature年度10大人物。

Mamba在初期备受关注后,逐渐淡出视野,在研究之外缺乏实际应用。

Reddit网友指出,虽然Mamba在理论上展现出潜力,但 Transformer 模型已在硬件和软件层面深度优化,使得用未经验证的架构重新训练大型模型在经济上难以证明其合理性,特别是当结果与现有模型相当或更差时。

甚至Mamba的实际性能与优化后的Transformer模型相当或更差。

成熟的Transformer软件生态系统带来了巨大的转换成本,且Mamba的固定状态内存无法选择性地检索被忽略的 token。

在计算机视觉领域,Vision Transformer是否已取代CNN的问题仍存在争议。

Reddit讨论显示,Transformer在许多任务中越来越受青睐,并在大数据集上表现出色,但CNN和混合架构在小数据集、医学影像和特定领域仍具竞争力。

Reddit网友指出ConvNeXt是强有力的替代方案,Transformer需要更多内存且难以处理可变图像分辨率,数据集质量比架构选择更重要。

为未来做好准备

在过去一年中,记者Lee Chong Ming倾听了超过50位科技领袖关于人工智能的深度讨论。

从执掌万亿级企业的巨头到押注AI未来的年轻创业者,他们的洞见揭示了AI如何重塑工作生态与未来走向。

在董事会、行业峰会与播客访谈中,除了AI在加速,还有3大最常见的观点。

1. 善用AI,否则你可能被更懂AI的人取代

英伟达CEO黄仁勋今年已多次强调:

每份工作都会受到影响,而且是立刻受到影响。这是毋庸置疑的。你不会被AI取代,但你可能会被更善于使用AI的人取代。

其他科技领袖也呼应这一观点,有人指出年轻员工可能更具优势,因为他们已习惯使用AI工具。

OpenAI的奥特曼八月在YouTube节目「Huge Conversations」中表示,虽然AI将不可避免淘汰某些岗位,但大学毕业生更有能力适应变化。

如果我现在22岁刚毕业,我会觉得自己是史上最幸运的一代。

奥特曼补充道,他更担忧年长员工将如何适应AI重塑的工作环境。

「AI教母」、斯坦福大学教授李飞飞直言,相较于学位,掌握新工具的能力更重要。

她认为,抗拒AI是职业发展的致命伤。在她的初创公司World Labs中,她不会雇佣拒绝使用AI工具的工程师。

这种转变已在日常工作中显现。

2. 软技能在AI时代更具价值

科技领袖们达成的另一共识是:AI使软技能变得更为重要。

五月,Salesforce首席未来官 Peter Schwartz告诉媒体:

最重要的技能是同理心,是与人协作的能力,而非编程知识。 有家长问我孩子该学什么,是否该成为程序员?我说「学会如何与他人合作」。

领英亚太区首席经济学家Chua Pei Ying七月也表示,她观察到:对资深员工和应届毕业生,沟通协作等软技能都日益重要。

随着AI自动化部分工作、使团队更精干,工作中的人性化部分开始愈发关键。

3. 人类必须居于AI的核心地位

许多领袖在AI加速发展中反复强调人类掌控的必要性。

微软AI负责人苏莱曼表示,超人工智能必须支持而非压制人类自主性。

他在十一月表示,团队正「试图构建人道主义的超人工智能」,并警告比人类更聪明的系统将难以控制或与人类利益对齐。

Anthropic CEO阿莫代直言AI被误用的风险。

在二月,他表示,先进AI虽能降低知识工作门槛,但风险与回报同步增长。

我们的负责任扩展政策只关注三大风险领域:AI自主性、以及化学、生物、放射性与核威胁。

这涉及可能危及数百万人生命的AI自主性严重滥用。

被誉为「AI教父」的杰弗里·辛顿八月指出,当AI系统超越人类智能时,保护人类将成为核心挑战。

我们必须确保当它们比我们更强大、更聪明时,依然在乎人类。

2025年AI虽未「颠覆一切」,但奠定基础。

Karpathy称AI跨过「英语编程」门槛。

未来,需关注人文超级智能,确保AI服务人类。无论你是从业者还是普通人,学习AI工具是关键。

这一年,AI从炒作到现实,提醒我们:技术是工具,智慧在人。