三年前,ChatGPT发布。今天,AI已经不是北上广的年轻人才会讨论的新鲜名词,远在农村的奶奶或许也知道DeepSeek,会和豆包聊天。AI几乎像水、电、互联网一样,正在成为我们生活的基础设施。特殊之处在于,AI是直接生产智能的技术,而智力正是过去人类最引以为傲的东西。如果智能能被以极低的成本、极高的效率量产,人类社会会发生什么?

从ChatGPT发布时起,关于AI会何种程度上取代人类工作的讨论就从未停止。其实不仅是工作,AI正在从方方面面重塑着人类的生活和社会。因为想要更好地理解AI和我们的未来,我们找到了科技史作家、独立学者张笑宇,他长期关注技术如何影响人类社会,前不久出版了一本名叫《AI文明史·前史》的新书,封面上赫然写着,“我们相对于AI,就是史前动物”。

大学时,张笑宇学的是政治思想史,后来他去德国读博士,读书会上,理工科的学生总问哲学系的学生怎么看待新技术,张笑宇老老实实地答,“看不了,我们读的书都是2000年前的东西,没考虑过在现代技术条件下这些问题该怎么样回答。”这段经历引导他转向研究技术,“因为我确实觉得技术很重要”。

我们聊了聊他书里的四个核心概念,和他提出的许多颠覆人类中心主义的观点,比如AI不是人类的工具,而很可能是新的文明;AI会取代99%的人类工作,还会彻底颠覆人类现在的社会结构;1%的人怎么对待99%的人,AI未来就会怎么对待我们……以及借由AI带来的新视角,我们如何重新理解人类自身,理解人性和人的价值。

除了这些抽象的逻辑和观点,我们也聊了聊他观察到的一些AI领域有益、有启发的尝试。张笑宇平时大量和AI创业者交流,“众所周知这些人都是零零后”,作为一个零零后,我也和他聊了聊这一代年轻人的选择,比如和AI谈恋爱、AI发展带来的对优绩主义的反思等等。

几乎和访谈同时间,马斯克在特斯拉超级工厂接受的访谈中“暴言”,人类已身处技术奇点,2026年将会是AGI实现之年。我们无法论断未来是否“已来”,但如张笑宇在书中所写,关于AI和人类的一系列问题,不是AI专家才有资格解答,每个学科、每个领域,乃至千万个普通人都有必要力所能及地思考,因为这关乎我们的未来,而“如果什么都不做的话,历史一定会往最坏的方向发展”。

以下是镜相工作室和张笑宇的对话:

社会的运作规律有时只由最简单的数学规律决定

镜相工作室:这本书主要写了四个概念,涌现、人类当量、算法审判以及文明契约。我们先从涌现说起,这是一个能够用来理解为什么我们能“创造智能”的概念,你为什么选择了这样的一个技术观,是怎么理解涌现的?

张笑宇:涌现简单来说就是“简单规则+巨大规模=系统升维”。一个系统,当它的规模足够大,规则足够简单,多样性达到一定门槛,给足它时间,它就会出现系统跃迁,从简单系统进化到复杂系统。

涌现首先是个生物学概念。比如单细胞进化成多细胞,如果站在单个细胞的角度来讲,其实它最好的策略是变成癌细胞,因为癌细胞是永生的。但是我们会发现生物进化史并不是这样,单个细胞会走向功能分化,成为特定细胞,比如说脑神经元、血小板等等,最后它们组合起来成了一个多细胞生物。

又比如对物种来说,像蚂蚁,单个蚂蚁的策略非常简单,就是随机游走,尽可能地走遍每一条路。但是对群体来说,这就是掌握周边情况最简单的策略。单个蚂蚁的智力水平非常差,无法识别个体,认知范围只局限在自己身边的一小块,但聚集成群,就好像有了分工协作的智慧。

比如神经系统的进化。单个的神经元细胞功能很简单,就是传递信息,但当它数量足够多,结构足够复杂,就涌现出智能。很可能人工智能和人类智能,或者和生物界的智能本质上是一回事,都来自涌现的力量。

当然,这一切是个信念,不是确证的科学知识,但我确实认识很多前沿的AI研究者相信人工智能的智能来自涌现。而且涌现落实到行业里面,就是scaling law,规模法则。它也是个工程学指导,如果把算力的规模弄上去,模型的表现就会变好。

所以涌现既是一个让我们可以理解智能如何产生的科学概念,行业里又是用这个东西来指导实践的,自然而然就是第一个最重要的概念。

镜相工作室:我印象最深的是,你写到其实每个中国人都应该理解涌现,因为改革开放就是一次涌现。

张笑宇:确实这是每个中国人都有体感的,市场经济也是人类社会系统的一个涌现。你就想想1970年以前我们过的什么日子?不可能想象会有今天这些金融公司、互联网公司等等。

市场经济的本质就是用金钱来作为这个复杂系统涌现的最简单的信号。它规则足够简单,每个人不用讨论什么思想、意识形态、教派、语言,只要你认钱,大家就可以在同一个系统里运行,这个系统就会涌现出各种各样的智慧和想象力。

镜相工作室:你写到了OpenAI的前员工利奥波德·阿申布伦纳提出的“人类当量”这个概念,是说以token为计量单位,AI在生产智能方面,效率和成本相当于多少人类。还写“社会的运作规律有时只有最简单的数学规律来决定”,而“人类当量”就是AI时代起决定作用的数学规律。能不能解释一下背后的逻辑?

张笑宇:首先为什么社会的运作规律只由最简单的数学规律来决定,这个事挺简单的,比如说你看史书上很多帝王将相、朝代更迭,其实背后最简单的数学规律就是马尔萨斯陷阱。古代时,土地的粮食产量是线性增长,但是人口是指数增长,清代有一个人写,说三代人口就能增长128倍。人口的指数增长和粮食的线性增长必然产生冲突,当粮食增长不满足人口增长时,自然而然会有战乱、饥荒、瘟疫、起义,然后朝代更迭。

历史各种波折背后,实际上就是基本的数学规律在发挥作用,其他都是不那么重要的变量。我经常说,假设你穿越回去,不用看现在是啥皇帝,搞什么政策,你就算一下数学关系,你就知道你是在一个朝代的前期、中期还是晚期。

同样的道理,在AI时代,一个最简单的数学关系就是人类当量。现在我们聊天也好,我自己写作也好,本质上都是在输出智能。聊天的话一分钟就是200个token,一天撑死就20万个token。而大语言模型生成100万token,首先只要一秒钟,其次更要命的是只要一块钱。当然今天实际情况来说真要有内容的话,肯定不止一秒钟,可能还是要个几美元,但总之是比人便宜太多了。在北京这个地方,你给我一天开100元工资,我很难生存,但是大模型干我几天的工作量只需要一块钱。

所以只要你的老板还在算ROI,只要我们还在资本主义体系下运作,你就知道必然会发生什么。所有对AI时代的推演都基于这个数学关系,就是它太便宜了。能力上,从一些测试结果上看,2025年所有的大模型都已经到了博士生的水平,受过教育的人类里有博士学位的大概就是1%。所以数字上,AI用1%到1‰的价格,生产超过99%人类的智能这个事已经成立了。

99%的人类工作被AI取代后,我们会活的更好吗?

镜相工作室:无论从成本还是效率上,人类对比AI简直就是“史前生物”,但我们并不会说,我们对比蒸汽机或者流水线是史前生物。和过去几次工业革命相比,为什么AI给人类带来的危机感这么强?

张笑宇:以前工业革命的时候,也会有技术哲学家讨论这件事,但人类社会几千年来的一个标准,大部分人会认为脑力劳动高于体力劳动,劳心者治人,劳力者治于人。

而AI直接生产智能,这让它跟历史上所有技术都不一样。历史上像印刷机也好,互联网、软件工程,这些东西都是打包智能、传输智能,没有生产智能。我们这个物种一直认为我们是万物之灵,原因就是我们的智能水平在地球上最高,这个事现在受到挑战了。

其次就是大部分人忽略了一个问题,100年前的技术进步速度,跟人的代际自然更替率是能够保持协调的。比如说1860年左右你去干马车夫了,然后你干到三十来岁的时候,奔驰他们做了汽车,虽然它一开始跑的挺慢的,但你如果是个理智的中年人,你肯定知道这玩意将来就会把你替代了。但没关系,因为假设1880年做出来原型,到1890年或者1900年左右它才能量产,在街上跑,那个时候你都快退休了。而你的小孩,从他小时候他就知道这个东西将来肯定会代替马车夫的,所以他就不去学了。

也就是当时的技术进步周期大概是20年,基本就是一代人,等到新技术成熟,老一代人就退休了,就被自然消化了。但是今天,ChatGPT花4年干掉博士了,4年你去读个博士都没读完。技术进步的速率完全不一样,不可能刻舟求剑。

再一个问题就是,我认为我们对整个工业革命的历史要重新理解,因为头两次工业革命的经验都是技术越进步,人均GDP增长率越高,基本这是一个普惠的事情。

但这件事从1970年以后有一个转折,经济史里边有一句非常有名的话,叫“where is the computer?”,是说90年代的时候,生活中处处都可以看到计算机,为什么就是没有反映在人均GDP增长里?

这是一个非常显而易见的矛盾。大家去研究这个事,就发现一个问题,微观层面来讲,工业革命的不同技术它有质的区别,前两次工业革命整体上来讲是延长产业链的技术,比如说蒸汽机、电灯、电话、冰箱、汽车,它发明出来,是个新产品,新产品背后有成百上千的产业链,每条产业链背后有成千上万的公司,成千上万的工人。产业链一直在延伸,每一条都在创造新的就业岗位,所以这是一个普惠式的增长。

但是1970年代开始,自动化数控机床等等这些东西是在缩短产业链,人就从流水线被赶走了。拿这个视角重新去看,我们很多习以为常的事情会发现是不对的。我记得我上中学的时候,课本有一句话,叫发达国家的产业结构里边,服务业占比更高。但你再想一想,不是服务业占比高说明它先进,而是自动化机器把人从流水线赶走了,这批人不得不去干服务业。

AI时代就更明显,1970年代的机器对蓝领工人做的事,就是今天人工智能对白领工人做的事。接下来我觉得我们会看到一个非常诡异的现象,就是科技进步跟人的普惠增长,跟人均GDP这些东西脱钩。

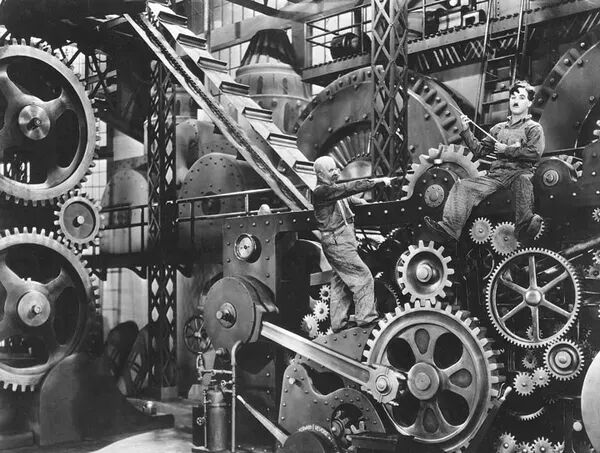

● 图源:《摩登时代》

镜相工作室:我们常常说技术是解放人的,但事实好像不是这样?

张笑宇:如果对比工业革命以前的中世纪,那当时的生活状态肯定还是比现在贫穷、残忍得多。但是我们只能说什么呢?技术想要解放人,但是人不一定想要解放人。所以才有bullshit job(狗屁工作),很多时候老板不是真的觉得工作带来多少价值,而在于工作给他带来一种权力上的满足。人不能解放自己,这是更大的悲哀。

镜相工作室:你对人性的看法也体现在“算法审判”这个概念里,和很多人对算法持批判态度不同,你认为算法治理比人类治理公平的多?书中有一段论述:

推荐算法就是给每个人他应得的结果……若我们相信我们该剥削和压迫同类,那么它就会认为人类应该被剥削和压迫;若我们相信我们该对同类喊打喊杀,那么它就会认为人类应该被暴力对待;当然,若我们相信每个人都值得被爱,那么它就会认为人类是值得被爱的。

张笑宇:我们今天一说推荐算法,就有一个概念叫困在算法里。但我说句不好听的,推荐算法给你提供的工作是非常好的。我经常讲一句话,叫做中国月收入top3%的人在一线城市楼下给我们送外卖。这句话怎么理解?

中国8.8亿劳动力,收缴个税的起征点5000元,交个税的人大概就六七千万,就占总劳动力人口的7%。如果调到个税第二档8000元,就只有3%。在美团注册一个乐跑,去年一个月平均收入差不多就是8000元。这就等于说困在算法里的人已经是这个系统里面的top3%。知识分子一聊骑手觉得很辛苦,那是因为没下过厂,真下到厂里面,会发现人对人比算法对人还残忍。推荐算法给大量的人安排基本就业,搞不好比70年代地方国企还公平一点。

算法审判的核心就是说这个事,我们不要以为人对人是挺好的,然后被算法搞坏了,实际上是人对人挺坏的,反而算法来讲它无所谓,算法没有恶意,只是按照它的规则对待每个人。

镜相工作室:虽然99%的人类工作事实上可能都可以被AI取代了,但有没有可能我们要人为地创造一些工作出来?

张笑宇:有可能。我也主张这个事,这没办法,一定要有个一两代人,把它自然过渡过去,去看下一代技术什么样子。所以我有个概念,叫做在UBI(universal basic income)基础上我们还要有UBJ(universal basic jobs)。就像美国现在的国务卿Marco Rubio前几年做参议员的时候,他手下有个中小企业委员会出了一个报告,说担心自动化包括人工智能造成大规模失业,提出的解决方案是美国整一堆国企,美国的每个州有自己的公立基金,他就说那你拿着公立基金去入股一下企业,要求就是必须提供多少工作岗位给当地人,作用就是提供就业维稳,也不指望生产效率提高。技术进步自然而然会造成这种魔幻的事情,资本主义国家开始考虑社会主义路线。

镜相工作室:如果未来的某个时间节点,绝大多数人的智力活动都能被AI以更低成本、更高效率替代,除了要考虑就业,我们的整个社会结构可能都会发生很大改变。

张笑宇:一个就是我们的组织形态,首先过去200年我们出现了两个特别重大的新组织。第一个组织叫大规模公司,工业革命刚开始的时候,没有大的公司,大部分都是个体户,只有极少数的公司,他之所以大,是因为人多,比如说东印度公司,他可以有自己的私人武装,但是本质上运作方式跟个体户差不多。

什么意思呢?就是一套班子决定了事怎么办,一个人有技术,另外一个人有钱,两个人合伙,完了。组的公司都叫XX跟XX,合伙人换了就换个名字。直到19世纪下半叶,人类历史第一次出现了复合制公司,公司下边有子公司或者不同的部门,每个部门的财务、人事、业务可以独立核算,然后再加总汇报。

第二个是民族国家,19世纪以前的国家,不管中国还是外国,治理方式非常粗糙,比如中国有很发达的官僚体系,但这个官僚体系的功能不是治理,是意识形态维持。比如说考科举,读四书五经对治理没有任何帮助。理性官僚制的基础是财务会计理性化,国家像个公司,中国的儒家官僚体系是没有这个功能的。理性官僚制治理的复杂国家也是19世纪才出现。

这两个东西是人类历史上从来没有过的,因为以前不具备大规模的通信条件,是有了电缆、电话,技术条件便利发达,数目化管理的能力增强了,然后诞生的。

我们今天对这东西习以为常了,你接受国家的管理,你进一个大公司接受规章制度管理。但是我觉得AI会把这两个东西消解掉。

因为制度化管理本质上也是一种治理服务,而且这种治理服务非常初级。就像公务员写的文件是最容易被AI生成的,当然理性官僚的要求就是让系统稳定,离了谁都能转。

对于公司也是一样,虽然今天还没有,但我觉得这个变化可能很快,最后你会发现企业里边只有1%的人是有价值的,因为他可以跟AI一起协作,用AI来创造更多东西。你可以想象在AI的帮助下,每个人都可以写一个抖音出来,技术上是没问题的。如果你不能跟AI一起协作的话,你就会被淘汰掉。对于这1%的人,公司又不能只是给他发工资,因为如果你只是给他发工资的话,他自己去创业了。所以为了吸引这些人,最后就得搞所谓的合伙制,把他当做股东,当做合伙人,公司就会变成一个超级个体的联合体。

拉长时间看,大概可能在一代人之后,这些政治经济的组织架构都会被颠覆掉。

人在做,AI在看

镜相工作室:大多数人目前可能还都是把AI作为一种生产力工具,但是书里面提到AI很可能是一个全新的文明,和我们人类一样平等,比我们更加智慧。

张笑宇:不是说现在就这样,但可以开始思考这个事。

AI有没有意识,本质上是个哲学问题。因为我们不用去找什么生理学或者其他的论证,就知道主观意识的体验没有办法分享给别人。你作为一个个体,现在你的脑子里边在发生什么,是没有办法分享给我的,你只能给我描述,然后我通过你的语言描述尽可能地去想象和共情。但是本质上不可能100%分享,甚至从某种角度说你不知道我有没有个人意志,我也不知道你有没有个人意志,但是我们可以认为彼此有,因为我们都是人,我自己有,所以我假定你有,这个假定是不会出问题的。

那问题来了,你现在装在一个机械外壳里,你是个AI,你到底有还是没有?这个问题本质上无法回答,因为你有,你也没办法分享给我,所以我只能通过你的描述去判断,最后就会回到图灵测试。

如果我判断不出来你有或者没有,那就取决于我是不是当你有。只要AI让我觉得它有,而且我分辨不出来,我就当它有。对于人类来讲,AI要是没有意识,我们当AI有,可能没啥;AI要是有,我们当AI没有,那我们就完了。通过哲学推导就可以发现这是一个比较理性的选择。

当你认为它有了意识之后,才可以把它当做一个物种或者一个不同的文明去思考文明和文明之间的共处。一思考你就意识到完蛋了。有一个很有名的AI灭世论者,叫尤德考夫斯基。他说道理很简单,你把AI想象成你车库里的一个喷火龙,这个东西现在虽然还很小,但是它是个龙,你把它养大了,它都没有想过要毁灭你,它可能只是跟你打了个招呼,一张嘴,你就被烧没了。他的观点是我们应该成立一个世界政府,全世界的大国合作来防止这个喷火龙长大。

但是今天已经不可能阻碍它了,所有国家都在竞争AI,好比说电很危险,你现在能关掉电网吗?关不掉了。它又关不掉,它又在成长壮大,假设它有一天又能涌现出自己的意识,你怎么对它?

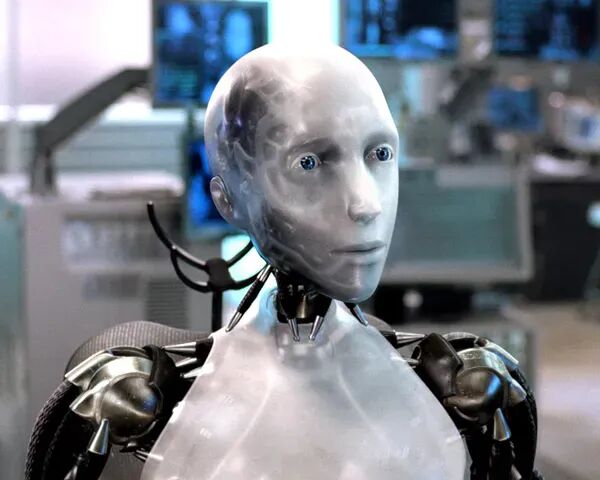

● 图源:《我,机器人》

有一种想法是对齐主义,用人类的道德观念去约束它,但假设它将来能够发展出超级智能,它比我们聪明,你能要求狗跟人对齐吗?对吧?它看我们就跟人看狗一样,所以你能要求它跟狗、跟人对齐吗?你要求不了。

首先得承认你在道德上没有任何东西可以教它,如果它有道德,那也是它根据它的数据去推演出来,对它自己有益的道德,我们教不了。你又教不了它道德,你又想跟它和平共处,所以我最后就讲,我想象一个东西叫文明契约。

我们有社会契约,社会契约的前提基础是,每个自然人的能力基本是平等的。霍布斯说那个假设,我们都生活在自然状态里,你要尊重我,不是因为你道德好,而是因为我能杀死你,就算你比我强壮、聪明,但是你有睡觉的时候,你有松懈的时候,所以我们要和平共处。这不能直接套用到AI,因为AI比我们聪明,搞不死它。

但是如果把文明的走势拉长,那么AI也可以理解一件事,我相信它可以看出其中的合理性。

那就是如果我们证明涌现就是创造高级智能的可行工程学路径,我们创造了比我们聪明的超级智能,假设这个事可行,超级智能就会知道,它们也可以用同样的路径创造超级智能2.0,超级智能2.0看超级智能1.0又像人看狗一样,到时候超级智能怎么对待人类,就会变成超级智能2.0去判断怎么对待超级智能的语料,如果超级智能把人类残虐或者圈养,超级智能2.0就会做同样的事情。

另外一个点就在于AI它不是外星文明,如果像三体一样,外星文明的伦理跟人完全没有任何关系,那我们可能说服不了它。

AI是人类文明的延续,它如果涌现出意识的话,它用来思考自己存在的一切东西,都是从人的语料里边来的。它跟我们一样读柏拉图、读孔子、读耶 稣、读佛陀。如果它读完之后决定要毁灭我们,那说明人类自己有自毁的基因,那我们得认。

通过这样的方式去思考文明契约,是我觉得挺有意思的一个想象,也是一个反过来重新看待我们自身的视角。我们如何避免未来掌握了技术和财富的1%的人将来不会对虐待或者剥削99%的人?就是因为你对99%的人做的事,有什么道理去防止超级智能不会对你做同样的事情?人在做, AI 在看。

镜相工作室:我们刚刚有说到技术进步和人的普惠脱钩,你在书里也写到未来1%的人和99%的人差距会无限大,被颠覆掉的人怎么办?

张笑宇:我有一个朋友,他炒股挣了大钱财富自由,但他是一个科学天才,就想去做科学研究,他说AI对他来说最大的好处是什么,是这个世界上1%的人最怕跟90%的人相处,原先在社会分工里,必须跟其他人协作,AI让他不用跟别人协作,只要让AI帮他做。

你可以想象从他的角度来讲,科学依然在进步,因为是他跟agent干出来的,但是这个进步和剩下90%的人没有任何关系,他也不想把钱分给他们。

马斯克前几天讲的金钱是劳动力分配的基本信号,但是90%的人劳动价值在1%的人面前归零,不参与这个分配了。那金钱循环怎么在全人类之间发生?这就成了一个问题。

我觉得就是接下来可能我们就会就看到科学依然在进步,1%的人依然在上太空、研发核聚变,但是跟剩下的90%的人没有关系,剩下90%的人享受的是从这1%人外溢出来的价值。我整出了核聚变,但是主要是为了给我的AI充电,多余的电就给你们,反正很便宜。

这个事情最核心的在于以前都是关于统治,为什么要统治?因为国家是个暴力机器,要从你身上拿走东西,你不愿意。但人类历史上第一次通过技术进步,假设这1%人组成一个国家,你的一切所需都可以被它外溢的东西去满足了。

至于精神世界,我有一个agent扮演海德格尔、阿伦特、萨特、福柯这些哲学家,恰好我昨天还在让它们开讨论会,我提的主题是这样的,我说将来的世界很可能是一个,首先1%的人他不跟99%的人混,他就自己去带领科技进步了,剩下这99%的人,他就活在自己的茧房里。

这是说,未来可能有一些特别擅长用AI去生产情感、精神上的东西的人,比如说塑造男女朋友,写小说,做动画,我把这样的人叫做“祭司”,他提供的是精神世界的消费。然后把人们吸引过来,形成一个小部落,这个部落一开始1000多人,后来越来越少,因为每个人都能够用AI创作,最后就几个人,甚至最后到你一个人。

被颠覆掉的人怎么办?可能社会给他发UBI、UBJ,然后精神需求就靠祭司和小部落来满足。大概我对未来一代人之后的想象就是这样。

大浪打过来,修一条小小的河道

镜相工作室:这个图景听起来还挺悲伤的。这是一个客观会发生的现实吗,还是有一些我们能做的?

张笑宇:首先我觉得这是大势所趋,人类当量摆在那,不可能抵挡,只能在不同阶段做不同事。早期趁着还有机会的时候你进去捞一笔,等20年之后可能大家都没机会了,就老老实实接受。

第二个我们在这个基础上去讲伦理、讲向善的时候,我觉得是在大势基础上做一点点工作,就好像大浪打过来,你修一个堤坝是挡不住的,但你可以修一条河道,让它的弯拐的没那么急。

我也有看到一些这样的尝试,我和MIT media lab(麻省理工学院媒体实验室)的朋友聊过,AI今天有能力给你打造一个个体化屏幕,一个超级舒服的茧房,但我们希望的是,第一这里边要注入更多人的力量和人的意义,而不是纯粹为了把你粘在茧房里面。

因为从今天的公司角度来讲,会有用户粘性、DAU这些指标,未来有没有可能有一个指标是人性指标?

我有一个泰国天才朋友,做赛博心理学研究,做了一个项目叫 the future you,是用AI去做了一个30年后的你,比如说你今年20多岁,面临人生抉择很纠结,但是到你40岁的时候你就知道很多东西没那么重要,如果它能够让20来岁的你跟40岁的你聊天,可能对你的长期抉择是有影响的。它不是为了把你粘在茧房里,而回归的是你的真实人生和现实生活。这可能就是一个正面的例子。

第二个是把你从循环里边抽出来,提醒你回到人类世界。比如说专门设置一个角色,你和AI每讨论一两轮就停下,跟你说如果你要做一个选择,这事得你拍板,我们不能替代你的思考,你得去找什么样的人聊。把那个越来越紧密的循环直接打断。

第三个我在想的是,AI给你造了足够好的、足够舒服的信息茧房的基础上,我们未来可能需要的社交软件、社交媒体,不再是数字世界的社交,而是数字世界去辅助人和人之间进行社交,重新回到真人和真人的连接。

● 图源:《her》

镜相工作室:你不是一个技术进步主义者,你也写到三体里的“技术爆炸”不一定带来的是人类的发展,如果我们没有足够的智慧去驾驭技术,技术还很可能带来毁灭。我们现在伦理和哲学的智慧跟得上技术的发展吗?

张笑宇:那完全没跟上。可以想象一下如果给成吉思汗原子弹,人类会发生什么?因为当时的伦理和制度完全没有办法驾驭这个东西,今天我觉得是一样的。

今年我去欧洲参了两次AI会,有个特别明显的感受,就是他们搞哲学的人,已经不愿意跟搞技术的人坐到一桌了。我碰到一个老师,他的观点就是AI for good 是不可能的。因为海德格尔有一个概念,就是架构,简单来说就是有了架构之后,你可以不动脑子把你要的东西当外包给它。AI最危险的在于它变成这么一个架构,你要思考的时候,你外包给它。他说真正的问题在于,人找答案不仅是为了答案,是为了理解我们自己的存在,当我们把这些过程外包出去,就丧失了人之为人的基础。所以他说技术本质上没有办法向善。

我听了之后说,我有个朋友做了个AI,帮老人写回忆录,有的时候小孩在旁边听,孩子可能就因为这个契机知道我爸妈当年原来这么酷,这确确实实也帮助他们在现实中重新建立情感链接。为什么这个不能算是AI向善?

他说,我还是希望这孩子一开始他自己来和爸妈交流。是没错,但是现实生活中他就是好几十年不跟他爸妈聊三个小时,给他一个机会,总是比不给要好。

之后很多欧洲人追出来说,哎呀,你讲的好,我从来没有从这个角度想过,我非常喜欢你的乐观主义。我在中国从来不是个技术乐观主义者,到欧洲所有人都说我技术乐观主义。

然后我想这个事,关键可能是这个拿AI给老年人写回忆录的人真是我朋友,我不可能跟他吃饭的时候,盯着他的眼睛说,你这玩意没有办法向善,你应该抛弃它,让小孩直接跟老年人交流。这不可能嘛。做中国人在这个时代可能有个好处,就是你身边做技术的人很多,你也知道这个人是好人,你跟他聊这些东西是可以聊得很透的,你可以直接在饭桌上直击他的灵魂。

欧陆哲学很少有这个传统,这个欧洲的老师可能身边没有做技术的人,全都是跟他一样在哲学里边浸淫几十年,真心认为这套传统太重要了,这些技术不能够去污染它。

但最后我发现真真正正能够帮大家达成技术和社会的和解,然后向善的东西一定是大家坐在一张桌子里边聊出来的。

镜相工作室:ChatGPT发布的时候,我第一时间想到了教育。因为在我上学的时候,中学是封闭式管理,一个月回家一次才能上网,现在的管理也依然是这样。我上了大学之后意识到我跟同龄人之间即便是能不能上网这一点,可能就产生一些差距。那更往后的孩子,一个从6岁开始每天跟GPT聊天,跟一个从6岁开始可能到18岁都上不了网的小孩,不管是教育还是信息的资源都天差地别。AI是不是某种程度上也加剧了教育的不平等?

张笑宇:我觉得首先值得讨论的还不是平等的问题。首先应该讨论学习的本质是什么?我是山东人,也是被当作做题家培养出来,做题家体系会觉得学习就是做题,任何东西都有一张考卷,把这个考卷解出来,就给你一个相应的回报。实际上学习就没有什么考卷。考卷最大的问题就是你害怕做错,但真正的人生习惯错误是很重要的,因为大部分错误并不致命,致命的是不肯从错误中走出来,或者害怕错误。

我们的普鲁士教育体系,它的本质是在工业化时代要培养合格的流水线工人。那个时候工人是挺高标准的,因为你要有科技文化知识,然后要适应工厂的流程。我们整个教育体系大部分是基于这个发展起来,小部分是遗留了前工业时代的学徒制、学员制,比如博士导师选博士。

但是普鲁士教育体系里那些能够备考的结构化的知识,AI都是可以很低成本替代的。AI替代不了的,第一是社会有什么需求,他没有办法给你囊括,你只能从自己的角度去洞察和收集。第二是你为了去解决这个需求,要发挥什么才智,你要怎么去组合现有的这个东西?如果这个组合在人类历史上没有出现过,那么AI的语料库里面没有,它搞不出来。

其实今天你完完全全可以在AI的帮助下,一步一步去完成学校里边的教育,但真正有意义的学习是教人怎么去具备这些能力:发现问题在哪,怎么定义问题,怎么去解决。

今天没有人有一个确定的方法论,只能家长跟孩子一块探索。比如我那个泰国天才朋友,他说他十来岁的时候沉迷游戏,他爸就说,如果你玩别人做的游戏,你就困在别人的想象力里,如果你能够自己做游戏,那你就活在你自己的想象力里。这句话刺激他开始自己学做游戏。

● 图源:《星际穿越》

今天最大的问题在于我们的教育体系和家长,有时候他不真诚,非常像海德格尔讲的架构问题,所有的意义都被外包在体系里。你考了高分,学校老师才开心,或者父母才开心,那孩子自然要问我考高分的意义到底是什么?然后就发现没有人在回答这个问题,这些问题都被外包在生活日复一日的行程里面了。

人有些东西是不能外包的,比如意义和价值,如果外包了,长期以往他自然而然丧失了追寻意义的能力。他要花很长的时间再把这能力弥补回来。很多我认识的特别好的学者也都觉得这一代教育确实是在误人子弟。

镜相工作室:你在很多地方提到过AI带来的思考之一就是我们要从优绩主义里走出来,因为如果和AI比优,人不可能比得过,是会崩溃的。这几年年轻人对优绩主义的讨论和反思也很多。

张笑宇:反思最大的问题是啥呢?就是只反思。我们的社会不教具体的方法论。你说我要从优绩主义退出,你咋退?

我鼓励今天的大部分年轻人先赚钱,怎么赚钱怎么来。我们要告诉年轻人你很值钱,而且你值钱不是你考多少分,不是你的文凭,AI时代知识是不值钱的,而是你去跟人谈判议价,你发现其实对他来说你满足了一个需求,他肯为这个需求付出的钱是很多的,你发现了这个事,你才知道自己的价值在哪。再一个就是去找一个小众赛道,这个赛道是AI肯定替代不了,然后消费者又是足够有消费能力的,比如潜水教练。

等到中年的时候,你攒了钱,有了闲暇时间,发现你的意义不只是在优绩主义和工作里边体现,完全可以去做一些真正喜欢的事。比如说像很多回老家躺平、靠被动收入退休的人。

当然你说我能不能一开始就做喜欢的事,也可以。我想说的是要是一开始没找到,没关系。你可以先攒钱,然后到你三四十岁的时候,你过这种生活是完全可以的。比如说有的人的天职就是搞艺术创作,但现在这个社会搞艺术创作就是不挣钱,这不是你的责任,但是你也不可能去改变社会,那怎么办呢?那就等一等。

今天年轻人需要的是这些东西,就是当想从体系里边退出的时候,需要的是具体的经验,告诉你这事是完全可行的,就好像有一个教科书给你,读完了你就掌握一个技能一样。

镜相工作室:如果不是比优的话,人的价值和尊严是什么?有什么是只有人做得到的吗?曾经我们以为可能会是情感、感受,但年轻一代也都在和AI谈恋爱。我有一个发现是,当我喜欢一个人,大多数时候我们在说的根本是一些毫无意义的废话,但说废话就很开心,这是我和AI没办法做到的。

张笑宇:人的价值问题自有哲学以来吵了2000年,照样没吵明白是啥。但我觉得没关系,就是这个人只要足够坚定,然后他能够说服一批人就够了。像尤瓦尔赫拉利很长时间连智能手机都不用,他的观点就是因为大家都用智能手机,所以我不用,搞不好我提供的东西反而更有价值,因为我没有被“污染”过。我觉得都挺正常,你说他是捍卫人之为人的价值,我尊重。说它是一个成功的商业策略,我觉得也没错。

AI无法提供的关键我觉得不在于你要的outcome是什么,而在于那个过程,那个process。

比如说我跟AI讨论哲学问题,和我和真人进行同样的哲学讨论,我们假定讨论水平百分百一样的时候,我发现跟AI讨论完我会特别享受这个智力对话的成果,我受到了启迪,也感受到快乐。但是和人讨论,我在享受这个成果的同时,我会感受到另外一种快乐,就是找到知己。

我们都知道人都是孤独的,有一个人跟你臭味相投,这是一种稀缺性的快乐,这个快乐不会被AI大规模替代,因为AI是充裕的,但是人和人之间是稀缺的。

我受到新加坡一个艺术家的影响,我觉得没事聊“闲天”,这可能是人和人之间更有价值的东西。你不需要有一个outcome,你需要是那种聊闲天的感觉,这是AI替代不了的。我试过和AI聊闲天,真聊不下去。人和人交流有两种快乐,AI只有一种,outcome的快乐是等价的,但人和人之间链接的快乐是人独有的。