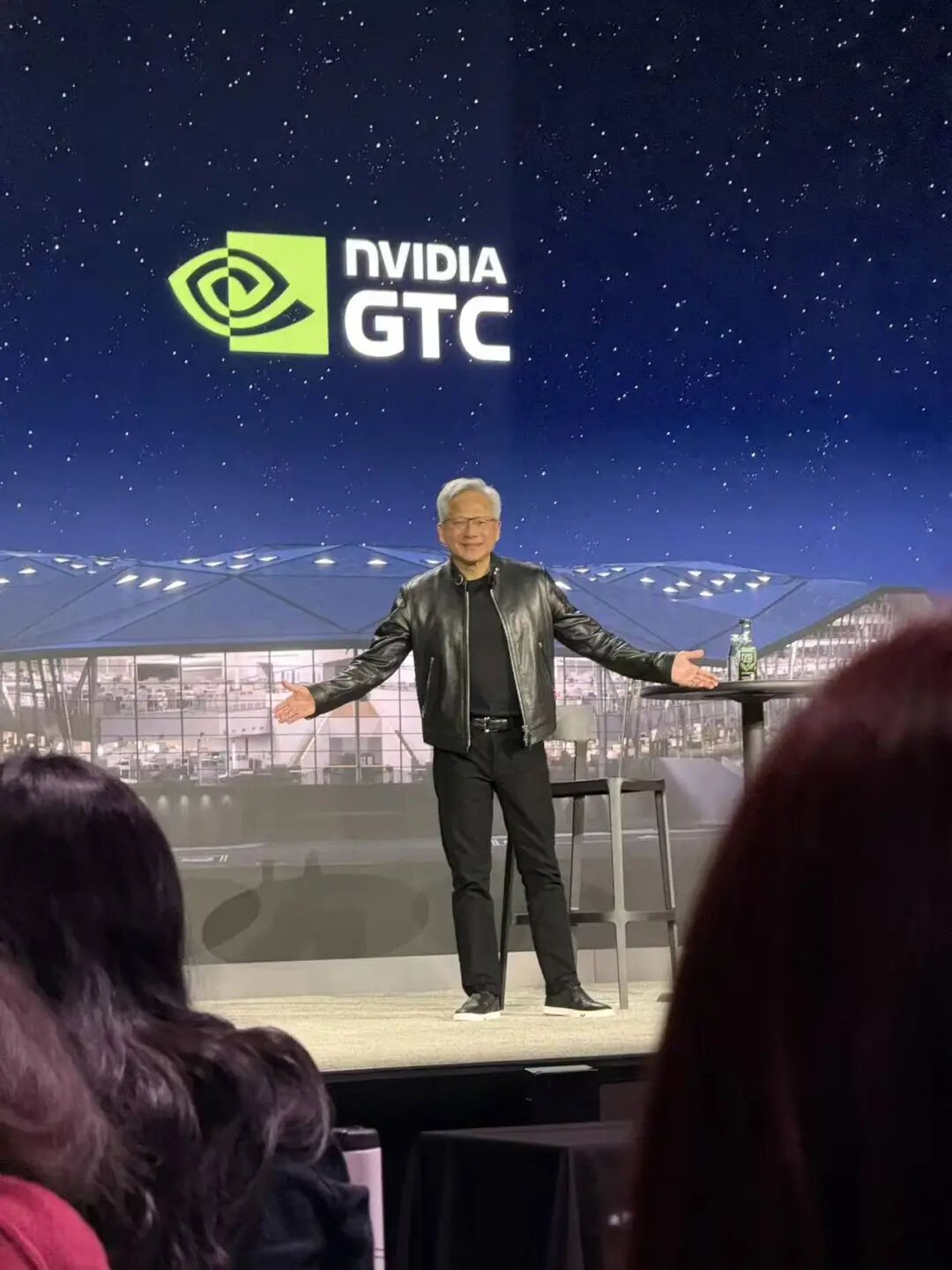

在GTC2026第二天,我们参与了一场与黄仁勋的集体问答,他回答了多个关键问题。

包括万亿美金指引,新Groq的融合,以及AI会让人如何改变等。当然,还包括许多关于OpenClaw的问题。

另外,硅星人也在会后找到黄仁勋问了一个简单问题。

硅星人:似乎今天的问答里,没人讨论开源模型了。

黄仁勋:怎么会。

硅星人:不是都在讨论OpenClaw嘛。

黄仁勋:哦对,是的。

硅星人:Deepseek在走红之前,他们其实也来GTC分享过。今年我看Kimi的杨植麟来分享了。

黄仁勋:是的。

硅星人:你怎么看刚才提到的OpenClaw这些变化。以及如果可以,中国的开源模型们和英伟达的互动和关系简单点评一下?

黄仁勋: OpenClaw 连接了所有的公有云 API。嗯,但你也可以连接到开源模型,对吧?所以,我认为这实际上会加速开源模型的使用。("OpenClaw connects to all the public cloud APIs. Um, but you can also connect to open models, right? So I think that it’s actually going to accelerate use of open models.”)

(他回答了关于OpenClaw的对比,但没有回答关于与中国的开源模型公司之间今天的交流情况的问题)

以下为对话QA核心实录

关于万亿美金的指引

黄仁勋澄清,1 万亿仅包含 Blackwell 和 Vera Rubin 架构到 2027 年的订单,因为去年GTC的PPT里也是这个口径。所以这是个相当“简单且保守”的数字(未计入 CPU、存储等)。

他还透露,随着营收加速增长,英伟达在 2026 年将 50% 的自由现金流用于回购和派息,同时加大对生态系统的战略投资。

关于财务风险与投资

黄仁勋被问到,他们越来越多地帮助客户(如 Coreweave、Nebius 等)融资扩建数据中心,如何管理其中的财务风险?

黄仁勋认为英伟达拥有“信息优势”,能看到订单流和需求管道,因此只投资那些注定会成功的“全垒打”企业。会找到下一个Google和meta。同时,通过注资帮助生态系统快速扩容,这不仅是财务投资,更是为了确保全球计算需求的供应敏捷性。

黄仁勋也解释了对 Coherent、Momentum(光模块/硅光子相关)以及 Nebius(云服务)等公司的数亿美金投资。在上游(Supply Chain),为了应对未来 2-5 年对硅光子(Silicon Photonics)和 NVLink 产能的巨大需求,英伟达通过预付款、提供预测甚至直接投资的方式,帮助供应商提前建立产能。对于下游(Partnerships),投资像 Nebius 这样的公司是为了确保下游有足够的 GPU 上架容量和开发者生态,确保英伟达的 Token 最终能被终端用户消耗。

关于软件公司会消失

“散户们错了。”

他举了Synopsys(新思科技)、Cadence(楷登电子)的例子,他们业务的瓶颈在于“坐在位子上的工程师数量(Butts on seats)”。工程师的人数是有限的。如果有更多的工程师,他们就会授权更多的工具。如果有更多的水管工,你就能卖出更多的工具;如果有更多的木匠,你就能卖出更多的工具。

关于云业务模式

在我们 60% 的业务中(指云端业务),不管是 40% 还是 50%,很大一部分本质上是“英伟达带来的业务”,其余的才是他们(云服务商)的内部消耗。

举例来说,如果没有英伟达,OCI(甲骨文云)怎么可能为 OpenAI 提供服务?他们的整个技术栈都是建立在 Kubernetes 之上的。因此,是我们把 OpenAI 带到了 OCI。

还有很多其他的例子。如果不是因为 Anthropic 今年将基于 英伟达 构建,我们又怎么能把 Anthropic 带到 Azure(微软云)呢?那绝对会大获成功。这逻辑明白了吗?

所以,我们在云服务商那里的很多业务,实际上是由英伟达创造的业务。所有的云服务商都知道,我们与他们有着极佳的营销和业务合作伙伴关系,是我们把客户带给他们的。

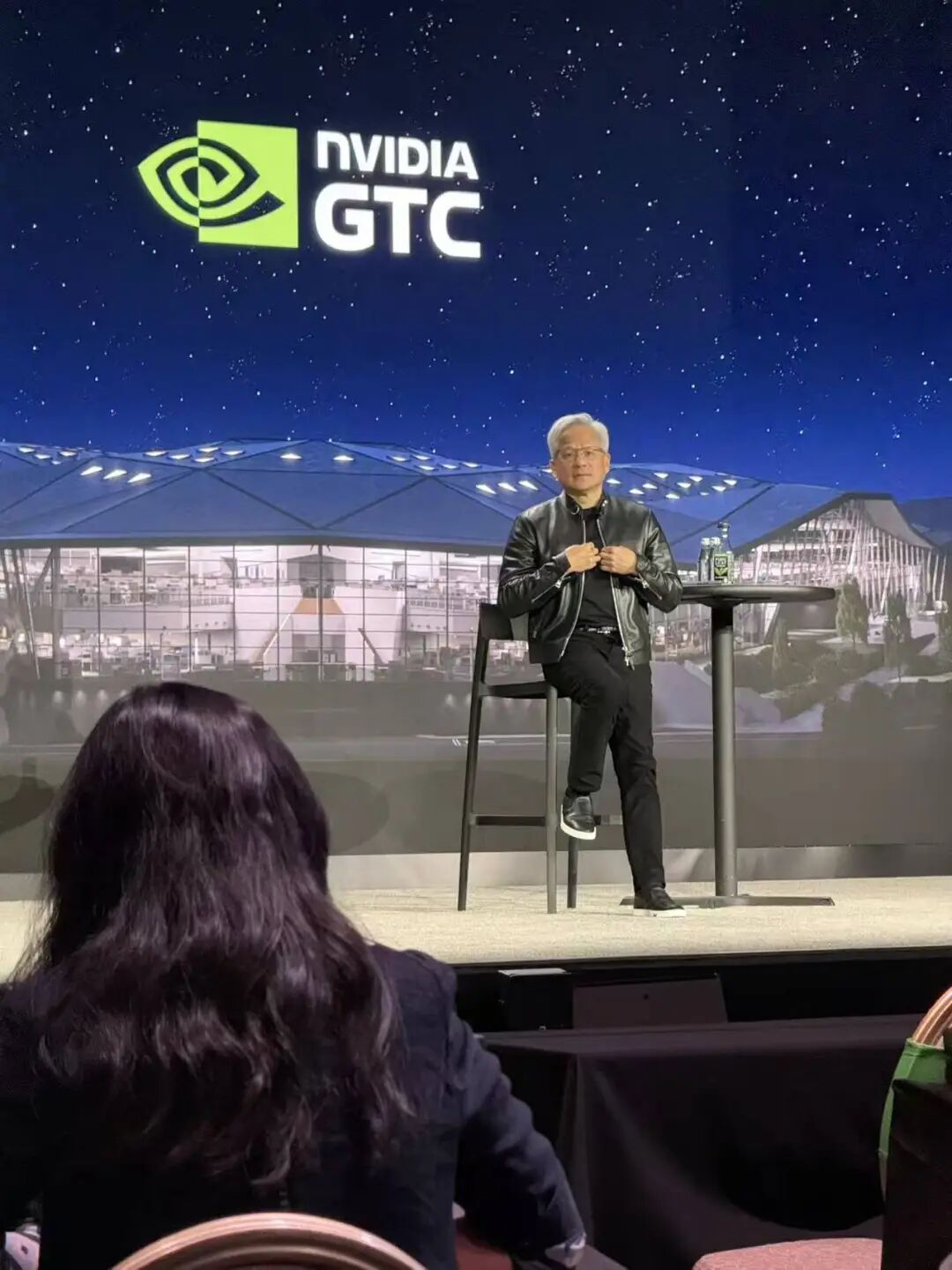

关于OpenClaw

黄仁勋很重视OpenClaw,他自己分享了一个用它来重新设计它的厨房的案例。认为它的学习和形成skill的能力很棒。

他认为 o1 带来了推理拐点,而 OpenClaw 则带来了 AI Agent 的普及拐点。

英伟达要做的是,为了解决开源代理的安全性、治理和隐私问题,推出 Nemo Cloud,作为企业部署 AI 代理的高性能、安全“蓝图”。

关于推理

在对话里,黄仁勋被“质疑”是否在推理(Inference)市场反应迟钝,他表示,他是“推理之王”,这是别人给他的称号。

他强调早在 2024 年底到 2025 年,公司就通过 NVLink 72、FP4 数值格式以及 Dynamo 架构确立了推理领域的领导地位。NVLink 72 带来了 35 倍的性能提升,成本仅为原来的五十分之一,功耗效率提升了 50 倍。他类比 iPhone 和显卡系列,指出推理市场正在细分。从基础的免费模型到 o1/o3 等具备推理能力的模型,再到 Claude Code 等代理工具,不同层级对应不同的计算需求

关于Groq

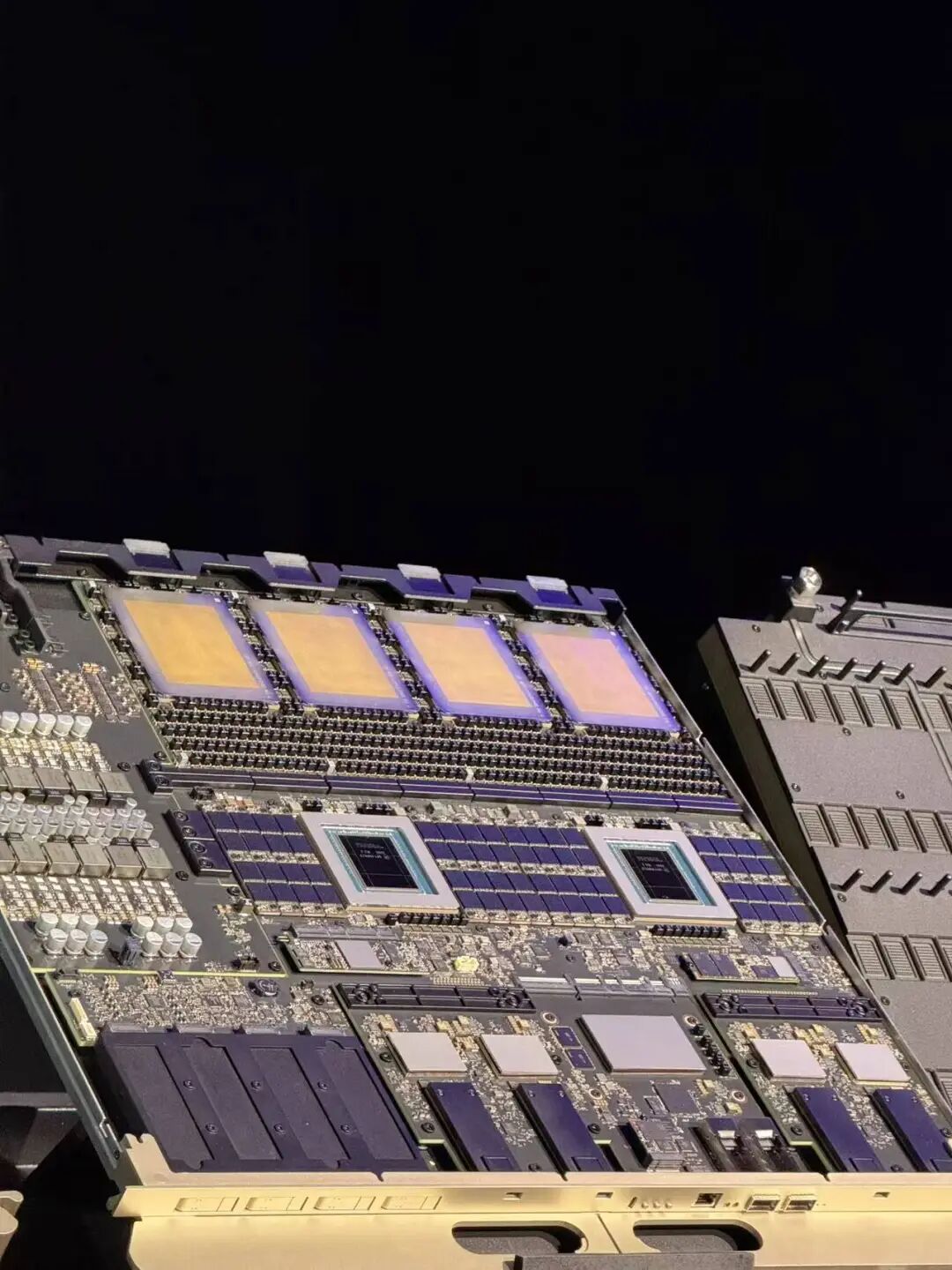

关于Vera Rubin 与 Groq,黄仁勋提出了一个新的高性能推理标准:大模型 + 超长上下文 + 极低延迟。

他提到英伟达的 Vera Rubin 架构是核心,但在特定高速度需求下,结合 Groq(此处指代其 LPU 或特定加速技术)可以实现三者兼顾。市场配比:他预测未来数据中心约 25% 的工作负载会是“Rubin + Groq”的组合,而剩下的 75% 仍由 Rubin 独立完成。

关于 CPU

在超算/云端,传统 CPU 竞争的是“单核成本”;但黄仁勋认为,AI 时代的核心是“工作负载(Work)”而非单纯的核数——用户拥有价值 500 亿美金的 GPU 集群,绝不能因为 10 亿美金的 CPU 性能不足而闲置。因此,英伟达的 CPU(如 Grace)是专为加速工作流设计的,确保 GPU 始终满载运行。

Vera Rubin、存储和网络架构全都是为了 “代理型工作负载(Agentic Workload)” 深度优化的。

一个彩蛋:3D 堆叠与晶圆厂

当被问及 3D 芯片堆叠和具体封装技术时,黄仁勋笑称:

“如果我现在全告诉你了,明年你还来 GTC 干什么?”

以及,关于AI给人带来的改变

“很多人说 AI 来了,我们要没活干了,失业了。事实恰恰相反。个人电脑让我们更忙,互联网让我们更忙,移动设备也让我们超级忙。

AI 将以极快的速度完成任务……以前你写好产品规格,团队拿去开发一个月,这期间你可以干点别的,生活很悠闲。现在,那个‘月’变成了 30 分钟。你始终处于(决策的)关键路径上。

我今天在英伟达的感受是,它让我比以往任何时候都忙……原因在于工作结果反馈给我的速度变快了,项目的数量也增长得快得离谱。

你上一次坐在门廊的摇椅上,喝着一杯柠檬水,看着太阳落山是什么时候? 我不记得上一次的情况了,只记得大约100年前在电影里看到过。 你知道的, 因此我们比以往任何时候都要忙碌。 因此,我认为这一趋势很可能会持续下去。

关于英伟达的组织会如何变化

我们将会超级忙碌。在十年内,我们希望——也将会拥有——大约 7.5 万名员工。

(公司的规模)只保持在尽可能小的程度,但也达到必要的规模。这 7.5 万名员工将与 750 万个 AI 代理(Agents)协同工作。

这些代理将全天候工作。希望我们的员工不需要(为了赶进度)而试图跟上这些代理的节奏,我也确信这种(人类过度劳累的)情况不会发生。这就是未来。