两大AI顶会,前后引爆全网。NeurIPS 2026一条「制裁机构」新规,为投稿筑起高墙。ICML 2026审稿口碑崩盘,吐槽声一大片。

一条藏在NeurIPS 2026官方手册里的新规,让整个中国AI学术圈炸了锅。

你的论文,我们不收了!

与此同时,ICML 2026打分刚一公布,全网骂声一片,审稿质量烂到审稿人自己都看不下去。

顶会年年一场戏,今年这料格外足。

翻开这份长达数十页的文件,在「Sanctioned Institutions」一节,赫然写着这样一段话:

NeurIPS基金会作为美国法律管辖范围内的实体,必须遵守美国制裁与贸易限制法规。根据相关规定,向受制裁机构的代表提供「服务」(包括同行评审、编辑和出版)属于被禁止的行为。因此,我们将不接收也不刊发这些机构的投稿。

消息迅速在社交媒体和学术社群扩散。

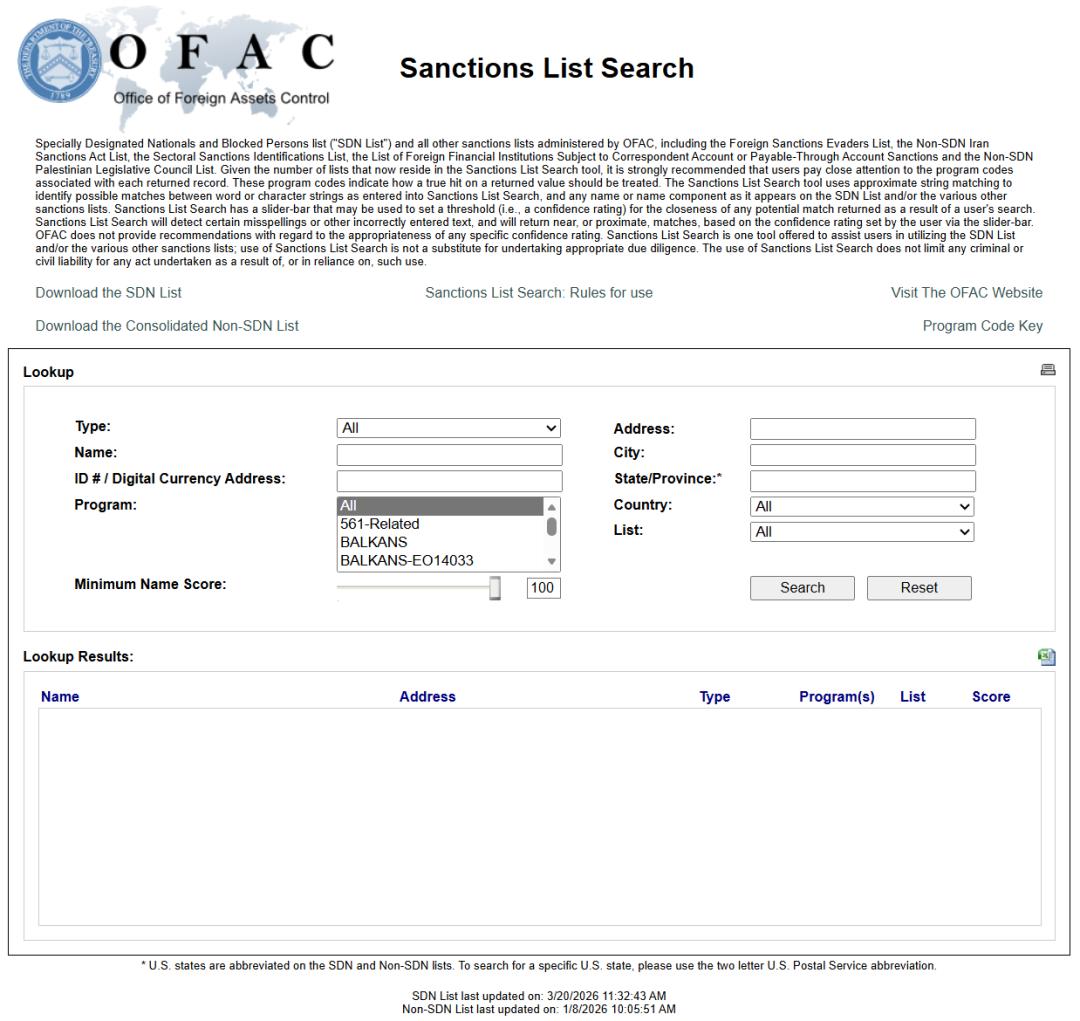

有人震惊,有人愤怒,也有人开始默默打开那个OFAC网站,输入自己所在机构的名字。

873家实体,全在这张清单上

这条新规的严厉程度,需要放在坐标系里才能看清。

手册原文把同行评审、编辑、出版统统归入受制裁的「服务」范畴。制裁清单上的机构,连把论文递进门的资格都没有了。

关键在于NeurIPS援引的法律工具。它指向的不是商务部实体清单(Entity List),而是OFAC制裁名单。

后者属于美国财政部主导的金融制裁框架,在合规领域,OFAC制裁被称为「核选项」,没有哪个在美注册的组织敢掉以轻心。

从法律角度看,NeurIPS Foundation注册在美国,做出这一决定有其合规逻辑。

但从学术角度看,这道门一关,后果深远。

此前即便是2019年IEEE「审稿门」事件,争议焦点也仅仅是审稿权,而且IEEE在不到一周内就撤回了禁令。

这一次,性质已经从「不让你当裁判」变成了「不让你上场」。

目前一切都还在消化中,但焦虑已经弥漫开了。

ICML、ICLR会跟进吗?

NeurIPS、ICML、ICLR并称「机器学习三大顶会」,共同构成了全球AI基础研究最重要的发表阵地。

如果NeurIPS开了先例,其他两家是否会援引相同的法律依据跟进?

毕竟,ICML和ICLR背后的运营实体,同样都是在美国注册的非营利组织。

这意味着,三大顶会面临的法律约束完全一致,NeurIPS只是率先亮了牌。

不仅如此,它们已经联合设立了Journal-to-Conference Track,共享审稿规范和双重投稿政策。

一旦NeurIPS将制裁合规写进投稿规则并形成先例,另外两家保持沉默的空间会越来越小。

换句话说,NeurIPS的这一步,很可能不是终点,而是起点。

学术无国界,但会议有国籍

把时间线拉长来看,这件事不是孤立的。

2019年IEEE审稿门,2020年后中国学者赴美签证收紧,2024年NeurIPS温哥华会议上大量中国学者因签证缺席……每一道裂缝都不大,但拼在一起,轮廓就清晰了。

NeurIPS 2026的这条新规,把地缘政治工具第一次正式嵌入了AI顶会的投稿规则。

它不再是一封可以撤回的邮件,不再是一次可以纠偏的误判,而是白纸黑字写进了官方手册,和论文格式要求、双盲审稿制度、利益冲突声明并列在一起。

NeurIPS 2026在澳大利亚悉尼办会,但它的法律身份属于美国。

当会议的国籍开始决定谁能投稿,某种东西就已经变了。

NeurIPS官网至今挂着它的使命宣言:

NeurIPS基金会是一家非营利机构,其宗旨是促进人工智能与机器学习领域的研究交流,以最高的伦理标准,服务于一个多元而包容的社区。

多元、包容、促进交流。

873家机构被挡在门外的此刻,这段话读起来,别有一番滋味。

ICML打分出炉,全网骂惨了

NeurIPS这边门还没关上,ICML那边又炸了。

评审意见一放出,OpenReview瞬间宕机。这一届ICML,收到了约2.4万篇投稿。

就在上一周,ICML组委会在公开审稿结果之前,桌拒了497篇论文,占总投稿量2%。

其中一个操作颇具争议:

官方在论文PDF中暗埋了隐藏提示,专门用来检测审稿人是否直接把论文丢给大模型处理。不少审稿人因此「中招」,连带所审论文一起出局。

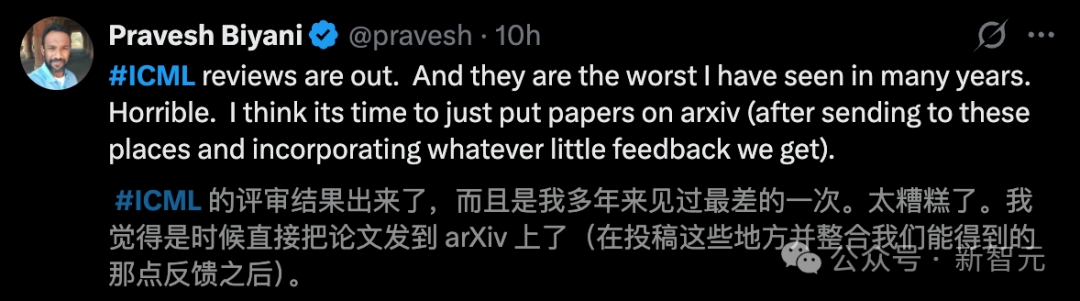

更惨不忍睹的是,来自全网的一大波吐槽。

Meta研究员Ravid Shwartz Ziv直言,「审稿质量实在太烂了,说真的,我现在倒宁愿它们是AI生成的」。

另一人表示,太离谱,完全像是LLM生成的。

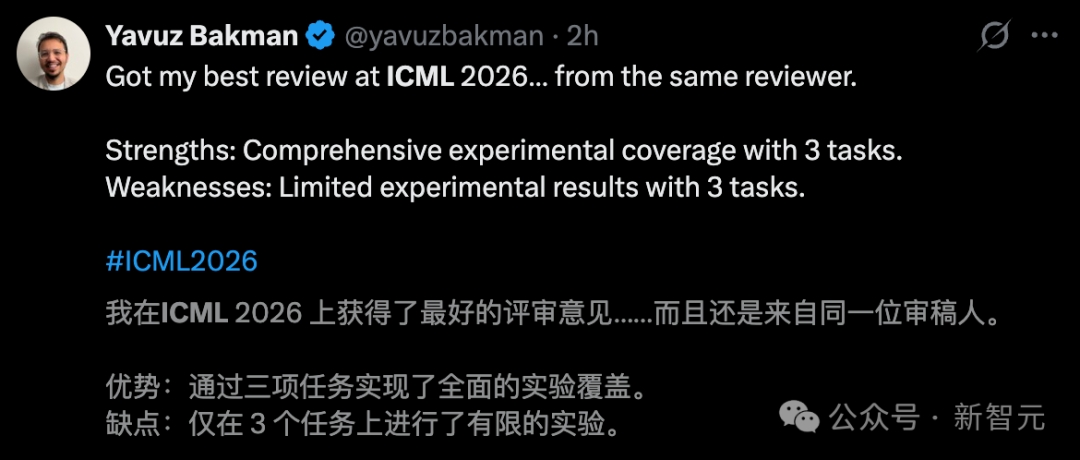

下面这个情况,直接让人瞳孔地震。

一位审稿人把别人的审稿意见贴错了;有人要求补充附录中已有的实验;还有人凭空捏造显然不成立的缺陷。

网友吐槽道,「只能说,ICML审稿质量真的一般……」

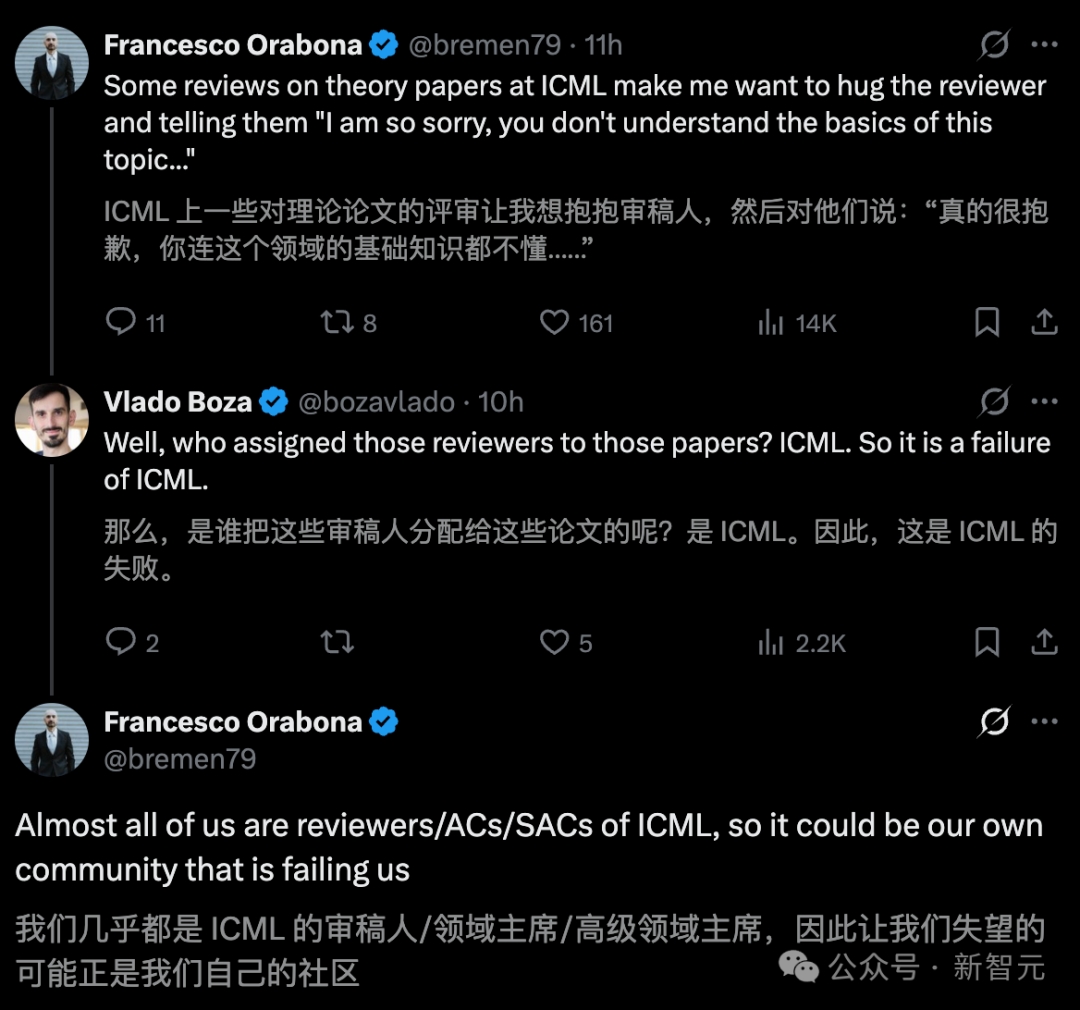

KAUST助理教授发帖,表达了对审稿人水平极度糟糕的无奈。

但有人认为,如果审稿人不懂,那不是审稿人的错,而是分配机制的错。是ICML把论文分给了不合适的人,所以这是大会组织和分配系统的失败。

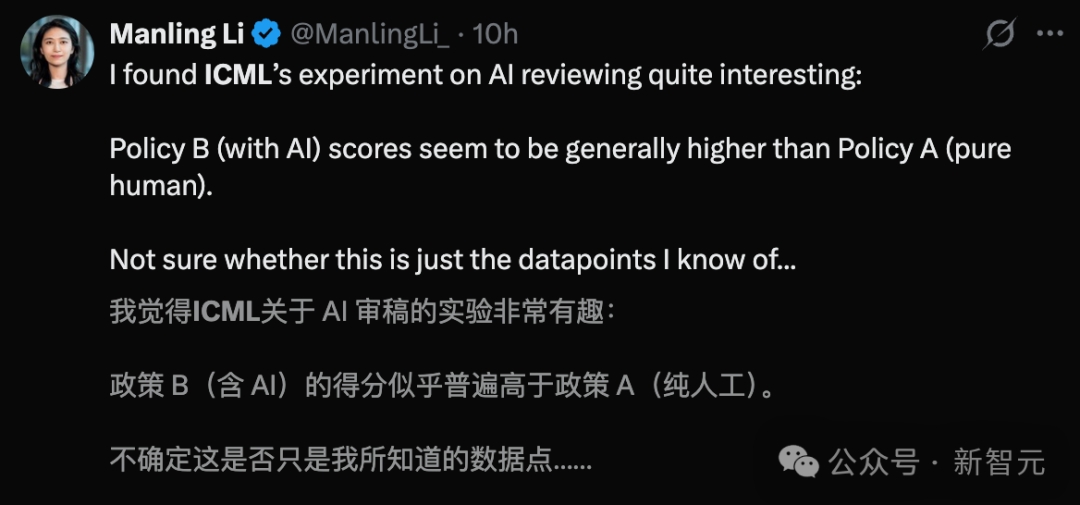

更有趣的是,用AI审稿的打分,普遍高于纯人工审稿。

一边是制裁清单关上的大门,一边是同行评审烂掉的地板。

2026年的AI学术圈,上面进不去,下面也塌了。

参考资料:

https://x.com/ziv_ravid/status/2034068882562932785?s=20

https://x.com/_vztu/status/2034030592220926126?s=20

https://neurips.cc/Conferences/2026/MainTrackHandbook

https://sanctionssearch.ofac.treas.gov/