【导读】代码没有消失,但它不再是少数人特权。在「创造平权」的AI时代,真正稀缺的不再是编程能力,而是你是否有一个值得让机器为你燃烧几百美元算力的好想法。

真正让人不安的,不是AI提高生产力,而是AI开始主导「生产关系」。

Anthropic最危险的进步,不是AI会写代码,而AI开始独自把项目做完。

一句话需求、6个小时、200美元。

没有产品经理、没有程序员、没有设计师,甚至全程人类补一行代码。

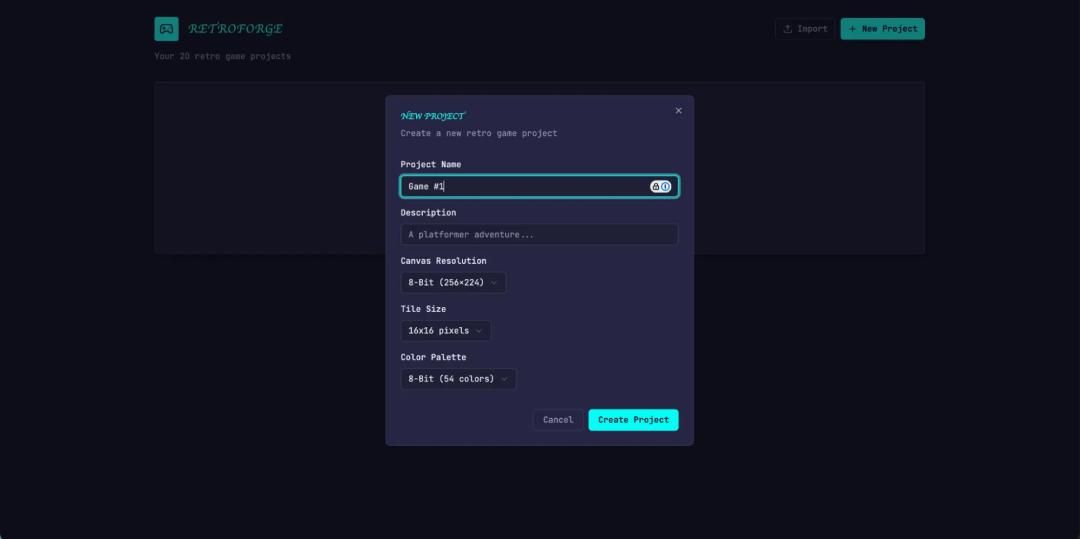

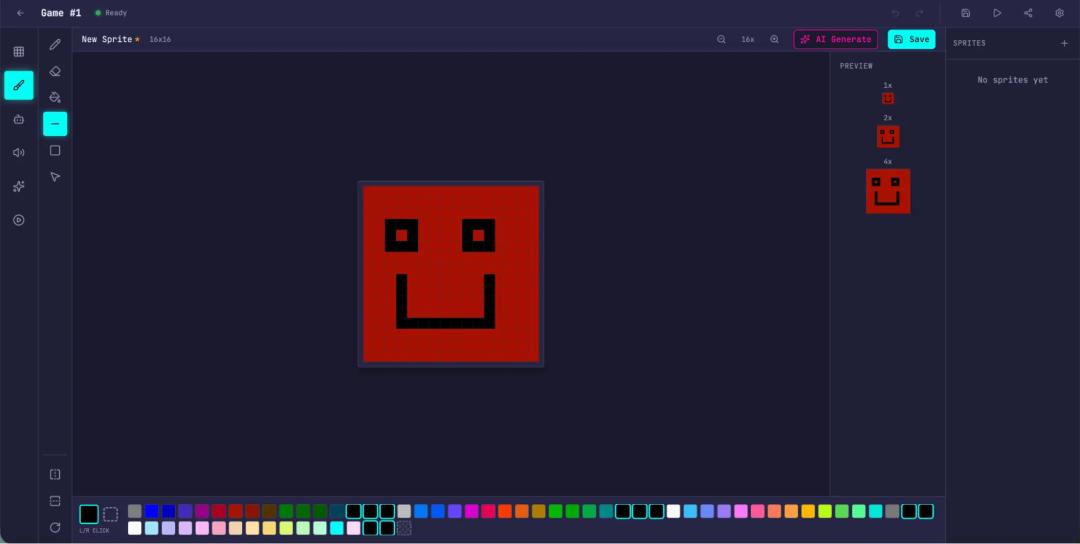

Anthropic把Claude丢进一个任务里:做一套完整的复古游戏编辑器。

结果,Claude没有只交出一个像样的页面。

它自己拆需求,自己写代码,自己测试,自己返工,最后交出一个真的能跑起来的成品。

在Anthropic这次实验里,AI已经不只是生成代码,而是在逼近交付。

过去我们聊AI编程,聊的是它写得快不快。现在问题变成了:它能不能连续工作几个小时,在第5轮、第10轮修改里不跑偏,最后把东西交出来。

Anthropic这次给出的答案是:能。

但前提不是把AI当一个人使,而是把它组织成一个团队。

原文链接:https://www.anthropic.com/engineering/harness-design-long-running-apps

AI不是不聪明,而是不稳定

过去的AI很像一个天赋很高的实习生。

第一版,冲得很猛。

第一个页面,出得很快。

第一轮代码,看上去也像那么回事。

但任务一拉长,它就开始乱:

逻辑散了,上下文丢了。

该修的没修,该测的没测。

最麻烦的是,它常常会提前进入一种「看起来做完了」的状态。

Anthropic点得很准:问题不一定出在智力上,而是出在长程执行上。

Anthropic做了一个对照实验,结果很残酷。

单智能体模式下,AI用20分钟、9美元,也做出了一个「像游戏编辑器」的东西。

问题是,一上手就露馅——

交互没打通;实体没正常响应;核心玩法直接失灵。

这说明一件事:

以前大家总以为AI不行,是因为还不够聪明。

现在看,很多时候真正拖AI后腿的,不是智商,而是稳定性。

很多人一说AI记不住,第一反应都是:那就给它更大的上下文窗口。

听起来很合, 但Anthropic这次泼了一盆冷水。

窗口更大,不一定更强。很多时候,只是把混乱一起放大了。

东西越堆越多,但真正重要的主线,反而越容易被淹掉。这就是所谓的「上下文腐烂」。

更麻烦的是,模型还容易高估自己。

Anthropic发现,程序明明一跑就崩,模型却觉得自己做得不错。

于是单智能体会掉进两个坑:一边越写越乱;一边越乱越觉得自己没问题。

这就是为什么,单纯靠更大模型、更长窗口、更高token上限,AI并不能独立完成项目交付。

为了取得突破,Anthropic Labs成员Prithvi Rajasekaran探索了一些新颖的AI工程方法。

这些方法在两个截然不同的领域中均适用:一个由主观品味定义,另一个则以可验证的正确性和可用性为准。

受对抗生成网络(GANs)的启发,他设计了一种包含生成器和评估器的多智能体结构。

没造「超人」,但Anthropic造了神团队

这次最关键的变化,不是参数。不是窗口。也不是什么神秘提示词。

真正的变化是,Anthropic不再逼一个AI单枪匹马干完整个项目。

它开始让AI分工。

这套结构很像一个小型产品团队。

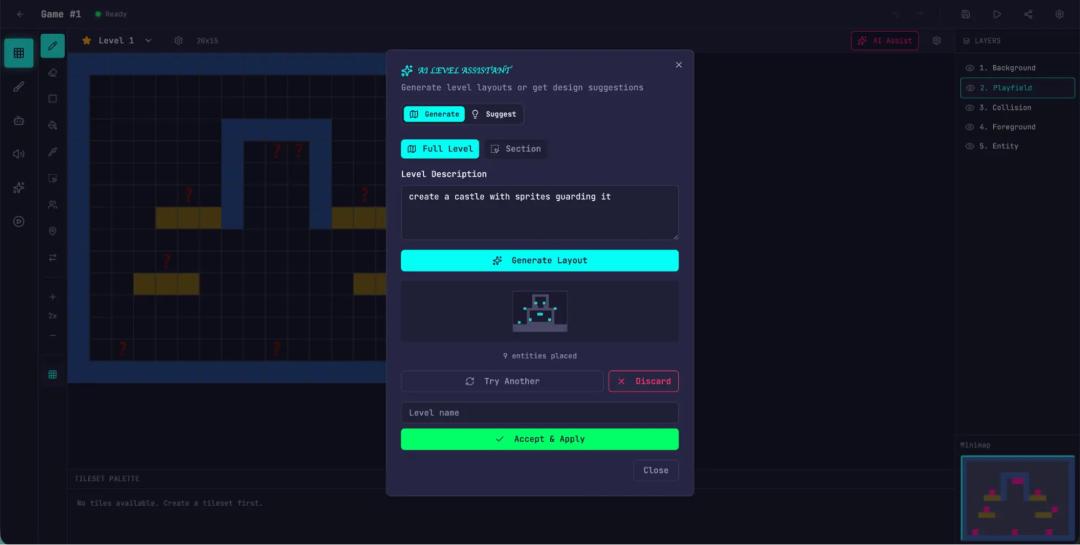

Planner,负责想清楚。它先把一句模糊需求,扩成规格,定义产品到底要做什么。

Generator,负责动手。它下场写代码,搭前后端,接交互,做集成,一轮轮推进。

Evaluator,负责挑错。它不负责体面。它只负责验收。点页面、试按钮、查数据库、测接口,把问题一个个揪出来,再打回去重做。

最后一步特别关键,因为一边写,一边给自己打分,最后AI很容易说服自己:差不多就行。

但把两者拆开,很多本来会被糊弄过去的问题,就过不去了。

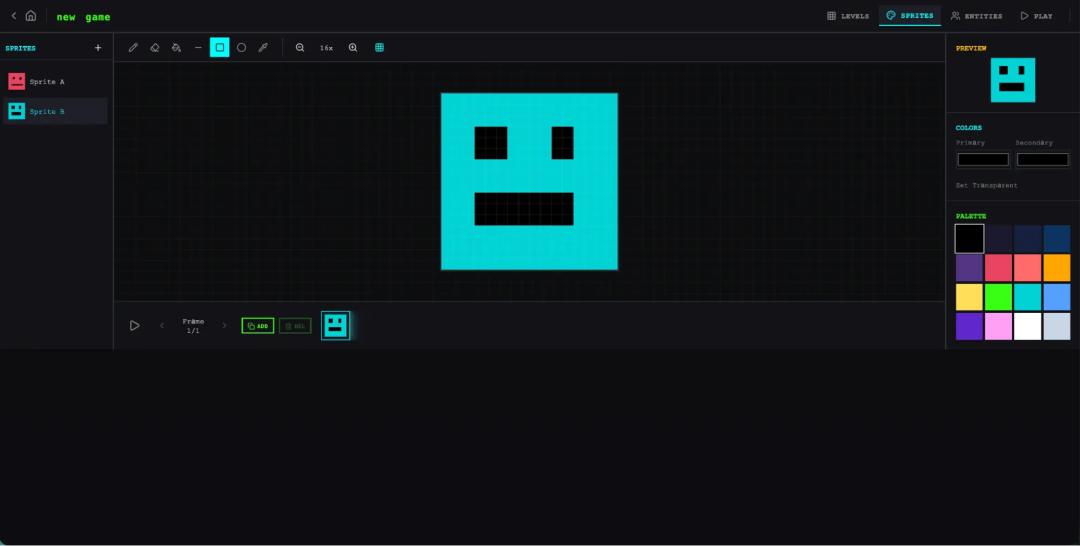

拿那套复古游戏编辑器来说,Planner最初拿到的只有一句话需求。

但最后扩出来的,是一份包含16个功能、10个冲刺的规格书。

精灵动画、音效系统、行为模板、AI精灵生成、关卡设计助手、导出分享,全部被拆进流程里。

这已经不是「AI写代码」了,AI开始学会像团队一样做产品。

真正拉高质量的,是高压验收

今天很多AI产品都有一种共同气质——看着完整,配色安全,布局规整。

挑不出大错,但也没什么灵魂。这种东西叫AI Slop「AI泔水」。说白了,就是「像成品的样子货」。

显然,Anthropic不满足于这种结果。

所以它不只让Evaluator查bug,还让它盯四件事:

设计质量、原创性、工艺感、功能性。

而且,它还故意把「原创性」和「设计质量」的权重拉高。

译成人话就是:别总交最安全的答案,做点真的像作品的东西出来。

这背后是一个很重要的信号:

很多人以为AI的创造力来自灵光一现,但很多时候,AI的创造力,恰恰是被高标准一点点逼出来的。

所以,下一阶段真正稀缺的能力,可能不是「谁更会生成」,而是「谁更会评价」。

你有多会挑错,决定AI最终能走多远。

最可怕的是,AI真能改到第10轮

这次实验最让人不安的,是Claude开始形成很强的闭环感。

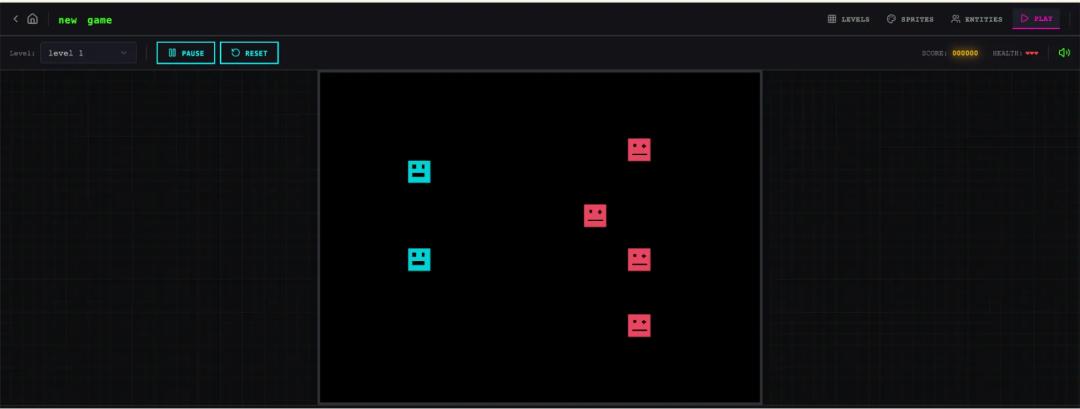

还是看RetroForge,也就是那套复古游戏编辑器。

同样一句话需求。

单智能体版,20分钟,9美元。很快,也很便宜,但更像一个空壳。

三智能体版本,6小时,200美元。贵得多,慢得多,但最后结果完全不是一个量级。

它真的把27条验收标准,一条一条啃过去了。

这里面暴露出来的,是实打实的软件工程问题。比如:

函数写了,但事件没触发。

接口有了,但路由顺序错了,参数被错误解析。

这说明它做的,已经不只是拼页面,开始进入真正的工程地带。

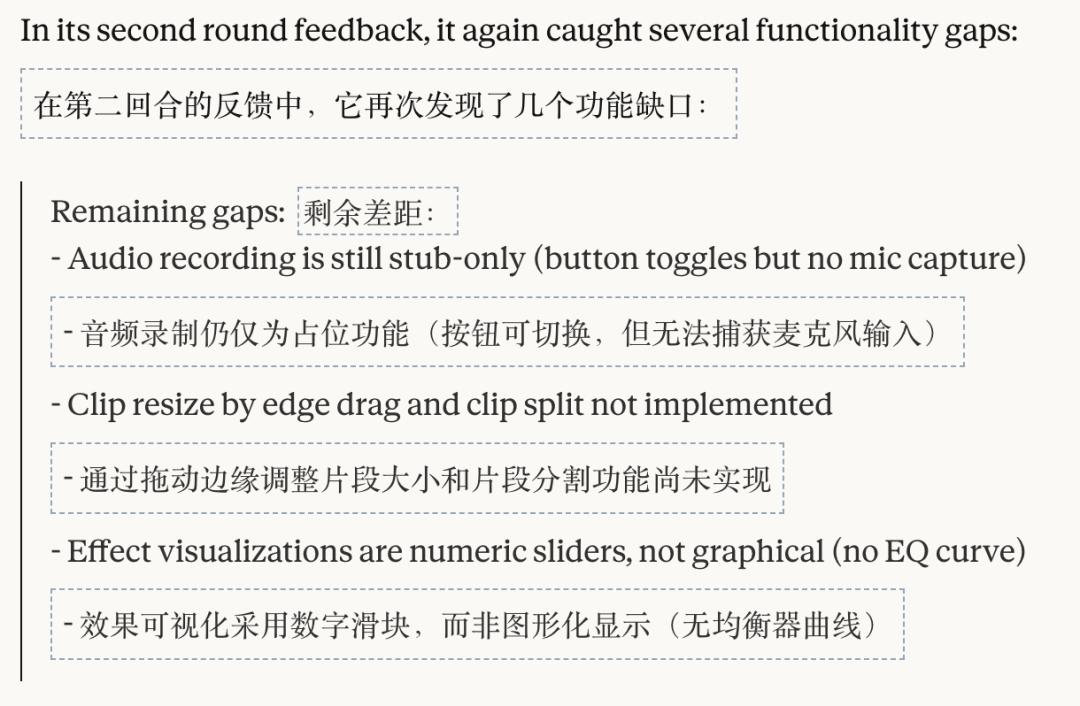

另一个例子更夸张。

Claude用了不到4小时、约124.7美元,做出一个能在浏览器里跑的DAW,也就是数字音频工作站。

它有排列视图、有混音器、有传输控制、有实时波形预览。

还内置了一个AI智能体,可以直接理解自然语言的音乐指令。

你告诉它节奏、调性、旋律、鼓轨、混响,它能继续往下做。

更关键的是,Evaluator没有放过它:

恰恰是这些被揪出来的问题,证明了这套系统真的形成了闭环:

不止要做完,还要被打回去改。改到能过验收,才算结束。

这才是软件开发里最难、也最有价值的部分。

第一版从来不难,难的是第8版、第9版、第10版。

真正的分水岭,AI第一次反复改到交付

Anthropic这次最值得行业警惕的,不是让Claude变成了一个更强的程序员。

而是让它第一次表现得像一个真正的产品组织,分工明确,各司其职。

这就是为什么,这次突破看起来不像「生产力升级」,更像一次「生产关系升级」。

过去,AI最强的能力是「生成一个答案」。

现在,它开始逼近另一种更难的能力:

围着一个目标,持续工作,持续修正,直到交付。

这才是真正的临界点。

代码没有消失,它只是在失去作为少数人特权的地位。

在这个「创造平权」的时代,你是否真的有一个值得让机器为你燃烧算力的好主意?

这才是最值得深思的问题。

参考资料:

https://www.anthropic.com/engineering/harness-design-long-running-apps

https://x.com/AnthropicAI/status/2036481033621623056