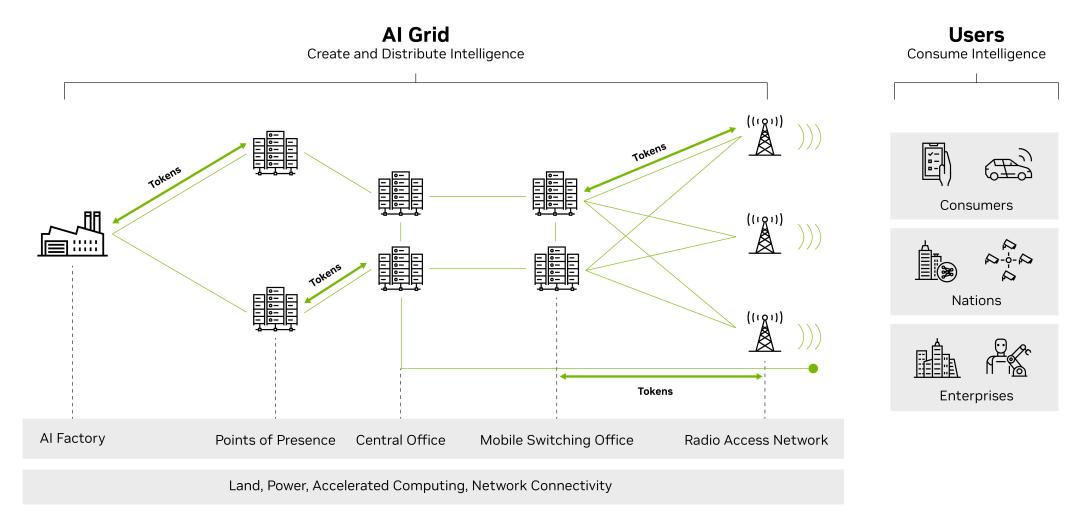

此前,在一年一度举办的 GTC 大会上,英伟达提出了被命名为“AI Grid”的宏大愿景,试图将全球电信网络转型为人工智能(AI)的基础设施。

所谓“AI Grid”,是一个由相互连接的 AI 基础设施节点组成的网络,覆盖 AI 工厂、区域接入点、中心机房、移动交换中心以及基站站点。这些节点配备全栈式 AI 基础设施,并通过安全、高带宽、低延迟的网络连接在一起,能够实现数据、模型、智能体和工作负载的无缝流动,从而使整个网格像一个统一的分布式系统那样运行。

图源:英伟达官网

当前,正在探索“AI Grid” 领域的电信运营商包括 T-Mobile US、Comcast 和 SoftBank 等,英伟达一直强调,电信公司现有的资产(铁塔、光纤和频谱)使它们天然适合承载分布式推理基础设施。然而,核心的问题在于——如果这一愿景真的代表了未来大势,那电信运营商现在究竟应不应该把大量资金投入到分布式 AI 基础设施中?

针对这一问题,ABI Research 近日发布了一份分析报告,帮电信公司算了一笔账。该报告涵盖了“AI Grid” 落地过程中的边缘 GPU 部署、网络延迟限制、总体拥有成本,其真正试图厘清的核心矛盾在于:英伟达这一愿景在今天是否站得住脚,还是说,这是一场押注尚未到来的未来的昂贵赌博?

降低延迟是核心理由吗?

在网络的近边缘或远边缘部署 GPU,最有力的理由就是延迟——那些需要近乎“实时”执行和控制的应用程序对延迟有严格要求,推理服务器物理上越接近终端用户,响应速度就应该越快。

然而,ABI 的分析表明,这一论点听起来合理,实则站不住脚,至少对于当今主流的 AI 工作负载而言是如此。对于生成式 AI 来说,最重要的指标是首字延迟 (TTFT,一个用于衡量网页加载性能的关键指标,反映了从用户发起请求到浏览器接收到第一个字节的时间长度) ,而网络延迟根本不是其主要影响因素。标准的网络往返时间确实可能达到 100 毫秒,但造成延迟的更大元凶——包括 DNS 解析、隧道建立,以及计算密集型的预填充和解码阶段——无论推理服务器物理上部署在哪里,都不会改变。以一个大约 1000 个 token 的中等规模提示词为例,仅预填充阶段就需要约 160 毫秒,而解码阶段可能延长至数秒。

这在实践中意味着,对于常规的聊天机器人交互来说,将推理服务器移到离用户更近的地方并不会显著改善体验。token 生成过程中的计算延迟,完全压过了在网络传输环节节省下来的时间。Latitude 公司首席执行官 Guilherme Soubihe 在接受 RCR Wireless 采访时指出了这一点:“绝大多数数据中心级 GPU 容量已经被超大规模云厂商和前沿模型开发商用于大语言模型的训练和微调,而这些工作负载并不会从边缘位置中获得有意义的收益,因为网络延迟基本无关紧要。”

不过,情况其实要更复杂一些。英伟达 GTC 大会上的演示显示,采用边缘部署后,聊天机器人的往返延迟从 2000 毫秒下降到了 400 毫秒。Personal AI 首席执行官 Suman Kanuganti 则对当前延迟讨论中通常围绕单个请求展开的框架提出了质疑。“AI Grid 并非针对单次调用进行优化,而是为并发而优化的。”他引用了一些基准测试结果:在 P99 突发流量下,一个四节点的 AI Grid 能将语音延迟保持在 500 毫秒以内,同时吞吐量比基线提升 80%,而集中式部署在相同负载下则会出现性能下降。换言之,边缘的优势不在于将单个请求缩短几毫秒,而在于为数百万个并发会话同时保持确定性的服务质量。因此,对于单个消费者的查询而言,延迟方面的优势可能并不明显,但对于处理海量并发会话的运营商来说,其考量结果就开始有所不同了。

物理 AI 才是真正让延迟成为架构刚需的领域。自动驾驶汽车、配送无人机和机器人、视频监控、智能眼镜以及 AR/VR,都大幅压缩了可接受的延迟窗口——云端推理根本无法满足这些要求。

ABI 用一个直白的例子阐明了这一点:在 100 毫秒的延迟下,一辆时速 100 公里的自动驾驶汽车相当于有 2.8 米的距离处于“失明”状态。当面对需要近乎实时执行的安全关键系统时,通过远端的云数据中心进行路由推理是行不通的。同样的原理适用于一系列新兴应用,包括最后一公里配送机器人和实时视频分析。

当然,问题在于时机。这些物理 AI 应用中的大部分距离形成任何意义上的规模化都还有数年时间。爱立信美洲思想领导力负责人 Peter Linder 的核心观点是,部署的理由需要来自网络效率提升和未来收入潜力两者的结合,而不仅仅是物理 AI 本身的需求;Kanuganti 则持更激进的观点,他认为语音 AI、视频智能和企业 AI 服务是现在已经存在的用例。如果自动驾驶汽车、无人机、人形机器人真的有那么接近大规模应用,那么基础建设现在就必须开始。

建设成本划算吗?

即使延迟论点和应用场景最终能够达成一致,建设分布式 AI 网格的财务挑战依然令人望而生畏。ABI 的结论是,在未来两到三年内,旨在降低标准延迟的大规模全国性边缘服务器部署在财务上并不可行。基站部署尤其面临严峻的单位经济效益问题——每个基站服务的用户群有限,地理覆盖范围狭窄,这使得除了密集、高价值区域外,每个站点的回报都颇具挑战。

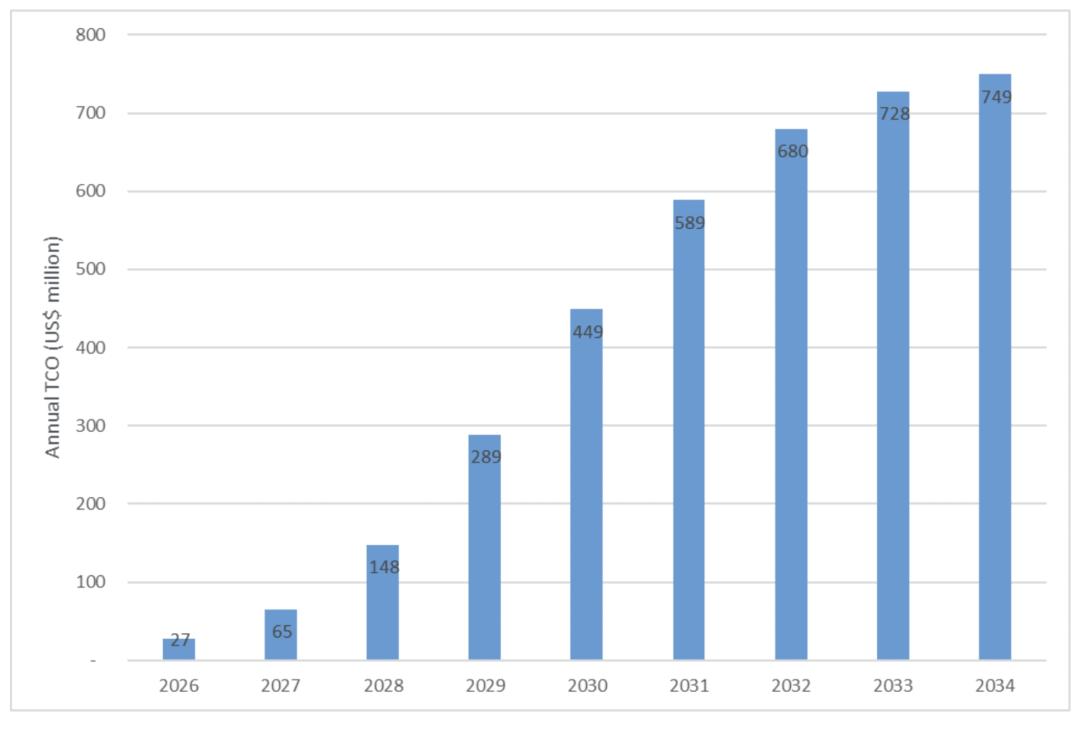

为了用真实数据支撑讨论,ABI 以美国的 T-Mobile 为例进行了模拟计算。T-Mobile US 曾在 GTC 大会上表示,“ kinetic tokens”将为全球电信运营商带来巨大机遇,而为了利用其基础设施资产,运营商需要 AI-RAN 系统以及在网络中部署 GPU。假设 T-Mobile US 在美国运营约 13,000 个屋顶基站站点,并开始为其配备 AI-RAN 服务器(此场景中采用英伟达 ARC-1 服务器,单价 6 万美元,每台为三个基站提供算力),且到 2035 年完成部署,实现屋顶站点 GPU 全覆盖——那么包括部署、冷却及其他辅助成本在内,累计总成本将达到 37 亿美元。如下所示的图表展示了该示例部署场景下的年度总体拥有成本:

图:T-Mobile US 在其所有屋顶站点逐步部署 GPU 服务器的年度总体拥有成本

假设收入能相应增长,将投资分摊到九年,部署“AI Grid” 的投入就变得更为可控。此外,37 亿美元的估算值在英伟达的体量下几乎微不足道,但电信运营商及其投资者需要强有力的商业案例来支撑这一支出——尤其是当这笔投入的规模相当于部署一套新一代无线网络时。

基础设施的现实情况让财务挑战更加严峻,Kanuganti 表示,“通信铁塔的设计初衷并不是为了容纳和冷却高密度计算设备”,这也解释了为什么先行者会从具备冗余电源、冷却和物理安全措施的有线近边缘设施入手。Linder 也强调了这一点,他指出:“无线电站点通常环境恶劣,因此我们使用专门设计的、基于 ASIC 的计算来优化功耗、性能和成本,并尽可能取消风扇。”

这两种观点都得出了相同的结论:远边缘的建设取决于硬件能效的提升、专为边缘 AI 设计的硬件形态,以及将无线处理与 AI 推理整合到共享计算平台上的 AI-RAN 架构的出现。

鉴于所有这些限制因素,ABI 预测,AI 推理的初期部署将集中在核心网节点(通常一个国家内少于 10 个),之后随着低延迟需求增长和经济性改善,再逐步向外扩展到基站站点。许多应用场景,包括视频监控、自动驾驶、最后一公里配送机器人、智能眼镜以及 AR/VR 应用,都使得边缘推理不是可选项,而是架构上的必然要求。早期的“AI Grid” 部署主要作用是为电信网络面向未来做好铺垫,为 6G 最终所需的分布式计算打下基础。

英伟达画的“大饼”好吃么?

按照英伟达的设想,“AI Grid” 旨在跨计算位置无缝处理 AI 工作负载,从而优化成本、性能和用户体验。简而言之,它们根据延迟、成本和策略目标来决定模型应该在何处运行以及 tokens 应该如何流动。

赋能实时 AI 应用场景:对话助手、AR/VR、在线游戏和工业机器人等实时 AI 应用,为了实现沉浸式客户体验,需要严格控制延迟。“AI Grid” 通过将计算工作负载部署在尽可能靠近终端用户和设备的物理位置,实现了此类对延迟高度敏感的应用的大规模运行。

大规模优化 Token 成本:多模态生成和高级推理模型生成的 Token 数量可达简单文本型大型语言模型 (LLM) 的 100 倍,这显著增加了网络数据量,并推高了云出口成本。“AI Grid” 通过将这些 Token 密集型工作负载部署在具有最具成本效益的计算和网络连接的分布式 AI 节点上来缓解这一问题,从而在不牺牲服务质量的前提下,减少数据出口和带宽消耗。

面向弹性和投资回报的地理弹性架构:“AI Grid” 可以运行从 AI 应用到网络功能的各种工作负载,同时优化每个节点的利用率,从而提高基础设施投资回报率并降低运营开销,优于单一用途系统。它们将多个分布式 AI 节点视为一个虚拟系统,从而能够更智能地扩展容量、应对突发的需求高峰并显著减少单点故障。

区域合规性和数据主权:企业可以定义数据和模型在“AI Grid” 上的存储和执行位置,使部署符合区域规则,同时还能利用全球规模的协调能力。

基于以上受益,我们能看到英伟达正在积极构建一种叙事,即电信公司将成为新型 AI 网格中的关键节点。但值得清醒认识到的是,这一框架对英伟达的好处,远超其他任何一方。设备销售、软件授权、生态绑定——无论“AI Grid” 最终以何种形态落地,英伟达都将是最大的赢家;而对于电信运营商而言,这条路却远没有那样明朗。

率先行动的玩家或许未必能在短期内看到真金白银的回报,它们更多是在这个被英伟达等公司称为“AI超级周期”的浪潮中,抢先占据一个战略卡位。然而,这种卡位是否真的值得在收入来源尚未得到任何验证之前,就投入数十亿美元的资本支出,仍然是一个悬而未决的问题~

参考资料:

ABI on AI infra | AI grid may be the next telecoms arms race (Analyst Angle)——RCRWireless

Nvidia’s AI grid and the telco dilemma——RCRWireless

What Is an AI Grid?——英伟达官网

英伟达的电信雄心:重塑2万亿美元网络产业——C114通信网

黄仁勋的物理AI野望:将5G网络转变为分布式AI计算机!——物联网智库