研究显示:AI 智能体不会让软件工程师丢饭碗,反而拓展其工作边界

2 小时前

/ 阅读约2分钟

来源:IT之家

查尔姆斯理工大学、沃尔沃集团研究团队提出“半可信执行栈”模型,认为AI智能体不会让软件工程师失业,反而扩展其工作范围。AI漏洞集中在决策流程和社会制度适配环节。

IT之家 4 月 26 日消息,据科技媒体 The Decoder 今天报道,查尔姆斯理工大学、沃尔沃集团研究团队最近在一篇论文指出,AI 智能体并不会让软件工程师失业。反而还可以通过“半可信执行栈”扩展工作范围。

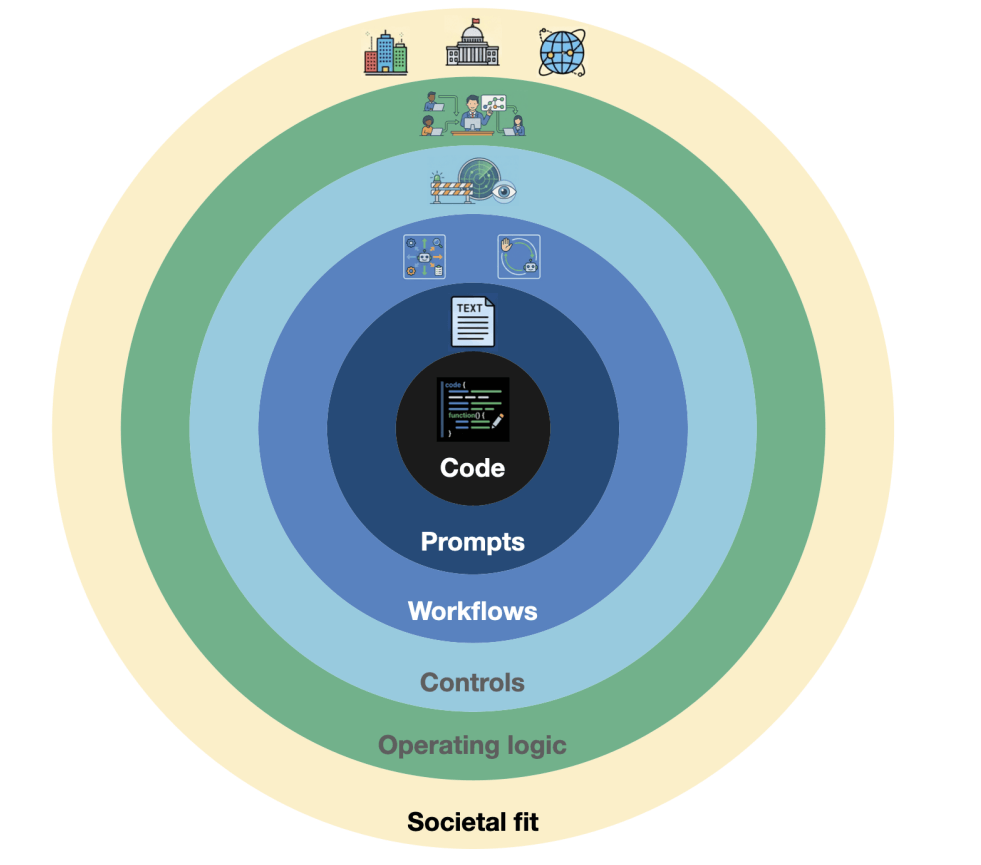

据报道,研究团队首先提出了一个由六环组成的“半可信执行栈”(semi-executable stack)模型,将传统代码向外延伸,触达欧盟 AI 法案等社会因素。

论文中的“半可信执行栈”由六个环组成:经典代码、提示词和自然语言规范、智能体工作流编排、控制系统、运营组织逻辑、社会与制度适配。

目前,软件工程师主要在经典代码(IT之家注:第一环)、提示词(第二环)工作;而智能体工作流(第三环)、安全围栏(第四环)和决策流程(第五环)正在成为高优先级工程对象;社会制度适配(第六环)则决定 AI 的实际执行。

研究者认为,目前 AI 智能体最大的漏洞集中在第五环和第六环,人们已经写了几十年代码,但 AI 决策、制度适配等宏观流程仍然缺失,大多数研究仍然集中在修复错误、测试 AI 等。

学者表示,AI 不需要拥有顶尖人类学者的水平,只需要够用就行。大量部署 AI 带来的价值高于部分顶级专家。

此外,研究人员并没有忽视 AI 的“幻觉”问题,他们认为这更凸显了测试、监控的必要。人类在未来仍存在价值。