进入2026年,全球半导体市场最先感受到的寒意来自存储领域。根据多家市场研究机构的报告,存储芯片价格的上涨已近乎“失控”。

根据Counterpoint Research与TrendForce的数据,继2025年第四季度价格暴涨50%之后,DRAM与NAND Flash芯片的价格预计在2026年第一季度将继续上扬40%至50% 。

这一极端的价格压力迅速从上游传导至终端。以消费市场为例,部分主流DDR5内存条的价格自2025年下半年以来涨幅已超过三倍。

对这个现象深度溯源,其实是AI基础设施,特别是大模型训练与推理对高带宽内存(HBM)和高性能存储的“虹吸效应”所致。

晶圆厂将产能优先分配给利润更高的AI相关存储产品,挤压了传统DRAM和NAND的供给,一场覆盖全行业的“算力税”已经拉开序幕。

但存储上扬只是序章,涨价轮盘上新近转来的,是CPU。

图:AI辅助生成

01 算力税第二波,CPU涨价

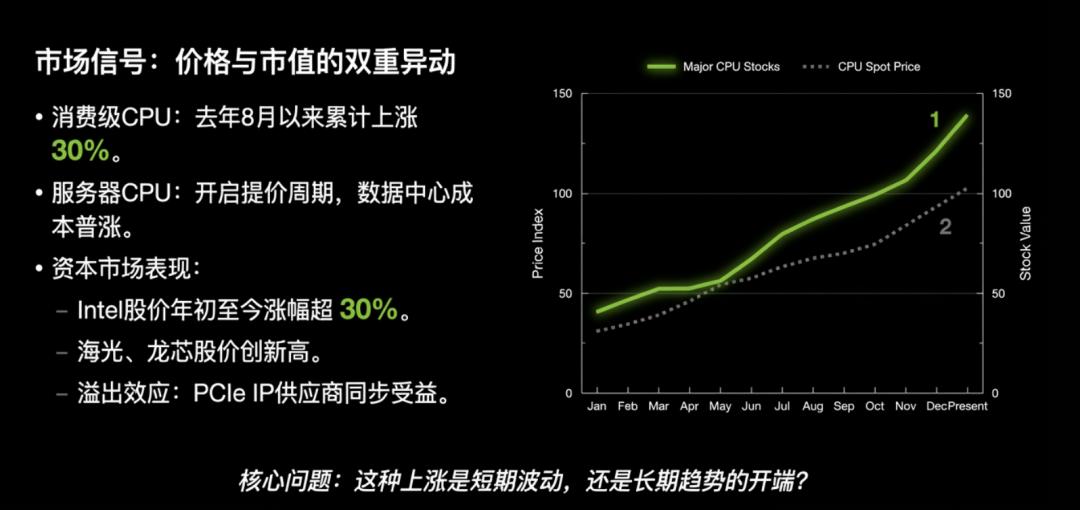

长期以来被视为成熟市场的CPU,在2025年下半年开始出现异动,并在2026年初彻底爆发。

资本市场的反应最为敏锐。截至2026年1月21日,芯片巨头英特尔(Intel)股价触及54.25美元,创下自2022年1月以来的新高,年初至今累计涨幅高达44.74% 。它的竞争对手AMD股价同样录得七连涨。

在中国市场,国产CPU的代表龙芯中科和海光信息股价分别在1月21日创下20%涨停和上涨超13%的惊人记录。

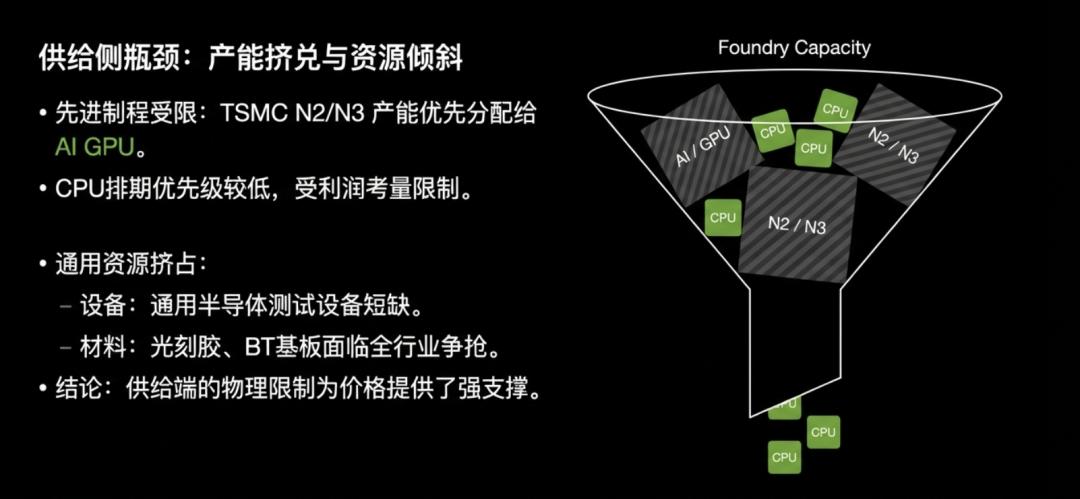

这一系列现象的背后,供给侧的产能瓶颈是显而易见的。

根据TrendForce 2026年1月的供应链监测报告,台积电(TSMC)的N2与N3到2027年的产能,也已被苹果、英伟达(NVIDIA)及博通(Broadcom)等巨头瓜分。

由于高端GPU与定制ASIC在单晶圆产出价值(Revenue per Wafer)上相较传统CPU享有溢价,代工厂在产能分配优先级上存在明显的盈利倾向。

这种资源向高毛利产品的倾斜,直接削减了消费级与企业级处理器的晶圆配额。与此同时,先进封装技术(如CoWoS-L/S)的瓶颈成为次生阻碍,IDC分析指出,由于CoWoS产能利用率在2025年第四季度便已突破100%,导致即便前端晶圆完成刻蚀,后端封装的积压也使CPU出货周期从正常的8-10周大幅延长至24周以上。

这种产能压力在英特尔的内部生态中体现得更为极致。随着其18A工艺进入量产高峰期,英特尔不仅需要保障自身酷睿(Core)与至强(Xeon)系列的供应,还需履行向微软、亚马逊等外部Foundry客户的代工承诺,导致英特尔核心节点的产能利用率已攀升至120%-130%的超负荷状态。

摩根大通最新的研报指出,这种“极限超载”已迫使英特尔将部分非核心组件转移至联电(UMC)等二线代工厂,但依然无法完全抵消先进制程供应的缺口。

然而,供给受限仅仅是故事的一半,真正重塑市场格局的,是来自需求侧的结构性剧变。

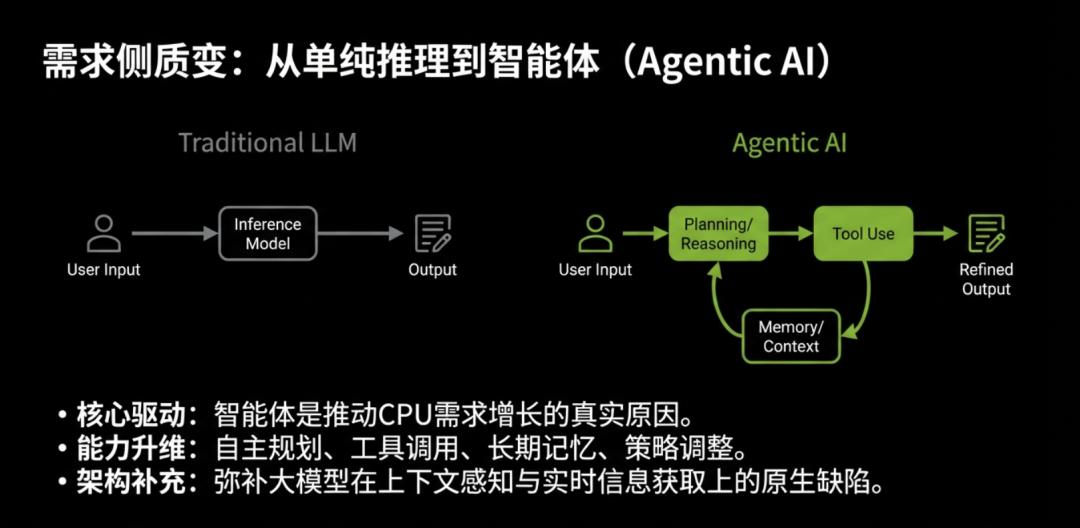

而推高需求侧的关键词,就是AI智能体。

02 需求侧,智能体创造“域外CPU”新需求

智能体能够自主规划任务、调用工具、记忆历史步骤,并在执行过程中实时调整策略来解决问题,人们通过这种方式来弥补单纯大模型在上下文感知、幻觉问题以及实时信息获取方面的不足。

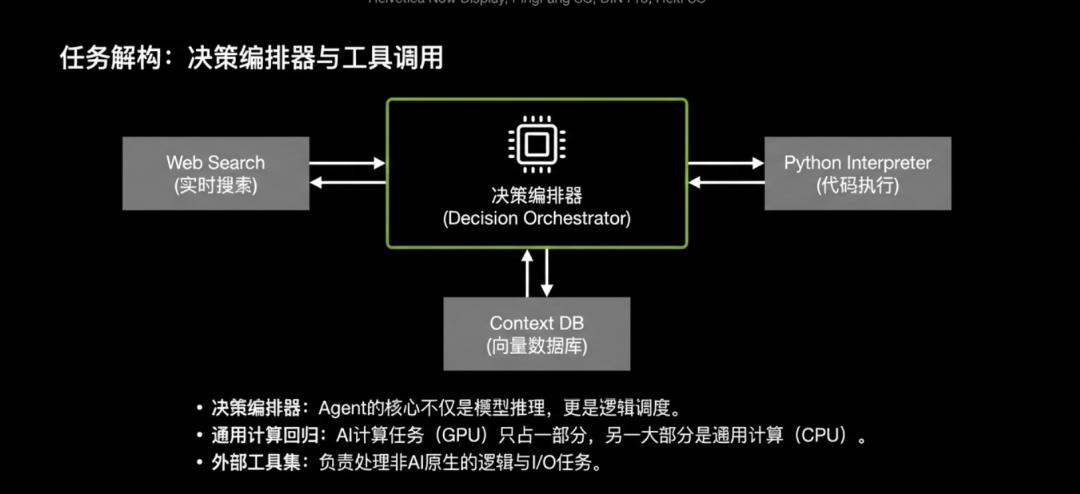

在它的架构中,在大模型的推理工作之外,还增加了决策编排器,还会使用网页搜索、抓取、Python解释器、上下文数据库等外部工具。

也就是说,整个智能体的工作负载中,AI计算任务只是一部分,还有很大部分是通用计算。

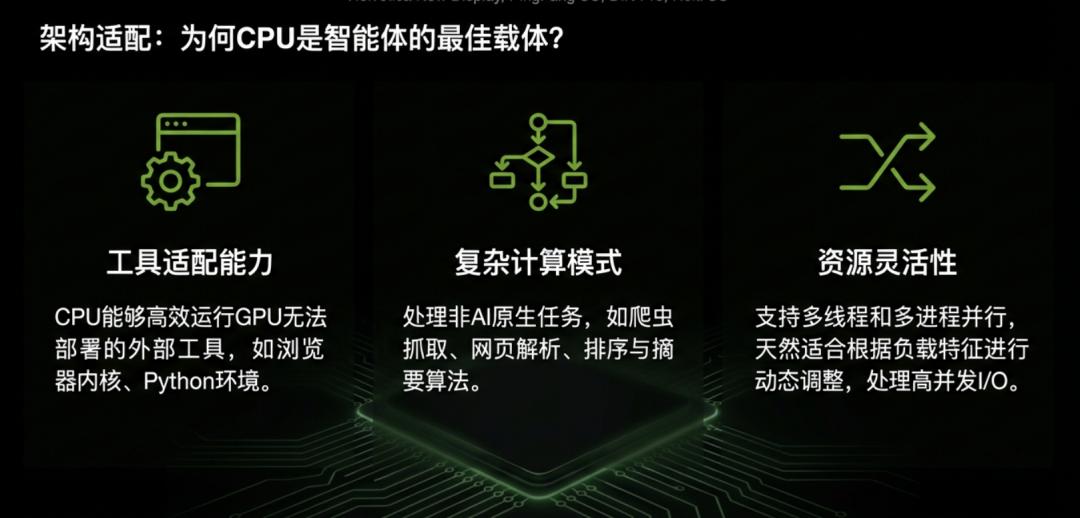

在智能体运行任务中,CPU的核心优势体现在对工具处理的适配能力、资源利用的灵活性以及对多种应用场景的兼容性。CPU 能够高效运行许多无法部署在GPU/TPU/NPU上的计算任务和外部程序工具,例如网页搜索、Python执行、精确向量/数据搜索等。

这类任务处理在智能体任务总量中总耗时(Latency)占比很大。要知道,CPU还支持多线程和多进程并行,天然可以根据负载特征进行动态调整。

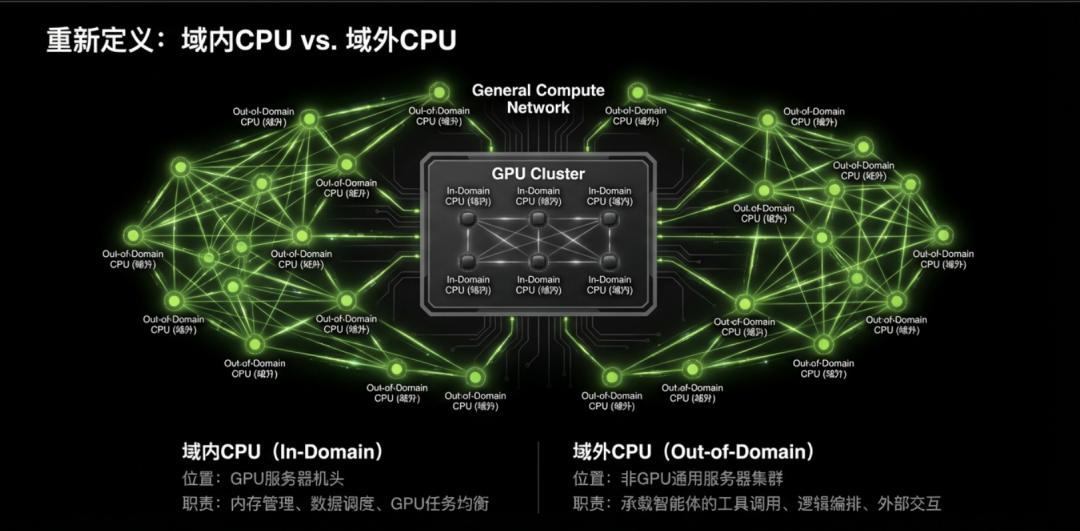

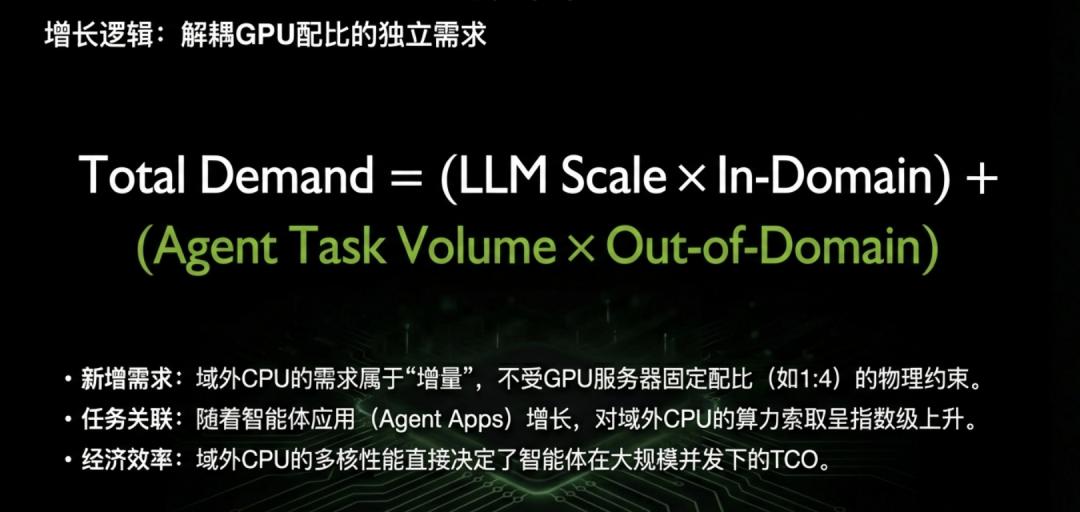

为了进一步深度分析,我们需要引入两个概念:域内CPU和域外CPU。

所谓域内CPU,指的是GPU服务器中所配的CPU,传统上来讲,装在GPU模组的服务器主机被称为机头,域内CPU指的就是机头里的CPU。它的主要任务是解决内存相关问题和数据调度,确保GPU任务均衡、合理、高效。

所谓域外CPU,指的是整个任务系统中,GPU服务器以外的集群中的其他CPU。

从系统视角来看,如果把整个智能体应用(Agentic AI)看成一个系统,根据上面的分析我们就知道,仅仅就CPU而言,起到性能决定性因素的,实际上是来自于域外CPU。

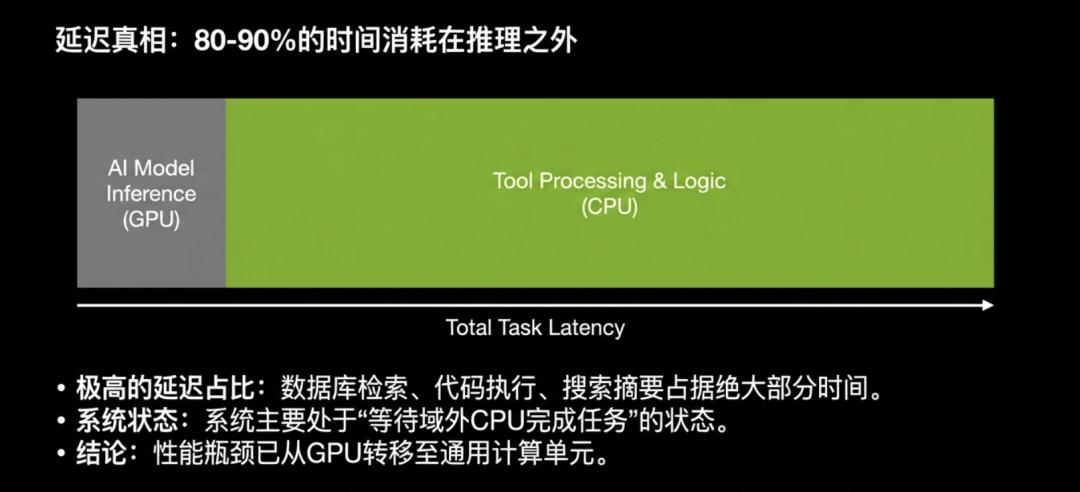

首先是极高的Latency占比。在典型的 Agent 工作负载中,运行在 CPU 上的任务处理(如数据库检索、代码执行和搜索摘要)占据了任务总Latency的80~90%。也就是说,系统运行时的大部分耗时都是域外CPU在处理任务,而不是消耗在AI芯片的推理上。

其次是复杂的计算模式。域外CPU需要处理大量非AI原生任务,比如说搜索、爬虫、抓网页,比如说运行Python 脚本,还有排序和摘要算法。

还有并发和能效比。在大规模批处理场景下,由于核心负载和同步开销,动态能耗会上升。域外CPU的多核性能和调度能力和智能体服务的经济效率强相关。

03 传统的CPU,新的增量市场

IDC预计,活跃Agent的数量将从2025年的约2860万,快速攀升至2030年的22.16亿,年复合增长率达到139%。年执行任务总数将从2025年的440亿次暴涨至2030年的415万亿次,年复合增长率高达524%。年度Token消耗量预计从2025年的0.0005 PetaTokens暴增至2030年的152,667 PetaTokens,年复合增长率高达3418%。

这些数据揭示了一个关键趋势:单个Agent承担的任务复杂度、决策链路长度以及对实时性的要求都在指数级增长。

这将直接转化为对“域外CPU”算力的海量需求。

Meta近期斥资数十亿美元收购通用AI Agent初创公司Manus,这是Meta成立以来第三大收购,仅次于WhatsApp和Scale AI。这一举动充分说明了产业界对Agent应用前景的看好。

根据Gartner发布的《2025年十大战略技术趋势》报告,智能体AI(Agentic AI)被列为年度首要趋势,预测到2028年,全球约33%的企业级软件应用将集成智能体功能,而这一比例在2024年尚不足1%。

企业端的采纳率数据进一步验证了这一增长的确定性。Capgemini研究报告显示,2025年企业对智能体及多智能体系统(MAS)的利用率已达21%,较2024年的10%实现了翻倍增长。

同时,PwC对300余位高管的调研显示,88%的受访企业表示正因智能体带来的生产力红利而增加AI预算,平均ROI已达到1.7倍。Cloudera的最新数据则显示,96%的IT决策者计划在2026年前进一步扩大智能体的部署规模。

这种近乎一致的扩张意愿,提升了智能体的使用需求。

这是新的增长逻辑,也就会在资本市场带来新的增长故事。

基于当前AI技术和应用的发展趋势,智能体这一波推起来的通用CPU需求,不仅增长速度快,而且还是有持续性的。

这一趋势还处于早期阶段,但增长势头已经不可阻挡。按照任务总延迟来计算,域外CPU的需求增加不比GPU/AI芯片少。

如前文所说,Intel的产能利用率据说已经达到120~130%,而AMD主要靠TSMC,前面已经提到,TSMC的先进工艺产能尽量给了更fancy的GPU,稍次一点的产能现在也已经满载,提升空间也不大。已经有消息表明,2026全年intel和AMD的CPU配额已经被预定完毕。

同属于X86阵营的海光,是否可以为行业提供充足的供应,就考验着中国半导体供应链的韧性了。

在这样的情况下,CPU价格在未来一段时间内怎么能轻易降下来?