据Theinformation报道,Meta公司在多款芯片的研发上都遇到了问题。该公司放弃了一款内部代号为Iris的第二代训练芯片。之后,该公司开始研发一款更先进的训练芯片,代号为Olympus,但现在这款芯片也已被放弃。

一位知情人士透露,Meta 最初计划与 Olympus 合作构建大型服务器集群,但高管最终认为,在与 OpenAI 和 Google 等老牌竞争对手展开激烈竞争之际,这样做会给新模型的训练带来重大风险。例如,用于训练芯片的软件稳定性不如英伟达的产品,而且 Olympus 复杂的设计也可能导致难以大规模生产。

与此同时,据报道,Meta Platforms 已经与谷歌签订一项价值数十亿美元的协议,租用谷歌的 AI 芯片(即张量处理单元)来开发新的 AI 模型。这必将加剧谷歌和英伟达的芯片竞争。

Meta的定制芯片之旅

Meta 进军定制芯片领域是一项深思熟虑的战略,旨在克服现成 AI 加速器在技术和财务方面的局限性。首先从财务上看,Meta自研芯片应该是大有可为。

鉴于 Meta Platforms 在研发和资本支出方面投入了巨额资金——预计 2025 年,其研发投入约为 500 亿美元,资本支出约为 660 亿至 720 亿美元,而其收入约为 1900 亿至 2000 亿美元,因此,按上述各项的中值计算,资本支出约占总收入的 61%——即使基础设施成本降低几个百分点,也能对其盈利能力产生重大影响。

因此不难理解为什么 Meta Platforms 至少想要设计自己的 CPU 和 XPU,并且还要迫使互连 ASIC 制造商(我们将交换、路由和内存互连都包含在内)满足其需求,并威胁说如果他们不这样做,就设计自己的交换和内存结构互连。

而回看Meta这些年的芯片自研之路,Meta Platforms 希望跳过可授权但闭源的 Arm 架构,直接采用开源但仍不完善且尚未成为主流的 RISC-V 架构来构建其未来的计算引擎,这已不是什么秘密。

相关资料显示,该公司于 2020 年开始定制芯片研发,并于 2023 年 5 月推出了 Meta 训练和推理加速器 (MTIA:Meta Training and Inference Accelerator) v1。事实上,这款芯片名称并不贴切,因为它只能进行推理,而不能进行训练。

而按照Meta自身所说,之所以会研发这颗芯片,是因为我们发现,GPU并非总能以其所需的效率水平,高效运行Meta的特定推荐工作负载。为了应对这一挑战,我们设计了一系列专用于推荐的MTIA ASIC芯片。

“我们与下一代推荐模型共同设计了第一代ASIC芯片,并将其集成到PyTorch中,从而创建了一个完全优化的排名系统。此外,我们还保留了PyTorch即时开发模式所带来的用户体验和开发者效率。随着我们持续支持PyTorch 2.0,开发者效率的提升是一个持续的过程。PyTorch 2.0在编译器层面(底层)大幅提升了PyTorch的运行效率。”Meta方面表示。

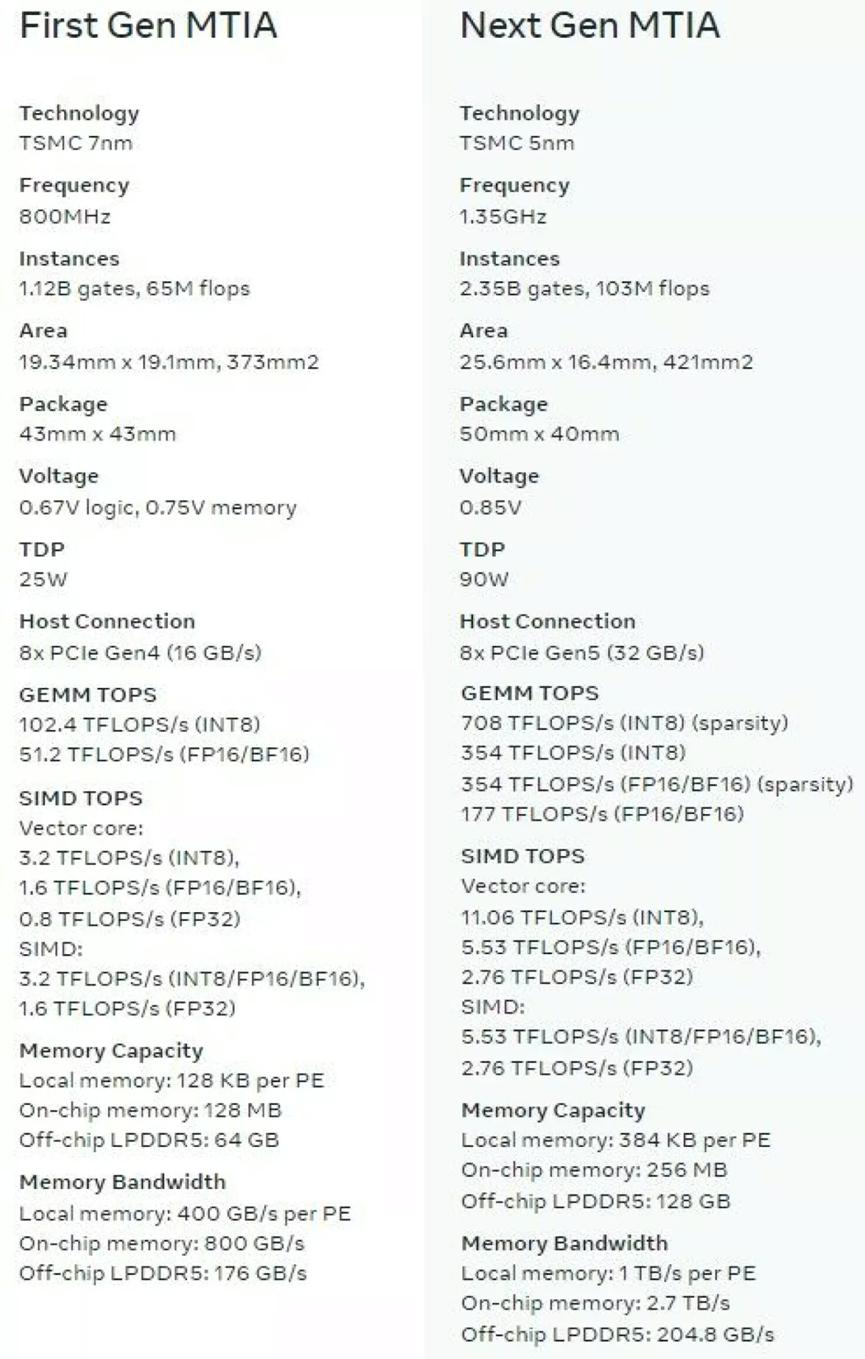

据介绍,MTIA V1是包含芯片、PyTorch 和推荐模型在内的全栈式协同设计解决方案的一部分。该加速器采用台积电 7nm 工艺制造,运行频率为 800 MHz,在 INT8 精度下可提供 102.4 TOPS 的运算能力,在 FP16 精度下可提供 51.2 TFLOPS 的运算能力。其热设计功耗 (TDP) 为 25 W。MTIA加速器安装在小型双M.2板上,便于集成到服务器中。这些板卡通过PCIe Gen4 x8链路连接到服务器的主机CPU,功耗低至35瓦。

到了2024年 4 月,Meta又发不了性能大幅提升的 MTIA v2 发布,这款芯片的推理能力有所提高,但仍然无法进行训练。

“这款芯片的架构从根本上来说是为了在计算能力、内存带宽和内存容量之间找到最佳平衡点,从而更好地服务于排名和推荐模型,”Meta 的三位技术人员在发布 MTIA v2 的博客文章中写道。“在推理过程中,即使批处理大小相对较小,我们也需要能够提供相对较高的利用率。通过提供远超典型 GPU 的 SRAM 容量,我们可以在批处理大小有限的情况下实现高利用率,并在遇到大量潜在并发任务时提供足够的计算能力。”

数据显示,采用7纳米工艺打造的MTIA v1 芯片面积为 373 平方毫米( 19.34 x 19.1 平方毫米),运行频率仅为 800 MHz。MTIA v2 芯片则采用 5 纳米工艺制造,Meta 公司将时钟频率提升了 68.8%,达到 1.35 GHz,同时芯片面积也大幅增大至 421 平方毫米(25.6 x 16.4平方毫米),从而增加了芯片上的 SRAM 容量。面积增加 12.9%,时钟频率提升 68.8%,导致功耗增加了 2.6 倍,达到 90 瓦。此外,PE 单元增加了稀疏性支持,在许多情况下,矩阵运算的性能提升了近 7 倍。在矢量核心上,SIMD 操作性能提高了 72.5%,比时钟速度的提升略好一些。

值得一提的是,这两款芯片均采用基于 RISC-V 内核的处理单元阵列,具体来说,它们由两个内核组成:一个内核负责标量运算,另一个内核则配备向量引擎,用于处理整数和浮点数据。MTIA v1 在 Meta 数据中心服务器集群中部署规模适中,而性能更强大的 MTIA v2 的部署规模则更为庞大。

从这两代产品可以看到,Meta一直还是在推理上深耕,还没有涉足训练芯片。而且,据相关报道,即使如此,该公司还是碰到了不少波折。但是他们依然毅然决然地进军训练芯片。如上所述,他们这个芯片不出意外地屡受波折。

于是,收购芯片公司,成为了他们的新发展方向,芯片初创公司Rivos就成为了他们的目标。

收购Rivos增加筹码

2025年10月,有消息称,Meta 收购了人工智能芯片初创公司 Rivos。在很多人看来,这与AWS当年收购Annapurna Labs异曲同工,只是晚了十年。

据Walden Catalyst所说,2025年初,Rivos准备进行下一轮融资时,投资者反响热烈,最终超额认购。在融资过程中,公司还收到了多家收购要约。经过慎重考虑,创始人、董事会和投资者最终选择了Meta的收购方案:这一决定既肯定了Rivos的技术实力,也认可了其愿景的战略重要性。

资料显示,Rivos成立于2021年9月,由陈立武和Amarjit Gill共同创立。

Amarjit Gill是MIPS芯片制造商SiByte(2000年被博通收购)和Power芯片设计公司PA Semi(2008年被苹果收购)的联合创始人;Rivos的联合创始人之一Tse-Yu Yeh曾在苹果工作超过17年,从架构和验证高级工程师一路晋升为CPU设计高级总监;联合创始人Puneet Kumar曾效力于鼎盛时期的Digital Equipment Corp;Rivos的另一位联合创始人Mark Hayter 的职业道路与Belli Kuttanna类似,他曾先后在DEC、SiByte、博通、PA Semi、苹果、Agnilux和谷歌工作;Rivos的最后一位联合创始人是Belli Kuttanna,在加入Rivos之前,他曾在德州仪器、摩托罗拉、Sun Microsystems、高通(短暂任职)和英特尔担任芯片设计师和架构师。

在 Walden International 的支持下,Rivos 成立之初就拥有超过百名员工,Tan 被任命为董事会主席。这在一定程度上使 Rivos 能够使用先进的 EDA 工具,并利用台积电的代工技术和产能。

2023 年,Rivos 从苹果公司挖走了近 50 名工程师,导致与苹果公司发生诉讼,最终由 Tan 促成和解。当时,Rivos 正在研发 CPU 设计,但 Tan 建议公司专注于 AI 加速,而与 Meta 的合作正是这一转型的结果。根据 Walden 的声明,Rivos凭借卓越的技术进步实现了其愿景。该公司成功流片了3.1 GHz处理器,并构建了兼容CUDA的软件栈,使得原本为NVIDIA生态系统开发的AI工作负载能够在RISC-V硬件上无缝运行。这种“重新编译而非重新设计”的方法降低了客户的采用门槛,同时展现了Rivos业界领先的性能和能效。

Rivos表示,其设计为从模型训练到推理等一系列工作负载提供了可扩展性和能效。“该架构通过最大限度地减少外部数据传输和降低功耗,消除了计算和内存资源之间的不平衡,”该公司在一份白皮书中表示。“它避免了常见的资源不匹配问题,即仅仅为了弥补内存限制而部署额外的GPU单元,从而导致资源利用率低下。”

在完成A轮融资的时候,Rivos也曾表示,Rivos 提供功耗优化的芯片,该芯片结合了高性能服务器级 RISC-V CPU 和数据并行加速器(一种针对大型语言模型 (LLM) 和数据分析优化的 GPGPU),可满足当今软件编程模型和机架服务器的限制。CPU 和并行计算的紧密集成,以及在 DDR DRAM 和 HBM 上共享统一内存,使其成为当今需要 TB 级内存的模型和数据库的理想选择。

由此可见,Rivos 似乎正在打造一种类似英伟达 Grace-Hopper 和 Grace-Blackwell CPU-GPU“超级芯片”的芯片或封装式混合 CPU-GPU 计算系统。而且,该系统很可能基于 RISC-V 架构,更重要的是,它兼容英伟达的 CUDA-X 软件栈。CUDA-X 是一种并行编程模型,它与一系列算法、库和框架相结合,用于将软件从 CPU 卸载到 GPU 上进行加速。正是 CUDA-X 赋予了英伟达强大的定价权。

通过这单收购,Meta 将受益于一支能够制造高端 RISC-V 芯片的团队,这些芯片可以根据其 AI 工作负载进行定制,让公司在英伟达和AMD等巨头把持的市场中找到新的机会。

写在最后

虽然Meta野心勃勃,但如文章开头所说,他们还是需要继续交学费。最近他们与英伟达和AMD的交易,也侧面证明了公司在自研芯片上的波折。继一周多前与英伟达达成了数百万颗GPU的交易外,Meta日前与AMD也达成了6吉瓦的GPU交易。通过这两单交易,让他们在未来的算力竞争中获得了更多的筹码。而通过和两个巨头合作,则分担了风险并增加了谈判筹码。

再加上文章开头谈到的TPU交易,Meta正在下一盘大棋。

在最新的模型中,谷歌已成功证明,其在处理最关键的内部工作负载时可以绕过英伟达。目前,Gemini 3 和 4 几乎完全(95-100%)在谷歌内部 TPU 上进行训练,而英伟达 GPU 实际上仅处理该特定工作负载的 0-5%。对于搜索和 YouTube 等内部推理任务,TPU 仍处理约 85-90% 的业务量。

正是基于这个成功经验,谷歌瞄准英伟达的地盘,计划推出 TPU 即服务模式,作为 GPU 的可行替代方案。

据theinformation引述一位参与谈判的人士的消息透露,Meta 还一直在与谷歌洽谈,计划最早于明年为其数据中心购买 TPU,但目前尚不清楚谈判进展如何。对谷歌而言是一项胜利,它为其增添了一位知名客户,有助于其打造数十亿美元的 TPU 销售业务。与此同时,这也对英伟达构成了威胁。英伟达目前主导着人工智能芯片市场,并向 Meta 提供图形处理单元 (GPU) 以支持其人工智能的开发(即训练过程)。

除了与 Meta 达成协议外,谷歌还与一家未透露名称的大型投资公司签署了一项协议,为一家合资企业提供资金,该合资企业将向其他客户租赁 TPU。谷歌正在与其他投资公司洽谈,以资助其他类似的合资企业。

毫无疑问这次和Meta的合作,为TPU增加了更多可能,也为英伟达的GPU垄断增加了变数。

但对Meta来说,他们更需要关心的事,自研的训练芯片,什么时候才能如愿。