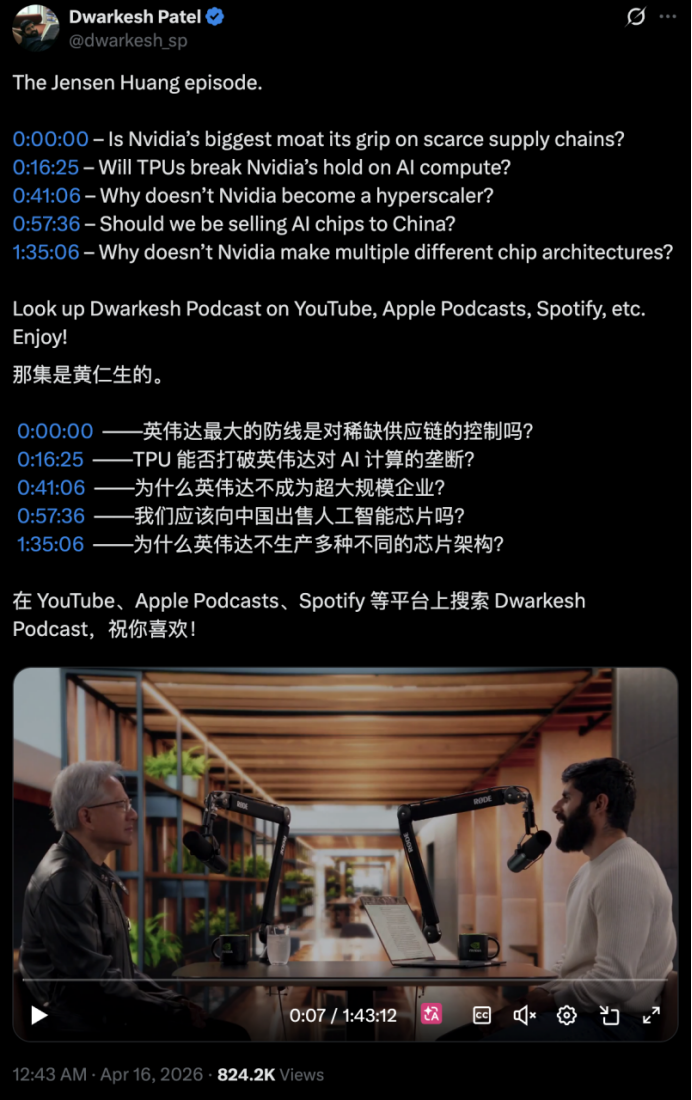

凌晨,英伟达CEO黄仁勋接受了知名科技主持人Dwarkesh Patel的专访,长达1小时45分钟。

这位油管百万大V以递进式的提问方式和极其锋利的选题而出名,这次也不例外地选择了直白开场,一上来就直戳英伟达的“肺管子”,问黄仁勋:“如果软件被商品化了,那英伟达会不会也被商品化?”

有网友评价这次访谈:很少见黄仁勋这么“生气”。

在这次访谈中,黄仁勋深度回答了关于AI时代的竞争本质、英伟达如何锁住供应链、为什么不做AI云,以及中国与AI芯片等问题。

我们整理了这次访谈,内容亮点都在下面。

01

英伟达真正的护城河不是芯片,是供应链

Dwarkesh:现在市场上有一种看法是,AI会让软件逐渐商品化,很多软件公司的估值已经因此下滑了。

从一个可能比较天真的角度来看:你们把设计交给晶圆厂,比如把GDS文件交给TSMC(台积电),再由他们制造芯片,然后再和像SK Hynix、Micron、Samsung做的HBM封装在一起,最后送到ODM厂组装成整机。

所以本质上,英伟达做的是软件,只不过由别人来制造。如果软件被商品化了,那英伟达会不会也被商品化?

黄仁勋:归根结底,总有一件事必须发生:把电子变成Token。不仅仅是变成Token,还要让这些Token越来越有价值。我认为这件事很难被完全商品化。

把电子转化为Token本身就是一段非常复杂的旅程,就像让一个分子比另一个分子更有价值一样,这里面包含了大量的艺术、工程、科学和发明。我们现在正在亲眼见证这一切发生,而这个过程远没有被完全理解,也远没有结束。所以我不认为它会被商品化——当然,我们会让这个过程变得更高效。

如果用刚才的方式来理解英伟达,已经接近我对公司的心智模型了:输入是电子,输出是Token,中间就是英伟达。我们的工作是用尽可能少的东西,完成这个转化过程,并把能力做到极致。

所谓“尽可能少”,意思是能不做的事情,我们就不做。我们会把这些事情交给合作伙伴,让它成为整个生态的一部分。如果你看今天的英伟达,我们在上下游都有极其庞大的合作生态,所以我们尽量少做,但我们必须做的那一部分是极其困难的。我不认为这部分会被商品化。

Dwarkesh:那企业软件公司呢?很多人觉得它们会被AI冲击。

黄仁勋:现在很多软件公司,本质上是“工具制造商”。比如Excel、PowerPoint,或者像Cadence、Synopsys。当然也有一些是流程系统,但很大一部分是工具。但我看到的趋势是完全相反的:未来Agent的数量会指数级增长,使用这些工具的用户也会指数级增长。也就是说工具的使用量,会暴涨。

举个例子:像Synopsys Design Compiler这种工具,未来它的实际用量很可能会暴涨。今天我们被工程师数量限制住了,但未来,每个工程师都会有一堆Agent辅助。这些Agent会去探索设计空间,探索的程度会远远超过今天。而它们会用的,正是今天这些工具。

所以我认为工具的使用量,会推动这些软件公司的增长,而不是压垮它们。这件事之所以现在还没有发生,是因为Agent还不够会用工具。接下来会发生两件事:要么这些软件公司自己去做Agent;要么Agent变得足够强大,可以使用这些工具。最终很可能是两者同时发生。

Dwarkesh:在你们最近的财报里,我看到英伟达已经有接近1000亿美元的采购承诺,还有分析认为这个数字可能会达到2500亿美元。有一种解读是这样的:英伟达的护城河在于你们锁定了未来几年关键的稀缺资源,比如晶圆、内存、封装。别人即使有芯片设计能力,也不一定能拿到这些资源。这是你们未来几年的核心优势吗?

黄仁勋:这是我们能做到、但别人不太容易做到的一件事情。原因其实很简单:我们之所以能在上游做出这么大的承诺,是因为我们有能力把这些产能买下来,并且卖出去。

那些承诺有些是显性的,比如我们直接签的采购合同;但也有很多是隐性的,比如我们的供应链伙伴会自己去做投资。因为我会和他们的CEO沟通,我会告诉他们这个行业会变多大、为什么会变大、我们是如何推理出来的。在这个过程中,我其实是在对齐整个上游生态的认知。

那为什么他们愿意为我们投资,而不是为别人?原因很简单:他们知道我有能力把他们的产能买下来,并卖给下游。英伟达的下游需求非常大,正是因为有这种下游需求的规模,才让他们愿意在上游投入。

如果你去看GTC大会,你会发现很多人对它的规模感到惊讶。这是一个360度的AI生态,整个AI世界的人都在一个地方,而他们来这里,是因为他们需要彼此。上游需要看到下游,下游需要看到上游。他们也需要看到AI的发展,以及那些AI原生公司和创业公司。

我花了很多时间,不断去告知和影响我们的供应链和生态伙伴,让他们理解机会是什么、为什么会发生、什么时候会发生、规模会有多大。很多人会觉得我的Keynote有点像上课,甚至有点折磨,但这是故意的。因为我需要让整个生态,像我一样去理解未来。

03

没有任何一个瓶颈,会持续超过2到3年

Dwarkesh:我想更具体地理解一个问题:上游供应链真的能跟得上吗?你们过去几年基本是收入翻倍增长,同时提供给全球的算力也在大幅增长。现在这个规模已经很大了,比如你们是TSMC先进制程(N3、N2)的最大客户之一,甚至有分析说,今年AI会占到N3产能的60%,明年可能到80%以上。

那问题来了,如果你已经是最大客户了,你还怎么继续“翻倍”?这个增长会不会被上游限制住?

黄仁勋:在某一个时间点上,需求超过供给,是很正常的事情——甚至,这是一种好状态。你希望一个行业的即时需求是大于总供给的。当然,也可能会在某一个具体环节被卡住,比如说,有时候真的会被“水管工”卡住(笑)。

Dwarkesh:水管工?

黄仁勋:对,真的。你可能在某个时间点,被某个完全意想不到的环节限制住。但这并不是坏事,因为当某一个瓶颈出现的时候,整个行业会迅速“围攻”它。

举个例子:前几年大家一直在讨论CoWoS,但现在你已经很少听到有人谈这个问题了。因为过去两年,整个行业对它进行了极端投入,连续扩产,现在基本已经解决了。TSMC现在也已经意识到,CoWoS的供给必须和逻辑芯片和内存的需求同步扩展。以前,CoWoS和HBM是“特殊技术”,但现在已经不是了,它们已经变成了主流计算的一部分。

我们现在比以前更有能力去影响更大范围的供应链。我现在说的这些其实5年前我就已经在说了,有些公司当时相信并且投资了,比如Micron,我还记得当时和他们CEO的那次会面,我当时非常明确地告诉他们,未来会发生什么、为什么会发生。他们当时真的投入了,而且投入得很深。从LPDDR到HBM,他们都做了很多投资,结果当然也非常好。有些公司后来才跟上,但现在大家基本都已经在这个节奏里了。

所以我的看法是:没有任何一个瓶颈,会持续超过两到三年,每一代都会有新的瓶颈,但也都会被解决。现在大家已经开始提前几年去预判这些瓶颈,并提前投资。比如硅光(silicon photonics),比如新的封装技术、新的测试设备……我们在过去几年做了很多这样的事情,本质上是在“重塑供应链”,让它为未来的规模做好准备。

Dwarkesh:听起来有些瓶颈比其他更容易扩展,比如CoWoS和封装可以扩,但有些东西,比如制造能力本身,可能更难。

黄仁勋:我刚才其实已经说到最难的那个了:水管工,还有电工。这是最难扩展的。

这也是为什么我对现在很多末日论者“AI会终结工作”的说法感到担忧。如果我们去劝年轻人不要做软件工程师,那未来我们就会缺软件工程师。10年前,有人说“千万不要做放射科医生”,说这是第一个会被AI取代的职业,这些视频现在网上还能找到。结果呢?我们现在缺放射科医生。

Dwarkesh:回到刚才的问题,制造能力这边,你如何让晶圆产能每年翻倍?如何让EUV设备每年翻倍?

黄仁勋:这些都不是问题,它们都可以在2到3年内扩展。关键只有一个,那就是需求信号(demand signal)。一旦有明确的需求,能做1台,就能做10台;能做10台,就能做100万台……这些东西并不难复制。

Dwarkesh:那你会不会直接去跟ASML说:“未来三年我们需要更多EUV机器”?

黄仁勋:有些事情我会直接做,有些是间接做。如果我能说服TSMC,那ASML自然也会被说服,所以要找到真正的关键节点。但这些都不让我担心——真正让我担心的是能源,你不可能在没有能源的情况下建立一个新产业。无论是想重建制造业、建AI工厂、做电动车、做机器人,这些都需要能源,而能源是一个长期问题。相比之下,芯片产能和封装只是2到3年的问题。

Dwarkesh:我听过一些完全相反的说法,所以我不确定该相信谁(笑)。

黄仁勋:你现在是在跟专家对话(笑)。

04

AI只是计算的一部分,而计算远不止AI

Dwarkesh:我想再回到竞争问题,比如Google TPU。现在世界上最强的模型里,有相当一部分是在TPU上训练的,这对英伟达意味着什么?

黄仁勋:我们做的东西是完全不同的。英伟达做的是加速计算(accelerated computing),而不是一个“张量处理单元”。加速计算被用在各种各样的领域,比如分子动力学、数据处理、流体力学……当然,也包括AI。

AI现在是最热门的讨论方向,但计算远不止AI。我们做的是重新发明计算方式,从通用计算走向加速计算。我们的覆盖范围比任何TPU都要大得多,因为我们可以加速所有应用。

Dwarkesh:但现实情况是,你们现在的收入绝大多数还是来自AI,而不是来自药物发现或者量子计算。而AI的核心计算,很多人认为就是矩阵乘法。TPU在这方面是高度优化的,虽然GPU更通用。那问题是,对于当前这波AI需求来说,TPU是不是更适合?

黄仁勋:矩阵乘法确实很重要,但它不是全部。如果你想发明新的attention机制,想用不同方式做计算分解,或者想设计全新的模型架构,比如混合SSM模型,融合diffusion和autoregressive模型……你需要的是一个完全可编程的系统。

AI进步的核心是算法。摩尔定律大概每年提升25%,但我们却在实现10倍甚至100倍的提升。这些提升来自新的算法、新的模型结构、新的计算方式,而如果没有可编程性,你甚至不知道从哪里开始做这些创新。

Dwarkesh:那我们聊一个更现实的问题。你的客户,比如Amazon、Google、Microsoft,他们有能力写自己的kernel,甚至做自己的软件栈。那CUDA还重要吗?

黄仁勋:CUDA是一个非常丰富的生态系统。如果你要开发系统,从CUDA开始是非常合理的。我们支持所有框架,如果你要写自定义kernel也可以。我们甚至在Triton里投入了大量技术。

但你要考虑,当系统出问题时,是你的代码有问题,还是底层系统有问题?你当然会希望问题出在你自己这里,CUDA的价值就在于,你可以信任底层。

另外一个关键点是安装基数(install base),作为开发者,你最想要的是你的软件可以运行在大量机器上。我们现在有数亿GPU,在所有云平台上,各种型号,各种规模。这意味着,你开发一次,就可以在全世界运行。

Dwarkesh:但如果你的主要客户是这些超大公司,他们完全可以为自己的系统优化,甚至支持多个硬件平台。你的优势还成立吗?

黄仁勋:我们有大量工程师直接和这些AI公司合作。而且你要理解,GPU不是CPU:CPU就像一辆巡航车,谁都能开;但GPU更像F1赛车,你可以开,但要开到极限,需要专业能力。我们用大量AI来优化kernel,很多时候,我们帮客户优化之后,性能提升2倍,有时候3倍……哪怕提升50%都是巨大的。而对于一个拥有巨大算力集群的公司来说,性能提升,直接意味着收入提升。

Dwarkesh:如果这些客户可以自己做优化,竞争是不是会变成谁的价格更低、性能更高?

黄仁勋:我们在这些AI实验室里有大量工程师在帮他们优化,没有人比我们更了解我们的架构。GPU不像CPU那样完全通用,它更复杂,我们可以帮他们从系统里再挖出2倍性能。而且我们的系统,在整个行业里拥有最好的TCO(总拥有成本),没有任何一家公司可以证明自己在TCO上比我们更好,无论是训练还是推理。

Dwarkesh:但还是有公司在用其他方案。比如Anthropic最近宣布和Broadcom以及Google合作,很多计算在TPU上。

黄仁勋:这是一个非常特殊的例子。如果没有Anthropic,TPU的增长几乎不存在,他们是一个极端案例。

Dwarkesh:但OpenAI也在和AMD合作,甚至在做自己的芯片。

黄仁勋:但他们绝大多数计算还是在英伟达上,我们也会继续和他们合作。我不介意别人尝试其他方案。如果他们不尝试,怎么知道我们有多好?我们必须持续证明自己。

你看看历史上那些做ASIC的项目,有多少最后是做不下去、被砍掉的。做一个比英伟达更好的系统并不容易。

Dwarkesh:他们的逻辑是不需要比你更好,只要不比你差太多,但成本更低就可以。

黄仁勋:ASIC的利润率其实也很高,大概是65%,英伟达是70%。差距没有你想的那么大。

Dwarkesh:那回到一个问题,为什么英伟达没有更早投资这些AI公司?

黄仁勋:我们在能做的时候,就做了。在更早的时候,我们没有能力做那种级别的投资(几十亿美元),那在当时不是我们的模式。

而且我当时没有意识到,这些公司其实没有其他融资路径——我当时以为他们可以像普通公司一样去找VC(风险投资)融资,但后来我才意识到,他们要做的事情,VC根本投不了。这是我的误判。

Dwarkesh:现在你们有大量现金。为什么不自己做云?成为像AWS那样的公司?

黄仁勋:这是我们的公司哲学:做必须做的事情,尽量少做其他事情。如果我们不做某件事,这个世界就不会有,那我们就必须做。但云这件事,如果我们不做,会有很多公司来做。所以我们不做。

05

对中国的态度:算法才是关键

Dwarkesh:很多分析认为,中国在先进制程上落后。比如他们很多还是在7nm,没有EUV设备。在算力上,有人估算,他们大概只有美国的十分之一,在HBM带宽上,差距可能接近一个数量级。那是不是意味着美国可以先达到这些能力,先部署,先修补漏洞,从而获得安全优势?

黄仁勋:如果你要让这个逻辑成立,那你必须假设他们没有算力,但这不是现实。他们已经有大量算力。中国是全球第二大计算市场,如果他们愿意集中资源,他们完全可以聚合足够的算力。

Dwarkesh:但他们在带宽、内存等方面还是落后。

黄仁勋:那他们就用更多芯片。AI本质上是并行计算问题。如果你有足够的能源,你可以用更多节点来弥补差距。他们有大量能源,他们有很多已经建好的数据中心,甚至有空置的。他们可以用更多芯片,把系统拼起来,而且他们的芯片制造能力本身就很强。所以“他们没有AI芯片”这个说法是错误的。

Dwarkesh:但先进芯片确实存在差距,比如带宽差距可能接近一个数量级。

黄仁勋:那他们就用更多节点连接起来。就像我们用NVLink一样,他们也已经在做类似的事情。比如华为,他们已经在把大量计算节点连接成一个系统,通过硅光(silicon photonics)等技术把大量计算资源连接在一起。所以如果你只看单个芯片,你会低估整个系统。

而且不要忘了,算法才是关键。他们有大量优秀研究者,这才是他们最大的优势。很多AI进步来自算法,而不是硬件。如果你在算力上受限,你反而会被逼去做更好的算法,比如DeepSeek——这不是一个无关紧要的进展。它代表的是一种能力:在算力受限的情况下,依然能做出非常强的模型。

Dwarkesh:那如果DeepSeek这样的模型在华为芯片上首先优化、首先跑起来呢?

黄仁勋:那就是一个很糟糕的结果。如果一个强大的模型,在非美国技术栈上运行得更好,那对美国来说是坏消息。

06

即使没有AI,英伟达也会是一个非常大的公司

Dwarkesh:刚才我们在讨论TSMC和内存这些瓶颈。那如果未来是这样一个世界:你们已经占据了N3的大部分产能,未来还会占据N2的大部分产能。那有没有一种可能,你们会回到更旧的制程,比如7nm,利用那些“闲置产能”,重新做类似Hopper或者Ampere这样的架构,但结合今天在数值计算、系统设计等方面的进步。你觉得这种情况,会不会在2030年前发生?

黄仁勋:没有必要这样做。因为每一代架构的进步,不只是晶体管规模。它还包括大量工程优化、封装、堆叠、数值计算(numerics)、系统架构等等,如果你想回到旧制程,那意味着你要重新做一整套研发。这是一个几乎没有人负担得起的研发成本。

我们可以向前推进,但我不认为我们能向后回退。当然,如果我们做一个思想实验:如果有一天,世界真的说“我们再也不会有更多先进产能了”,那我会不会立刻用7nm?当然会。毫不犹豫。

Dwarkesh:还有一个问题,是别人问我的。为什么英伟达不同时做多个完全不同的芯片项目?比如类似Cerebras那种超大芯片、类似TeslaDojo那样的系统,甚至做一个完全不依赖CUDA的架构。你们有资源、有工程能力,为什么不把赌注分散?毕竟AI未来的架构方向还不确定。

黄仁勋:我们当然可以这么做。只是我们没有看到一个更好的方案。这些东西我们都在仿真系统里模拟过,它们的效果其实更差。所以我们不会去做。我们现在做的,就是我们认为最正确的架构。

当然,如果未来工作负载本身发生变化——我说的不是算法变化,而是工作负载的形态变化,那我们可能会增加新的加速器。比如最近,我们引入了Grok相关的方向,并且会把它整合进CUDA生态。

这是因为Token的价值变高了。几年前,Token几乎是免费的,或者非常便宜。但现在不一样了,现在不同客户对Token有不同需求。比如,如果我是软件工程师,我愿意为更快响应的Token付钱,因为它能让我更高效。这个市场是最近才出现的。

所以我们现在可以做一件事:同一个模型根据响应时间,划分出不同市场。这也是为什么我们决定扩展推理的“帕累托前沿”(Pareto frontier)做一个响应更快、但吞吐更低的推理形态。

过去大家都认为吞吐越高越好,但现在可能出现一种市场:Token价格很高(ASP高),即使吞吐低,整体收益仍然更高。如果是这样那我们就会去做。但从架构角度来说,如果我有更多资源,我更愿意把它投入到现有架构上,而不是分散。

Dwarkesh:这个高价Token市场的想法非常有意思。

黄仁勋:是的,本质是市场分层(segmentation)。

Dwarkesh:最后一个问题。假设深度学习革命没有发生,英伟达今天会在做什么?

黄仁勋:还是同一件事:加速计算。我们公司的基本假设一直是,摩尔定律会放缓,通用计算不会适用于所有问题。所以我们把GPU和CPU结合,让GPU去加速特定计算。

不同的算法、不同的kernel,可以被卸载到GPU上执行,从而让应用加速100倍、200倍。这些应用在几乎所有地方:科学计算、工程、物理、数据处理、图形计算、图像生成……即使没有AI,英伟达也会是一个非常大的公司。

因为这是一个更基础的问题,通用计算的扩展已经接近极限,而解决方案就是领域专用加速(domain-specific acceleration)。我们从图形开始,但其实有无数其他领域,像分子动力学、地震数据处理、能源勘探、图像处理……这些都是通用计算无法高效解决的问题。我们的使命一直是把加速计算带给世界,推动那些通用计算无法突破的领域。

当然,如果没有AI,我会很难过。但正是因为我们在计算上的这些进展,让深度学习更加普及,让任何人都可以用一张GPU卡做出很厉害的事情。这一点,从来没有改变。

如果你去看GTC,前面很大一部分内容其实都不是AI。比如计算光刻、量子化学、数据处理,这些都是非常重要的工作,只是没有AI那么火。

世界上有很多重要的事情并不依赖AI,而Tensor也不是唯一的计算方式。我们希望帮助所有人。