3月3日消息,阿里昨晚开源四款千问3.5小尺寸模型系列,包括Qwen3.5-0.8B/2B/4B/9B。基于模型技术创新及突破,小尺寸的千问3.5模型性能也极为强劲:Qwen3.5-9B综合性能媲美大其10倍参数量的模型性能;Qwen3.5-4B的Agent能力表现优于当前一些国际主流模型,适合作为轻量级Agent的多模态底座;Qwen3.5-0.8B/2B体积小、速度快,特别适合手机、智能眼镜等端侧部署。开源发布后,马斯克第一时间在社交媒体上表示千问3.5“智能密度令人印象深刻”。

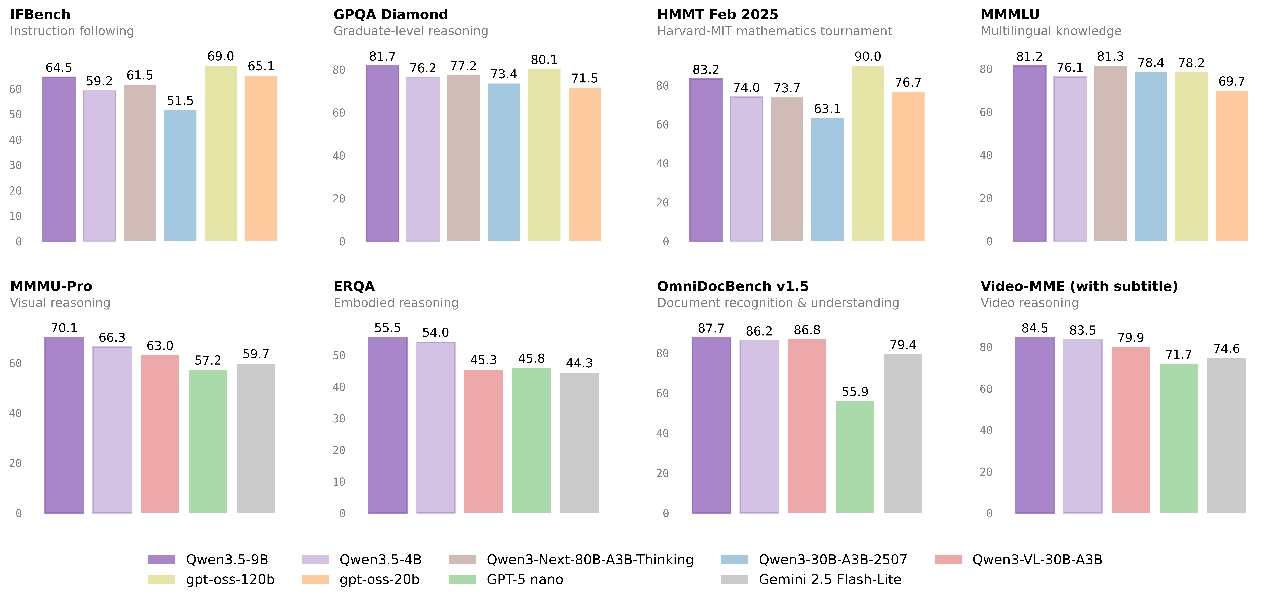

依托于模型架构创新和训练突破,千问3.5首次在小尺寸的稠密(Dense)模型中实现了强大的原生多模态能力,模型智能水平和视觉理解能力双双增强,小尺寸模型也开始拥有中型乃至大型模型的性能水平,智能密度再创新高。在涵盖指令遵循(IFBench)、博士级别推理(GPQA)、数学推理(HMMT 25)、具身推理(ERQA)、复杂文档理解(OmniDocBench)等多个权威评测中,Qwen3.5-9B性能媲美规模大10倍的Qwen3-Next-80B-A3B-Thinking等模型,大幅优于国际主流轻量级模型,是性价比极高的通用模型选择。

更小尺寸的4B模型,完美平衡了性能与资源消耗,拥有极强的Agent能力,适合作为轻量级Agent的多模态基座。在视觉智能体(ScreenSpot pro)评测中,Qwen3.5-4B性能与尺寸大它近8倍的Qwen3-VL-30B-A3B持平,可以做到像真人一样自主操作手机与电脑;在工具调用(TIRE-Bench)评测中,千问4b模型表现大幅优于当前国际主流模型。极致小尺寸的Qwen3.5-0.8B/2B模型,体积小,推理速度快,可直接部署在手机、平板、智能座舱、可穿戴设备等终端硬件上,或为离线语音交互、本地文档解析、实时感知决策等端侧AI应用开辟新可能。有专家表示,随着千问3.5小模型的出炉,未来AI核心落地场景将在端侧全面爆发。

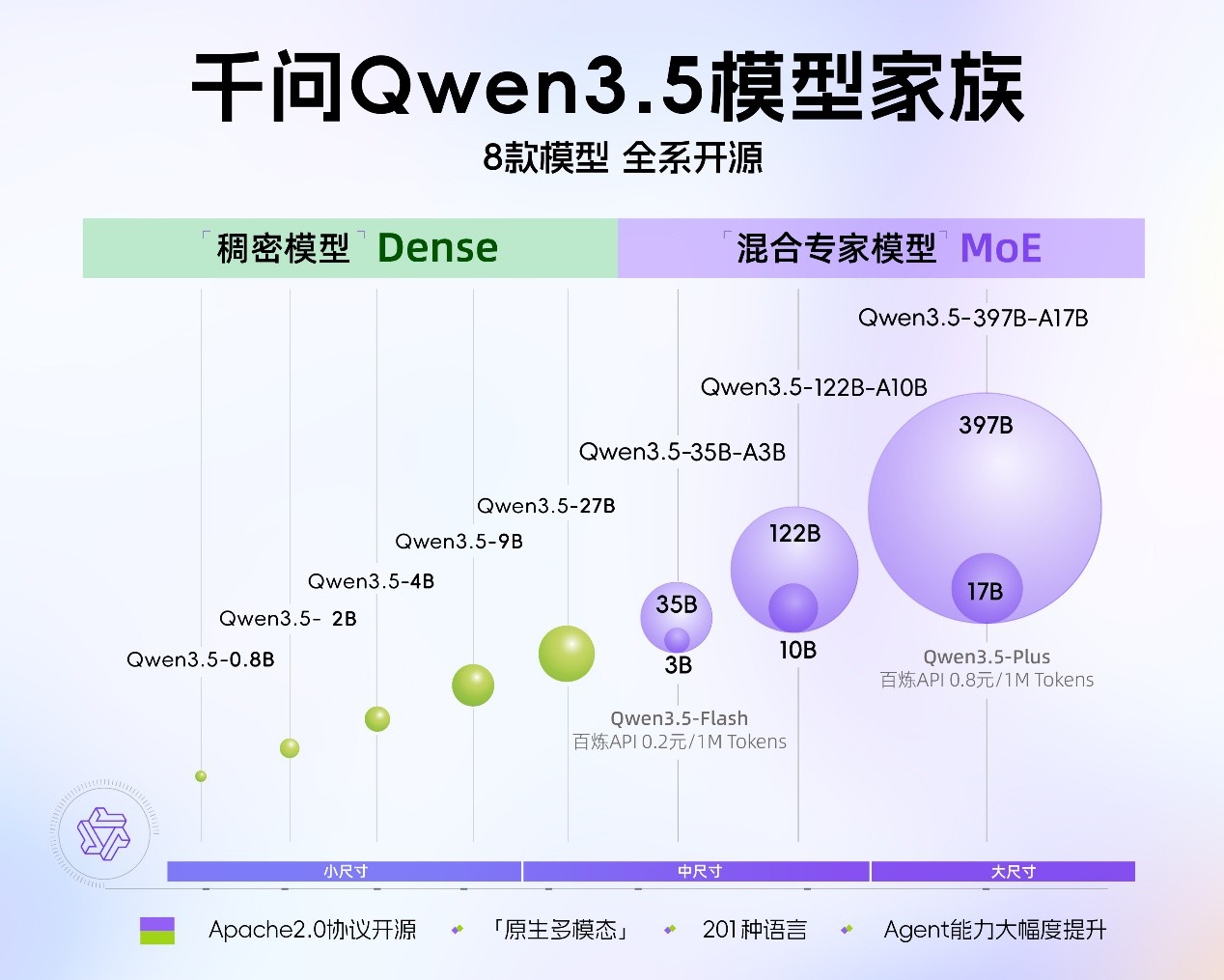

目前,千问3.5已开源8款新模型,均实现了“以小胜大”,这也是让马斯克惊艳的“智能密度”提升,以更少的计算量提供更强大的智能。除夕发布的新一代原生多模态基模Qwen3.5-397B-A17B,不到4000亿参数超越上代万亿参数的千问3旗舰模型;上月底开源的三款中等尺寸模型Qwen3.5-35B-A3B、Qwen3.5-122B-A10B、Qwen3.5-27B,性能强劲,消费级显卡就能跑。开源首月,千问3.5即横扫全球开源模型排行榜,前五独占四席,引爆AI社区。有开发者实测发现,仅凭一台配备了M4芯片的普通笔记本电脑,就能在本地高速运行中等尺寸的千问3.5模型,性能与顶级模型相当;有开发者惊呼:“千问凭一己之力,把Claude Sonnet 4.5级别的模型装进电脑,而且免费。”

据了解,阿里坚持全尺寸、全模态的全面开源,涵盖大语言模型、数学、编程、语音、视觉等不同领域,共计开源400多款千问模型,全球下载量突破10亿次,衍生模型数超20万,是全球极具影响力的开源模型体系。