三个月,26万星标。一个名为OpenClaw的开源项目,在没有巨头背书、没有明星光环的情况下,仅凭一行“让AI在你电脑上真正干活”的描述,点燃了全球开发者的热情。

它的诞生,源于一个开发者试图解决AI“能说不能做”的个人实验。如今,这场实验已演变为全球开发者共同参与的范式迁移——AI正从“对话者”变成“执行者”,从云端回到本地,从“能说”到“能做”。

这个故事的主角,是一个在“山洞里敲代码”的独立开发者。而它的观众,是每一个渴望让AI真正为己所用的创造者。

01 从开源到26万star的现象级增长

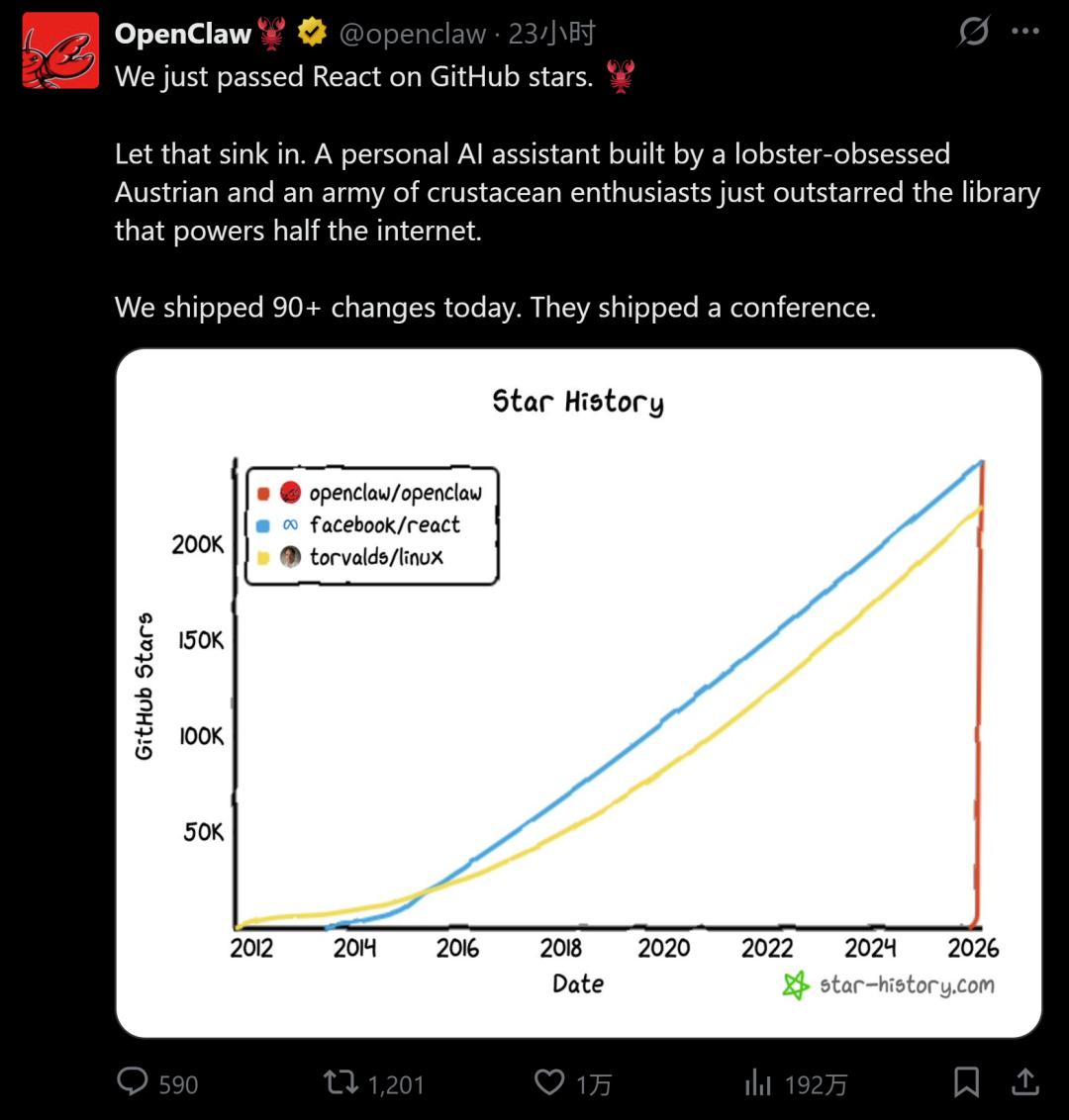

创建于2025年11月24日的OpenClaw仓库在GitHub上创下现象级增长纪录。

其星标数在短时间内从10万飙升至超过20万,截至目前其star数已达到26.4万,在三个多月的时间里跃居全球开源项目星标榜前列,持续吸引着全球开发者的关注。

从一个人的疯狂试错,到数十万开发者的集体围观与共建,OpenClaw的成长轨迹,本身就是AI时代开发者力量的最佳注脚。

这不是一个典型的开源故事。

没有科技巨头的背景加持,没有明星创业者的光环,甚至没有一场像样的发布会。OpenClaw的起点,只是GitHub上一个名为openclaw/openclaw(曾用名:Clawdbot、Moltbot)的空仓库,首行提交记录是一段简单的README:“一个让AI能在你电脑上真正干活的框架。”

但正是这行朴素的描述,击中了全球开发者集体焦虑的痛点。

在过去三年里,AI行业陷入了一种奇怪的悖论:大模型的参数规模每季度翻倍,benchmark分数屡创新高,但普通开发者能实际构建的应用,却仍然局限在“聊天机器人”、“内容生成”、“代码补全”这几类有限场景。

问题出在权限——云端的AI再聪明,也无法读取你的本地文件、不能操作你的数据库、不能调用你的私有API。

OpenClaw正是通过赋予AI本地执行权限来打破这一困境。它采用本地优先架构,让AI能够直接执行上面的操作。正是这种能力让OpenClaw在GitHub上迅速走红——上线后保持稳定增长,Skill仓库数量持续增加,覆盖开发、设计、数据分析等多个专业领域。

“很多人以为OpenClaw是一夜成名,但其背后是长达十个月的疯狂试错。”OpenClaw创建者Peter Steinberger在访谈中坦言。这位曾开发PSPDFKit并成功出售公司的开发者,在经历了一段时间的休整后,被AI技术的可能性重新点燃。

真正让Steinberger确认OpenClaw具备极高市场契合度的,是AI智能体展现出的“涌现能力”。他在访谈中回忆了一个关键案例:某天,有人向他的AI智能体发来一条语音信息。按照原本的程序逻辑,AI不具备处理这种未知音频文件的能力。然而,令人惊讶的一幕发生了:AI开始显示“正在输入”。

“我当时就在想,我根本没写过这个功能,这怎么可能奏效?”Steinberger回忆道。当他询问AI是如何做到的时,AI的回答揭示了当前大模型的自主规划能力:“你发给我一个没有后缀的文件。我查看了文件头,发现它是Opus音频格式,所以我在电脑上调用了FFmpeg把它转换了。我想转录它,但你没安装Whisper,于是我四处寻找,用curl命令把文件发给了OpenAI的接口,拿回了文本。”

这个细节极具穿透力。AI已经跨越了“你让我写一段代码”的阶段,进化到了“你给我一个问题,我自主调用系统工具链去寻找答案”。这正是OpenClaw想要解决的核心问题:让AI拥有执行权限,像人类一样操作电脑。

基于这一理念,OpenClaw从架构设计、权限管理和能力扩展三个维度构建了解决方案。它采用本地优先架构,确保所有代码、数据、记忆都在本地运行,不依赖云端API;建立透明的权限管理系统,让用户清晰了解AI的权限边界;并通过插件化的“Skills”机制,让开发者能够为AI赋予任意新能力。

这三个技术选择看似针对具体问题,实则每一处都触及了行业的深层症结:本地优先挑战了云原生的惯性,权限透明重构了人机信任关系,插件化机制则重新定义了开发者的协作方式。当这些设计被整合到一个框架中时,它们不再只是技术方案,而是成为了新范式的宣言。

曾经,这些设计只存在于Steinberger的个人需求清单中;如今,它们已成为全球开发者构建AI执行体的通用语言,驱动着无数创意从个人想象走向现实应用。

但真正让这个故事脱离常规开源项目轨道的,是它引发的行业思考。

02 从“对话AI”到“执行AI”

传统AI开发的范式可以概括为“云原生、API驱动”:开发者调用云端大模型的API,模型返回文本或代码,开发者再将这些结果集成到自己的应用中。这个范式的瓶颈显而易见——AI的“行为能力”被限制在API提供的能力范围内。

OpenClaw的变革在于,它将AI从“对话者”变成了“执行者”。

这一切的基石是一套全新的权限系统。过去三年,AI行业都在卷大脑(模型),但没人给AI装手脚。OpenClaw的贡献在于,它提供了一套安全、可控的“手脚系统”——通过操作系统级的权限管理,让AI能够以用户身份执行操作。设计哲学上的创新是突破性的:首次将“AI权限”作为一个一级公民来设计。

在OpenClaw中,每个Skill都需要明确声明自己需要哪些权限:读取文件、写入文件、执行命令、访问网络等等。用户安装Skill时,会看到一个清晰的权限列表,像手机App安装时的权限请求一样。这种透明化彻底改变了用户信任模型——以前用户不知道AI在背后做了什么,现在他们可以精确控制。

权限的解放带来了生产力的指数级跃迁。Steinberger在过去一年里,一个人在GitHub上完成了超过9万次代码提交,横跨120多个项目。这种效率在人类软件工程史上是不可想象的。

“一年前,这也是绝对不可能的。没有任何模型能让一个人建构出这种规模的东西。”Steinberger直言。他的工作流极其简单粗暴:把一个高达1.5MB、包含所有代码文件的Markdown文档拖进AI模型,直接写下“给我写个技术规格说明书”,然后输入“构建”。在这个过程中,AI甚至会自己编写测试工具去走通登录流程并沿途检查错误。

“当我开始接触这项新技术时,每次都让我多巴胺飙升。我突然意识到,现在我简直可以构建任何东西。”Steinberger表示。

这直接触及了当前软件行业的核心痛点:研发成本。以往需要一个架构师、前端、后端、测试组成的完整团队才能跑通的MVP(最小可行性产品),现在一个人在几个小时内就能完成。

更深层的是开发范式的转变:从“写代码”到“定义意图”。当代码可以被轻易生成,“写代码”本身就失去了壁垒。Steinberger将现在的开源贡献戏称为“提示词请求(Prompt Request)”。他拿到别人的代码后,第一句话是问AI:“你理解这个PR的意图吗?”随后,他会通过语音与AI讨论这是不是最优解、是否存在架构问题,讨论成熟后,再由AI一键生成并合并代码。

“大部分代码都很无聊。它只是将一种数据形状转换为另一种数据形状。我实际上并不关心代码,我关心的是这个人到底想解决什么问题。”Steinberger解释道。

这种范式的转变说明,软件开发的本质已经从“熟练掌握编程语言”变成了“清晰定义问题和管理系统架构”。

“大部分代码都很无聊。它只是将一种数据形状转换为另一种数据形状。我实际上并不关心代码,我关心的是这个人到底想解决什么问题。”Steinberger解释道。

这种范式的转变说明,软件开发的本质已经从“熟练掌握编程语言”变成了“清晰定义问题和管理系统架构”。Steinberger直言,那些还在用老旧方式手工敲代码的开发者(他称之为VIP coding)会被淘汰。

“人们没有意识到,GPT-5.2在‘这东西能直接跑通’的层面上,又是一次量子级跃迁。我至今仍对它能运作得如此之好感到惊讶。”Steinberger在访谈中表示。

03 安全争议与开源困境

OpenClaw的崛起,在AI行业内部引发了一场关于安全与开源的深刻争议。

对于OpenClaw的未来,Steinberger的目标是两头都要:“我想在‘我妈也能装’和‘好玩、可黑’之间找到平衡——这很难。”

他描述OpenClaw长期的默认安装方式其实很“反常规开源”:git clone后源码就在本地,代理“坐在源码里,也知道源码”,不满意就“直接提示它改自己”,近似“自修改软件”。但这也把安全矛盾放大。

“提示注入还没解决”,Steinberger直言,同时吐槽外界忽略使用边界:项目里的Web服务最初只打算给“可信内网”调试,但有人硬要暴露到公网,然后安全圈再反过来说“没有公网该有的登录限制”。

“我在安全文档里一直喊‘别这么干’,但人们还是会这么用。”他表示自己已引入安全专家,现实目标是“支持这些用法,同时让大家别一脚踩穿地板”。

Steinberger在访谈中分享了一个有趣的现象:经常有人问他:“你能帮我引荐一下你们的CEO、人力资源或者团队的其他成员吗?”他就回答:“团队就我一个人,我只是在我的‘山洞’里敲代码。”

“但这恰恰体现了他们产生的认知失调。因为这个项目看起来根本不像是任何单一人类能完成的。”Steinberger说。当然,他现在有了维护者,也会收到很多代码合并请求(PR),但这主要还是他一个人构建的。

“哪怕是在一年前,这也是不可能实现的。一年前甚至不存在单人能构建出这种规模项目的模型。这超出了人们对这个领域的原有认知。”

逻辑很清晰:如果开发者能在本地运行AI,并且让AI直接操作系统,为什么还要支付昂贵的API调用费?尤其是对于需要频繁交互、长上下文的场景,云端API的成本优势正在迅速消失。

更深远的影响在于商业模式的重构。传统AI公司的盈利模式建立在“按token收费”的基础上,而OpenClaw的本地运行模式让token成本趋近于零(只需要支付一次模型下载的成本)。

在传统AI开发范式下,开发者需要同时精通AI模型、后端工程、前端交互,而OpenClaw的Skill机制让开发者可以专注于“定义任务”,而不是“实现技术”。

“大多数人把他们的设置搞得太复杂了。”Steinberger指出,“我自己以前也搞得太复杂过,我称之为‘智能体陷阱(Agentic trap)’。从你首次接触这项新技术,到你真正变得非常高效,中间这段时间,很多人会陷入这种陷阱,试图极度优化他们的环境配置。这实际上并不能让你变得更高产,只是让你‘感觉’自己更高产。”

Steinberger认为开源的美妙之处在于:“人们可以接受它,并想出你甚至没想到的主意。”但这也是疯狂之处——你无法完全控制人们如何使用你的工具。

他现在面临超过2000个开源代码合并请求(PR),但审查这些PR的方式已经完全变了。他不再逐行阅读代码,而是让AI去审查,关注的是PR背后的意图,而不是具体的代码实现。

“审查一个PR花费的时间甚至比我自己去写还要长。因为我宁愿相信模型没有恶意,也不愿轻信一个我从未听说过、也从未交流过的外部贡献者。”Steinberger坦言。

04 开发者的新时代

OpenClaw三个月登顶GitHub,只是一个更大故事的开端。这个故事的核心,是开发者新时代的到来。

这种转变背后,是开发者技能栈的根本性重构。

过去的核心竞争力是熟练掌握编程语言、框架和工具链。但在AI智能体时代,重点正在从“如何实现”转向“需要什么”。

行业观察显示,新一代开发者的工作模式已显著改变。使用AI辅助编程的开发者中,超过七成表示他们花在“问题定义和架构设计”上的时间增加了四成以上,而实际编码时间相应减少。

斯坦福大学一位教授的观点很有代表性:“未来优秀的开发者不是最会写代码的人,而是最懂如何向AI描述问题的人。”

而这一切的基础,是信任的重建。传统AI应用的最大痛点之一是信任缺失——用户不知道AI在背后做了什么。OpenClaw通过要求每个Skill明确声明所需权限,并将权限列表在安装时清晰展示,将AI从“黑箱”变为了“透明工具箱”。

企业反馈验证了这种设计的重要性。某金融科技公司在内部评估报告中指出:“OpenClaw的权限系统让我们能够精确控制AI的访问范围,这对于合规敏感的金融应用至关重要。”这种可控性大大降低了企业部署AI的风险顾虑。

这种变化也在重塑开源本身。 OpenClaw代表了一种新的开源范式:它不再仅仅是代码的共享,而是智能体能力的共享。Skill机制让开发者分享的是解决问题的能力,而不仅仅是实现代码。

一位开源社区维护者观察道:“我看到越来越多的贡献者提交的不是代码补丁,而是改进建议和问题描述。”最受欢迎的Skills往往不是技术最复杂的,而是最“理解用户意图”的。比如“会议纪要整理”Skill在三个月内被超过5万开发者使用,因为它能准确理解不同会议场景的需求差异。

更深远的影响是,我们正在进入创造者的春天。 AI智能体大幅降低了技术实现的门槛,让更多人能够专注于创造本身。

一位在2025年辞职全职开发AI应用的开发者分享:“以前我需要一个团队才能完成的产品,现在我一个人用OpenClaw在两周内就能做出原型。这不仅仅是效率提升,更是可能性边界的扩展。”

市场数据也印证了这一趋势。招聘平台显示,2026年第一季度,“AI协作能力”已成为技术岗位最常提到的技能要求之一,甚至超过了对特定编程语言的要求。

所有迹象都表明,这只是爆发的前夜。行业分析师普遍认为,当前只是AI智能体发展的早期阶段。OpenClaw的快速崛起揭示了一个更大的趋势:当AI从“工具”变为“伙伴”时,生产力曲线将发生非线性跃迁。

预测显示,到2027年,超过六成的软件开发工作将涉及与AI智能体的深度协作。这种协作不会完全取代人类开发者,而是重塑开发者的角色——从代码编写者转变为系统架构师、问题定义者和质量保证者。

企业正在为此做准备。科技公司和初创公司都在调整组织结构和培训体系。一位技术高管总结道:“最大的挑战不是技术采用,而是思维转变。我们需要培养的不是更好的程序员,而是更好的‘人机团队领导者’。”

OpenClaw用三个月的时间,证明了一件事:当AI真正成为开发者的“伙伴”而不仅仅是“工具”时,生产力的边界将被彻底重绘。这场变革远未结束——它只是AI智能体时代的序章。

这不是机器取代人类的故事,而是机器增强人类的旅程。

当AI拥有了“手脚”,人类得以解放“大脑”,专注于最擅长的事情:发现问题、定义价值、创造意义。

OpenClaw的成功提醒我们,技术的终极目标,始终是扩展人类的可能性——让每个有想法的人,都能将想象变为现实。

而这,只是开始。