三驾马车齐头并进,从云端仿真到车端推理,英伟达正在定义智能汽车的下一个十年。

“你们到底是个硬件公司,还是软件公司?”在回应这一问题时,英伟达黄仁勋曾表示,英伟达始终是一家软件公司。

如今来看,这话在汽车领域,颇为贴切。

在过去的几年里,英伟达已悄然从一家单纯的芯片供应商,转变为一整套自动驾驶解决方案的“总承包商”。

其布局之深,覆盖之广,远超外界想象。它不仅卖车端芯片(AGX),还提供云端训练(DGX)和仿真(OVX)的能力,最近更将最核心的AI模型和数据集大方开源,试图降低行业门槛,做大生态蛋糕,从而更持续地驱动算力需求,重塑产业规则。

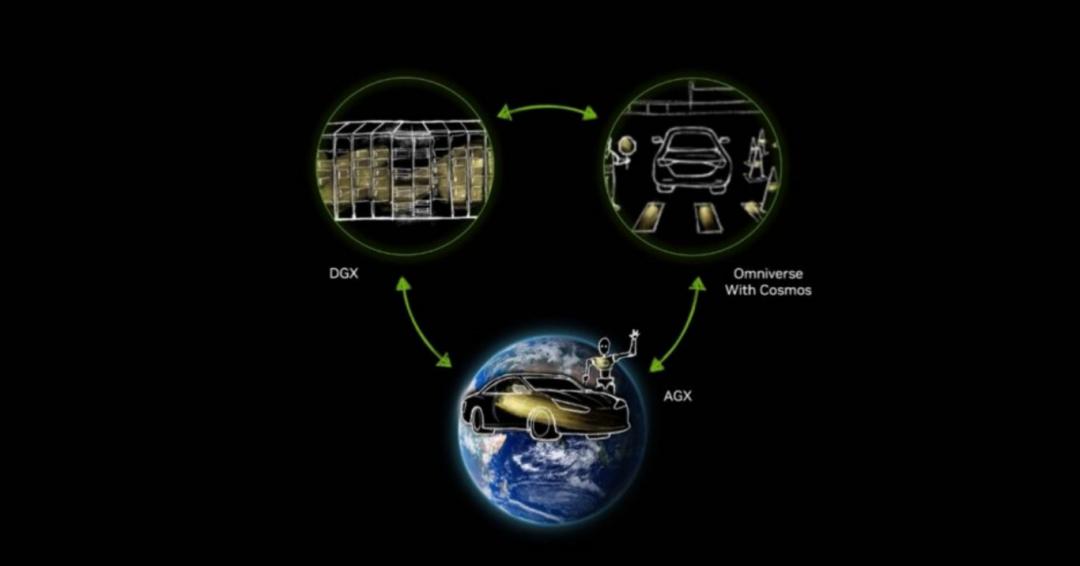

三大支柱,全栈解决方案

如果把智能汽车的开发比作盖摩天大楼,英伟达不只是卖钢筋水泥,而是开始提供从设计蓝图、施工机械到装修方案的全套服务。

这栋大楼的建造主要依赖三台“计算机”,它们构成了英伟达汽车战略的黄金三角。

首先是DGX,AI模型训练工厂。

想象一下,要让汽车学会在各种复杂路况下安全行驶,需要什么样的“学习资料”?这就是DGX扮演的角色:AI模型的训练工厂。

DGX不是一台单独的服务器,而是由数千张GPU组成的超级计算集群。在这个“训练工厂”里,车企等客户通过DGX平台处理着来自全球的海量驾驶数据,既有真实采集的道路视频,也有通过虚拟仿真生成的特殊场景。

英伟达不久前发布的“推理”AI:Alpamayo,正在基于这一平台“炼成”。这个模型特殊之处在于它具备“思维链”能力,不仅能识别道路上的物体,还能理解场景中的因果关系。比如看到前方有事故现场,它能推理出“有事故-道路封闭-需要变道”的逻辑链条。

其次是仿真领域的OVX,数字孪生试验场。

真实的道路测试成本高昂且充满风险。OVX系统提供的解决方案是:创造一个与真实世界1:1对应的虚拟世界。

基于英伟达的Omniverse平台,OVX可以构建整个城市的数字孪生,包括道路、建筑、交通标志,甚至是天气变化、行人行为等细节。

在这个虚拟试验场里,自动驾驶算法可以:24小时不间断测试;模拟极端天气和危险场景;重复进行百万公里的压力测试。

最实用的功能是“场景重建”。如果某家车企的真实车队在某十字路口遇到了罕见的交通情况,他们可以使用英伟达的NuRec工具,将这个真实场景在虚拟世界中精准复现,然后生成数百种变体用于算法训练,极大地加速了算法验证和迭代周期。

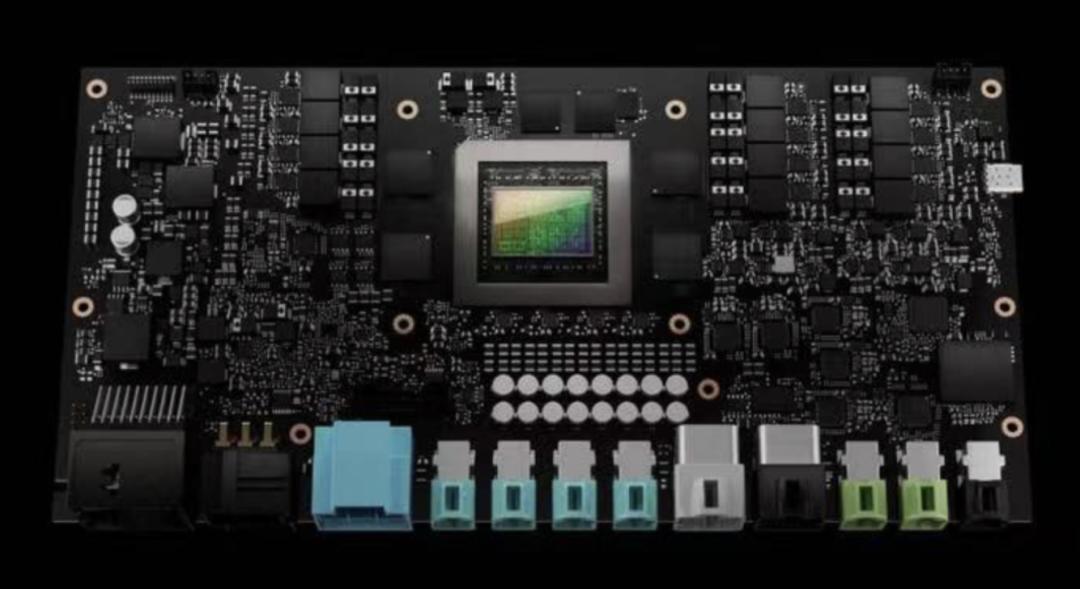

第三则是AGX,车端推理大脑。

这是英伟达在汽车领域最为人熟知的部分:车载计算芯片。从早期的Parker、Orin系列,到现在力推的Thor,算力从几十TOPS跃升至上千TOPS,成为理想、小米、极氪、比亚迪等新老势力旗舰车型的标配。

但算力数字背后,真正的价值在于软件栈的持续优化。通过TensorRT的版本迭代,Transformer的性能可以提升30-50%;同时基于最新的TensorRT Edge-LLM SDK,Orin同时可以很好的支持7B的大模型,并取得相当好的性能。

这得益于英伟达完整的车载软件生态:DriveOS,车载操作系统,有符合功能安全认证的QNX版本,也有更易开发的Linux版本;TensorRT,专门为大模型推理优化的软件库,能将云端训练好的模型高效部署到车端;CUDA,统一的并行计算架构,让开发者一次开发,就能在云端和车端运行。

这三台“计算机”形成了一个高效协同的闭环:DGX负责训练模型,OVX负责验证测试,AGX负责最终执行。车企可以在同一个技术栈上完成从研发到量产的全过程,大大降低了开发难度和集成风险。

盈利模式,从卖硬件到卖服务

理解了“三台计算机”架构,就能看懂英伟达新的商业模式。

传统认知中,英伟达靠卖芯片赚钱。但实际情况是,芯片销售收入只是冰山一角。

英伟达不止卖芯片,还卖服务。

不过,与外界传言的“数百万美元授权费”不同,英伟达收取的是一次性工程服务费(NRE)。

这笔费用的本质,是英伟达派驻工程师团队,深度参与车企的量产项目,帮助他们将算法在英伟达平台上“跑通”、优化直至落地,并且根据项目难易程度价格各有不同。

这更像是“教练费”。

车企,尤其是那些自研算法但经验尚浅的团队,虽然有算法团队,但缺乏在英伟达平台上开发和优化的经验。英伟达的工程师会:帮助优化算法在芯片上的运行效率、解决软硬件集成中的各种问题、提供最佳实践和架构建议。

这种服务模式带来了多赢局面:车企团队快速成长,掌握平台开发能力;英伟达获得最一线的需求反馈,持续改进产品;双方建立了深度信任关系。

更重要的是,这种模式的核心驱动力,是对算力永无止境的渴求。无论是云端训练更复杂的模型,还是车端部署更强的AI功能,都意味着需要采购更多的DGX、OVX和AGX。软件和服务,最终是为了更好地“消耗”算力硬件。

但这对英伟达来说,显然还不够。

2025年初,英伟达在CES上又做出惊人之举:将其酝酿已久的Alpamayo系列全部开源。

Alpamayo系列包括三部分:

一是Alpamayo1,一款约100亿参数规模的思维链推理模型,已在Hugging Face上开源,以使汽车能够理解周围环境并解释其行动,用于研究、模型蒸馏及开发辅助工具。

二是AlpaSim,一套完全开源的端到端辅助驾驶仿真框架,已在GitHub发布,支持在多种环境和边缘案例中进行闭环训练和评估。

三是物理AI开放数据集,包含超过1700小时的真实道路驾驶数据,覆盖不同区域和环境条件,并包含一定比例的复杂和罕见场景。

这些工具共同构成了一个自我强化的开发闭环,助力构建基于推理的自动驾驶技术栈。

这一举动看似“慷慨”,实则是一步深思熟虑的战略棋局。

第一,降低行业门槛,做大生态蛋糕。自动驾驶研发最大的痛点之一,是高质量、强因果标注数据的极度匮乏。

英伟达开源的Alpamayo不仅是模型,更包含一套“思维链”数据标注方法。它要求AI模型不仅要识别物体,还要像人一样理解场景中的因果关系。例如:因为前方有事故,所以车道被锥桶封闭。

这套方法论和数据集,为整个行业提供了一条可复制的路径,能极大加速从L2到L4的研发进程。当整个行业因此而加速时,作为底层算力与平台的最大提供者,英伟达自然是最大赢家。

第二,以开源对抗地缘政治风险。当最核心的技术以Apache 2.0等开源协议发布,它就变成了一种全球公共知识资产,更难受到单一国家政策或禁令的限制。这为英伟达的全球业务上了一道“保险”。

第三,确立技术范式领先地位。在从传统模块化自动驾驶向端到端、再向具备推理能力的VLA模型演进的十字路口,英伟达通过开源其最先进的成果,事实上在为行业定义下一代技术框架。谁掌握了标准,谁就掌握了未来。

据悉,在过去两年里,已经至少有三家中国客户基于英伟达的开源框架,构建了自己的数据标注流水线,这种早期采纳者形成的网络效应,是任何竞争对手都难以撼动的。

而英伟达与奔驰的合作,则展示了其全栈方案的标杆价值:从硬件架构、操作系统到AI模型,形成可灵活配置的模块化服务体系。

“中国速度”,汽车棋局背后的驱动力

英伟达之所以在汽车领域步伐加速,很大程度上是由于中国市场的需求驱动。

目前,海外车企在智能汽车领域的研发落地节奏,相比中国至少慢两到三年。因此,这种“中国定义需求,全球实现产品”的模式,已成为英伟达汽车业务的特点。

一个典型案例是TensorRT-LLM for Auto的开发:当时中国客户的需求非常明确,他们希望将百亿参数的大模型部署到车端,而且要求延迟控制在毫秒级。英伟达从提出需求到原型验证只用了两个月,这在传统的产品开发周期中是不可想象的。

中国车企快节奏的迭代、对功能落地的更高追求,倒逼英伟达本地团队开发出如TensorRT-LLM for Auto等专用工具,而这些成果最终又反哺全球。

面对地平线、高通等竞争对手,以及特斯拉、蔚来等自研芯片的车企,英伟达一向很自信。

这种自信源于一个判断:智能驾驶的终极竞争,是系统性工程能力和持续演进生态的竞争。

做出一颗算力强劲的芯片或许可以靠重金投入,但要构建一个从芯片、安全认证、操作系统、中间件、加速库到开发工具,并持续迭代优化十年以上的全栈体系,其门槛非常高。

当行业向更高级别的自动驾驶迈进时,功能安全、预期功能安全、网络安全等法规要求将呈指数级增长,这恰恰是英伟达耗时多年、耗资巨大构筑的“隐性护城河”。

英伟达的汽车棋局已非常清晰:以全栈软硬件平台为基座,以深度工程服务为粘合剂,以战略级开源为生态加速器,最终驱动全球汽车产业对算力的饥渴消费。

它不再只是智能汽车的“供应商”,而是致力于成为整个AI驱动出行时代的架构师与赋能者。这场关于汽车大脑的战争,英伟达正在试图定义新的游戏规则。