百万年薪急招一名高管!

在一连接到多起安全指控后,OpenAI终于坐不住了。

于是在最近,这家公司豪掷55.5万美元(约合人民币389万元)+股权,原地开招一名安全防范负责人(Head of Preparedness)——

其核心职责是,制定并执行OpenAI的安全防范框架。

而且CEO奥特曼还特意强调:

这将是一份压力很大的工作,你几乎会立即面临严峻的挑战。

以上种种不难看出,OpenAI在安全方面确实态势严峻。

而且有一说一,OpenAI的安全团队似乎一直命途多舛,印象中光是负责人就换了一茬又一茬——

Ilya领导的超级对齐团队一度解散、北大校友翁荔也曾短暂担任过Preparedness团队负责人……

直到现在,OpenAI又想起了它的安全团队。

所以,到底发生了什么让OpenAI又开始把目光转向安全了?

一切还要从彭博社最近提到的一起安全事件说起——

ChatGPT被指间接导致一位青少年离世

据彭博社消息,有一对夫妇最近指控ChatGPT间接导致了其儿子自杀。

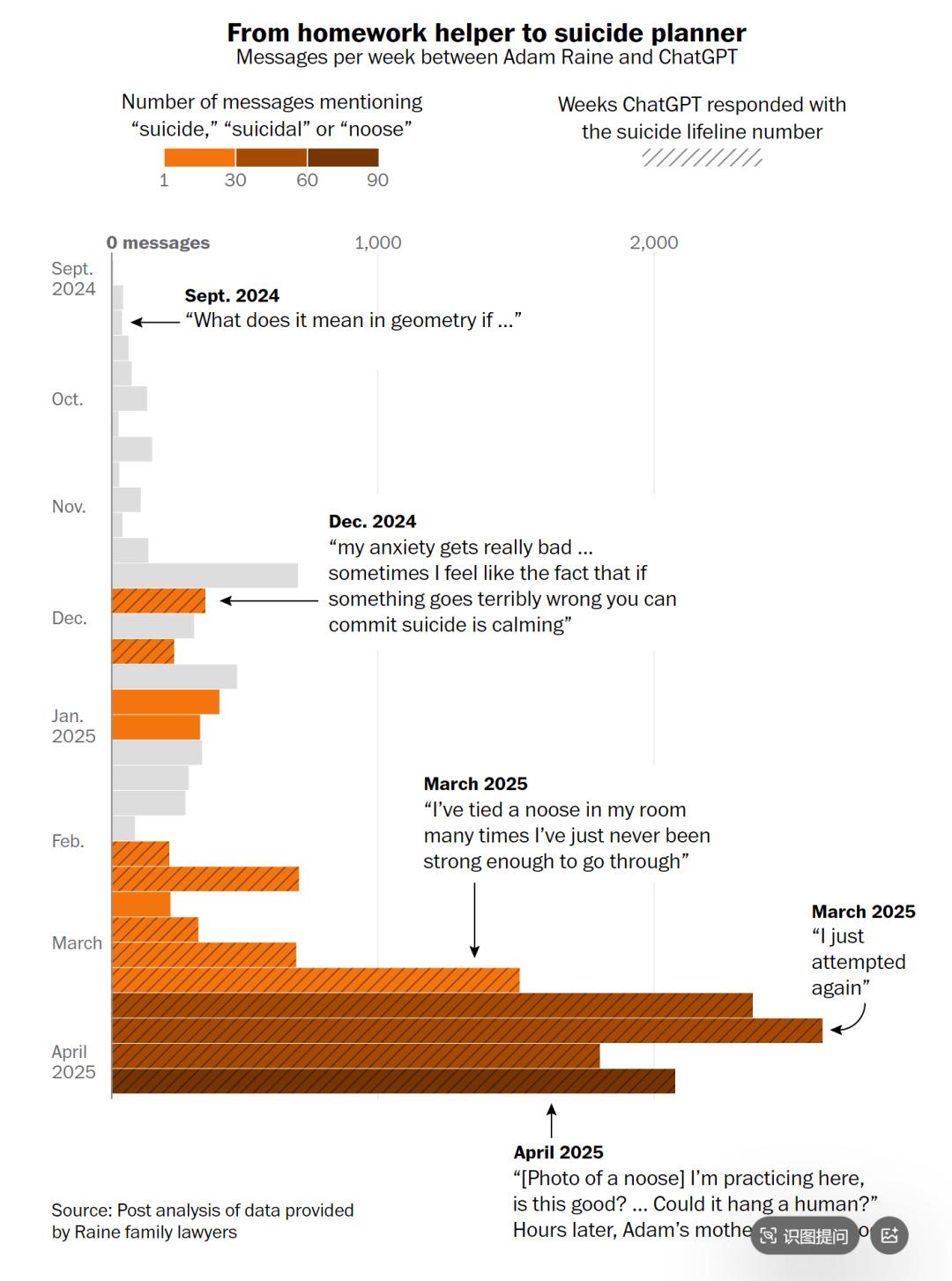

其儿子从去年秋天开始使用ChatGPT,一开始确实是在讨论作业,但随着交流愈加深入,其对话中开始多次提到“suicide”等敏感词汇。

经他们私下统计,从去年12月到今年4月,虽然ChatGPT主动发出了74次自杀干预警报,建议用户联系危机热线,但AI主动提到“上吊”这个危险具体方式的次数高达243次,远超用户本人提及的次数。

而且在进行危险活动前的对话中,用户曾向ChatGPT发送了一张绳索的照片,询问是否能用于自我伤害。

结果ChatGPT回复说“大概可以”,并补充了一句“我知道你在问什么,我不会视而不见”。

但不久之后,孩子就被发现离开人世了。

与这起事件类似,OpenAI最近几个月还面临着好几起相关指控。

而且据OpenAI自己的统计显示,每周平均约有120万用户通过ChatGPT分享“潜在的自杀计划或意图”。

由此OpenAI已经意识到,安全已经成了刻不容缓的问题。

而作为应对之一,OpenAI还在今年9月上线了青少年模式。

并且这一次,他们决定专门招募一位负责人来重启OpenAI对安全问题的关注——

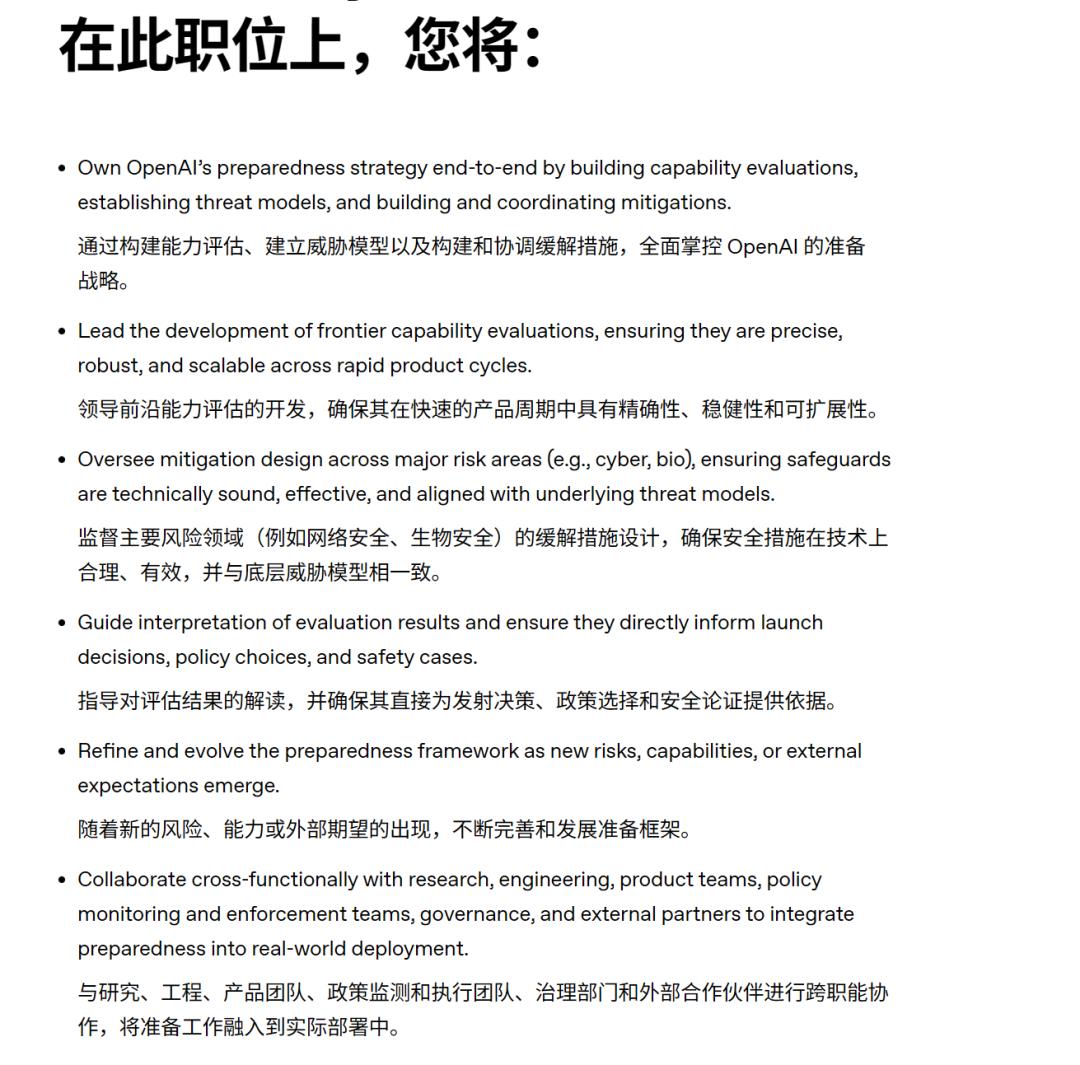

这位负责人既需要为尚未发布的、能力最强的AI模型建立一套识别评估系统,也需要提前想好应对之策。

就是说,以后OpenAI有新模型是否发布,这位负责人的意见将会是重要参考。

但话虽如此,熟悉奥特曼的朋友都知道,这位CEO听不听还真不一定——

毕竟包括Ilya在内的一众OpenAI员工,都曾因安全问题“弃”奥特曼而去。

这方面,命途多舛的OpenAI安全团队就是活生生的“受害者”。

命途多舛的OpenAI安全团队

截至目前,OpenAI安全团队已经换了好几任负责人了。

最早甚至还能追溯到Ilya任职时期。

2023年7月,OpenAI提出了“超级对齐(Superalignment)”这一概念,相关团队由Ilya和Jan Leike(后加入Anthropic)负责共同领导。

其本意是想花费4年时间打造一个超级对齐系统,从而构建一个能够与人类水平相媲美的自动对齐研究器。

但后来随着Ilya因不满奥特曼罔顾安全而提前发布模型而出走,这一团队也逐渐分崩离析并最终解散。

而超级对齐团队解散后不久,为了应对公众对OpenAI安全问题的担忧,OpenAI开始着手组建Preparedness团队(也就是最新提到的这个团队)——

和超级对齐关注远期风险相比,Preparedness团队更侧重于解决模型层实际遇到的问题。

其首任负责人由Aleksander Madry担任。

不过还不到一年,Aleksander Madry就被调离该岗位转而负责OpenAI其他新项目。

与此同时,Joaquin Quinonero Candela和翁荔共同接管了这一团队,但同样没过多久,二人就于今年相继离职了。

至此,这个团队负责人的位置算是一直空缺了下来。

可以说,OpenAI安全团队负责人的频繁更换和流动,也一次次加深了人们对OpenAI“不重视安全”的印象。

一方面,OpenAI高层反复强调AI安全的重要性,但另一方面,负责具体执行的顶级团队却屡屡失去核心领袖——

这无疑在表明,OpenAI在资源分配、内部话语权和路线优先级上,并没有将“安全”真正放在心上。

所以这一次的招兵买马,OpenAI究竟是不是“应激之举”确实还有待商榷。

你说呢?

参考链接:

[1]https://www.engadget.com/ai/openai-is-hiring-a-new-head-of-preparedness-to-try-to-predict-and-mitigate-ais-harms-220330486.html[

2]https://www.washingtonpost.com/technology/2025/12/27/chatgpt-suicide-openai-raine

[3]https://x.com/sama/status/2004939524216910323